Prozesssynchronisation mittels Trigger – ein Leitfaden

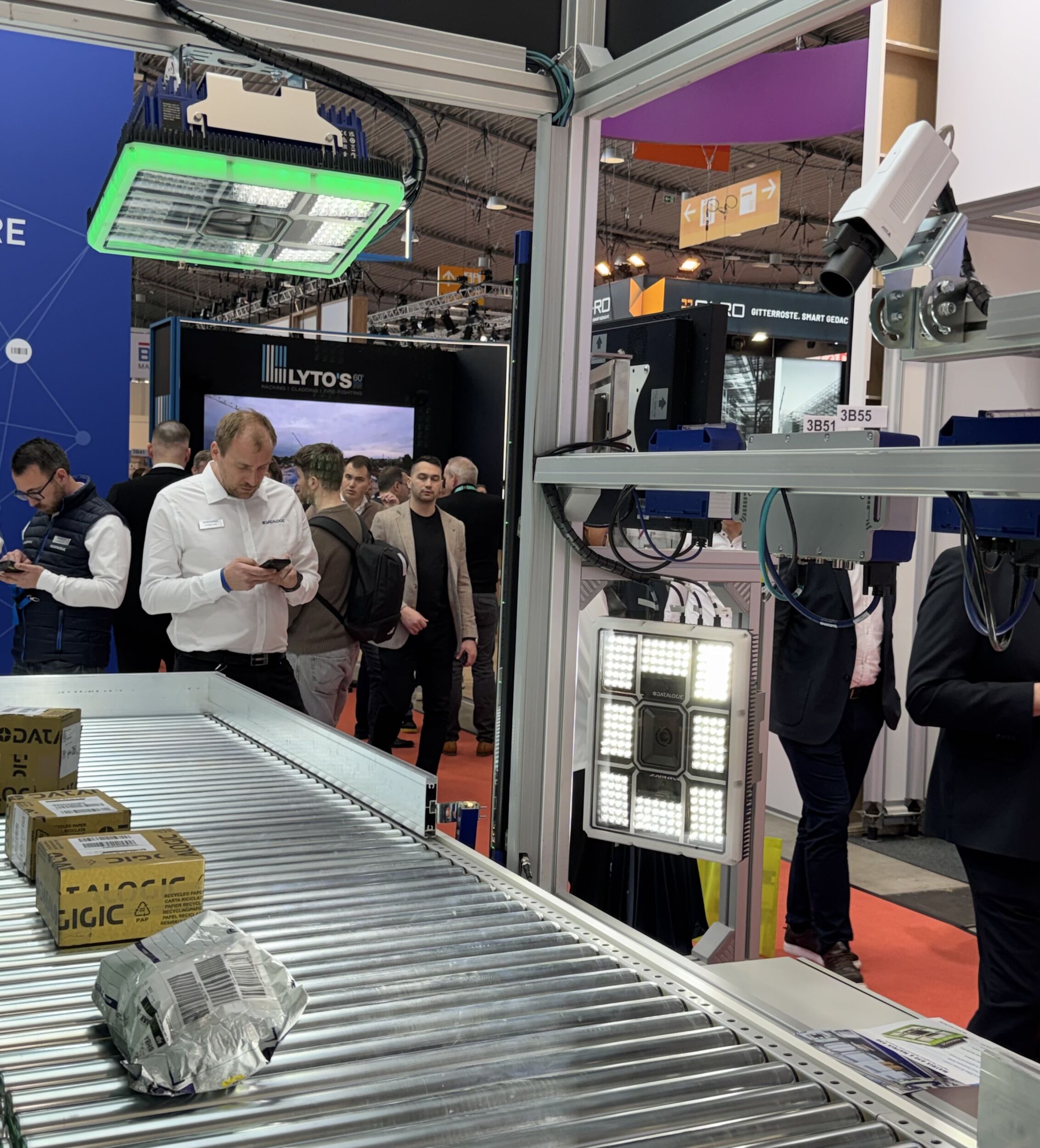

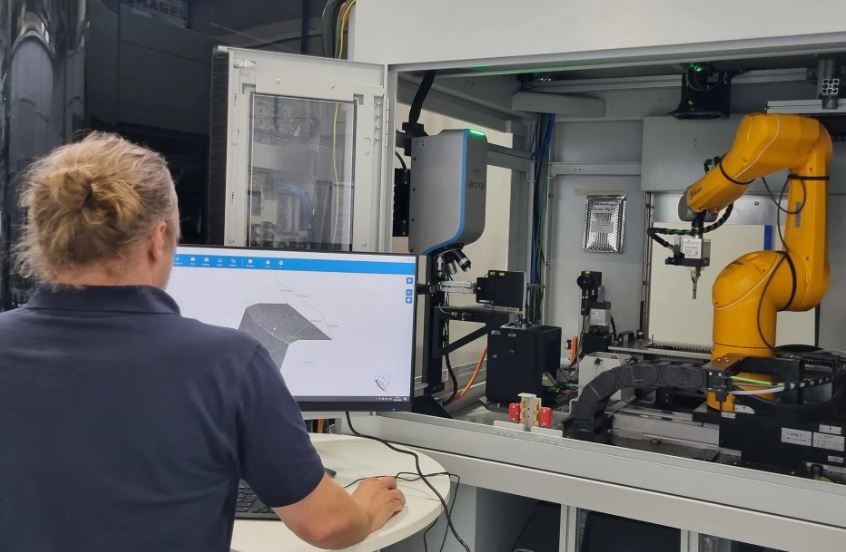

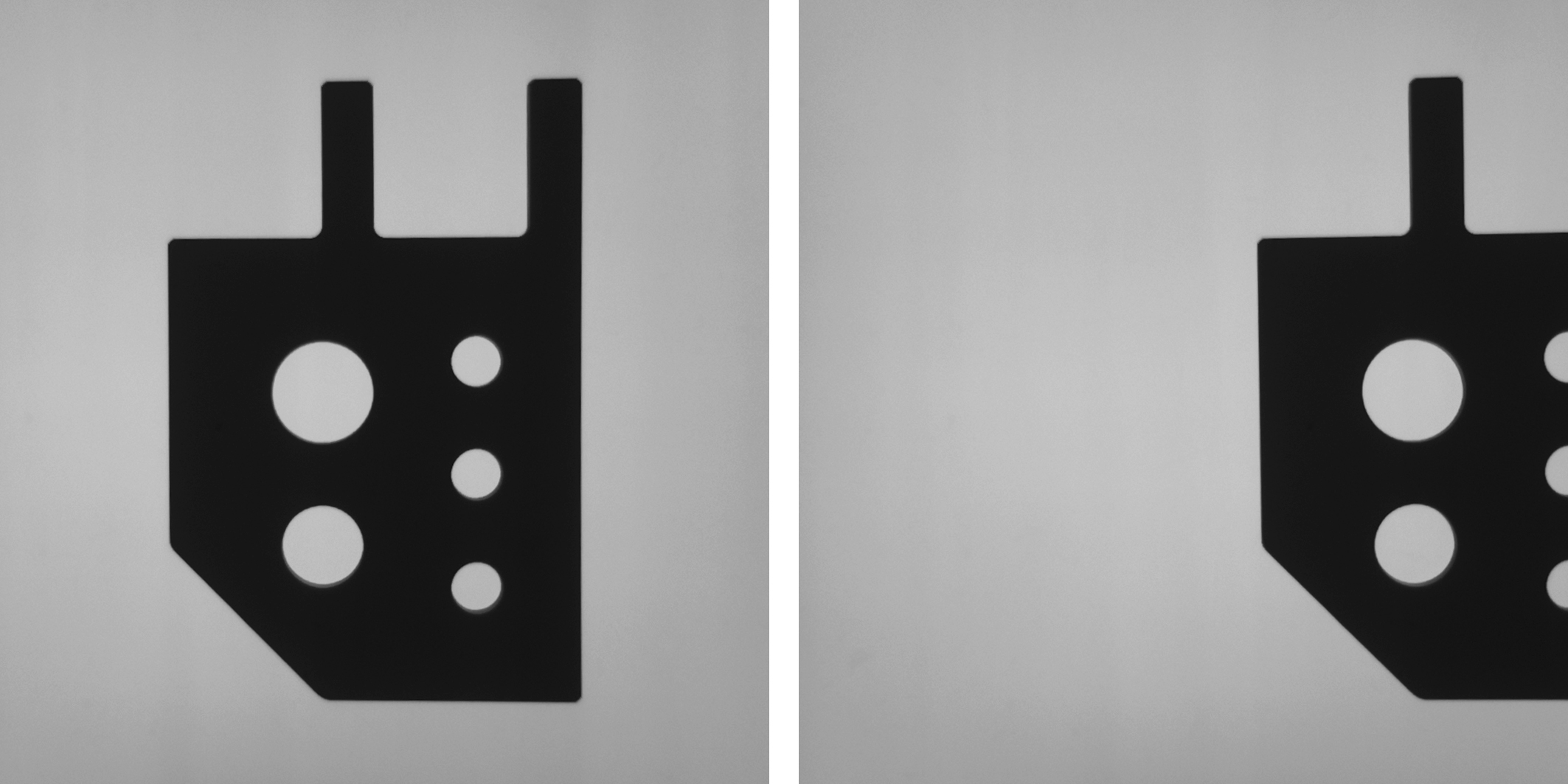

Bei der Bildverarbeitung muss ein Bild genau dann aufgenommen werden, wenn sich das (bewegte) Objekt vollständig unter dem Objektiv befindet und die Beleuchtung aktiviert ist. Eigentlich einfach, aber im Detail liegen oft Fallstricke. Welche das sind, zeigt der Beitrag.

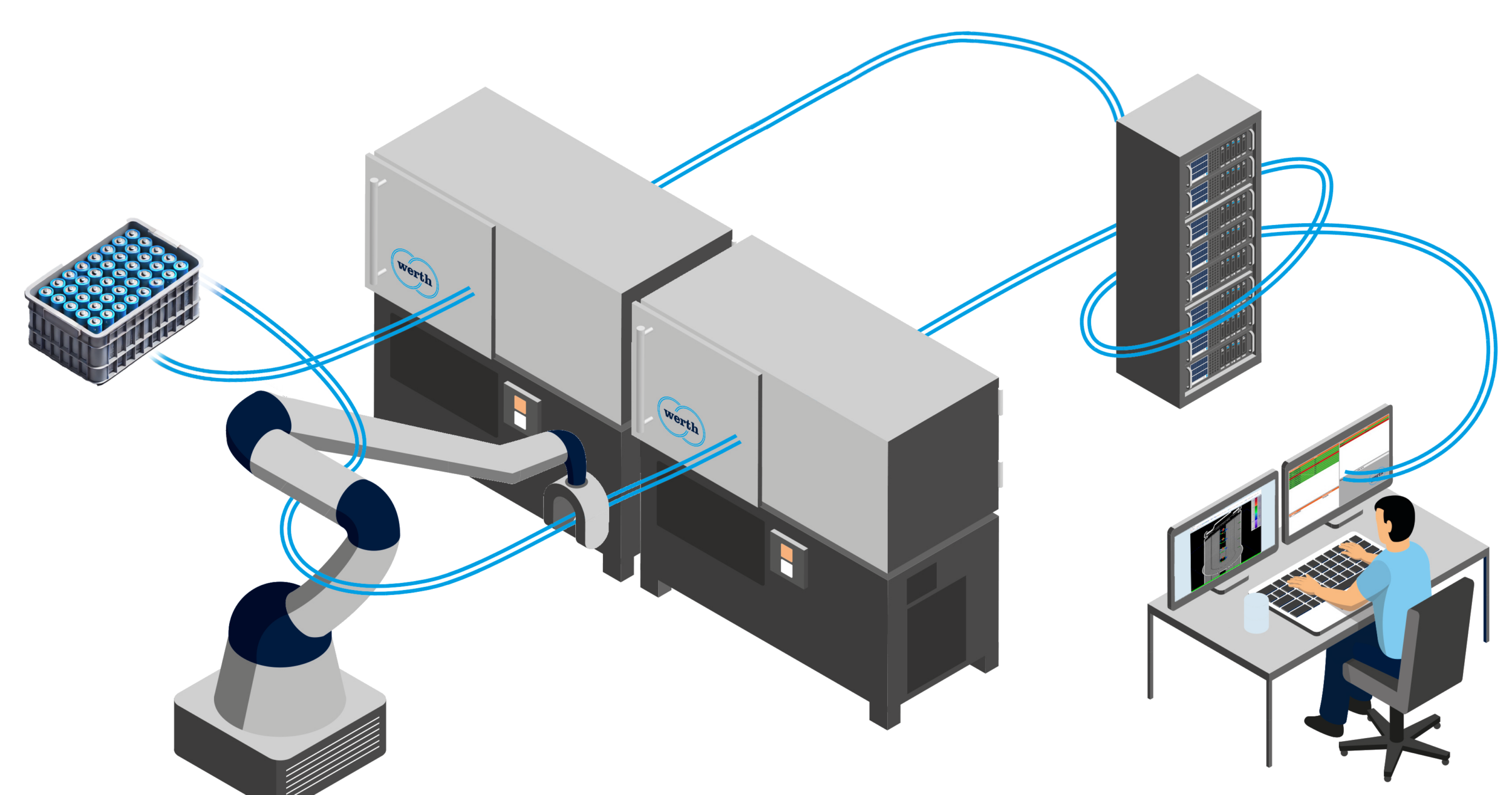

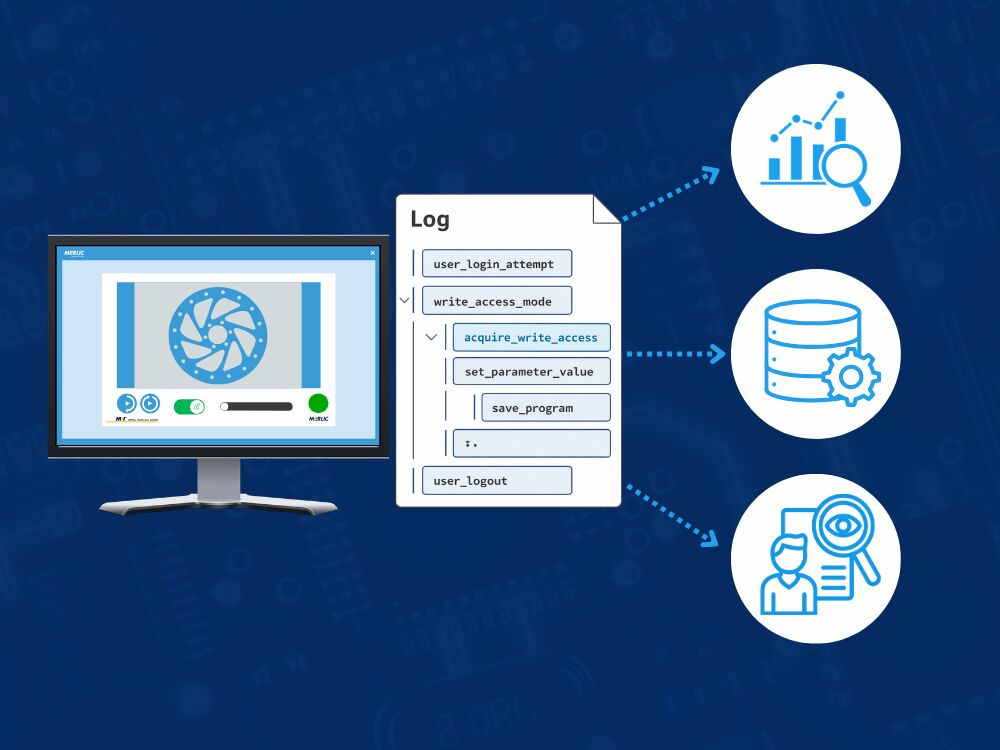

Die Synchronisierung zwischen Maschinentakt im Verarbeitungsprozess, Kamera und Beleuchtung erfolgt über Trigger, d.h. externe Signale oder Ereignisse, die den Bildeinzug der Kamera starten und deren Quellen Hardwarekomponenten sind oder in der Software liegen. Die Signale müssen erzeugt, transportiert und verarbeitet werden. Dies sind Prozessschritte, die Zeit benötigen bzw. Schwankungen unterworfen sind und damit berücksichtigt werden müssen. Moderne Industriekameras sind für diese Synchronisation jedoch bestens gerüstet.

Trigger verwenden

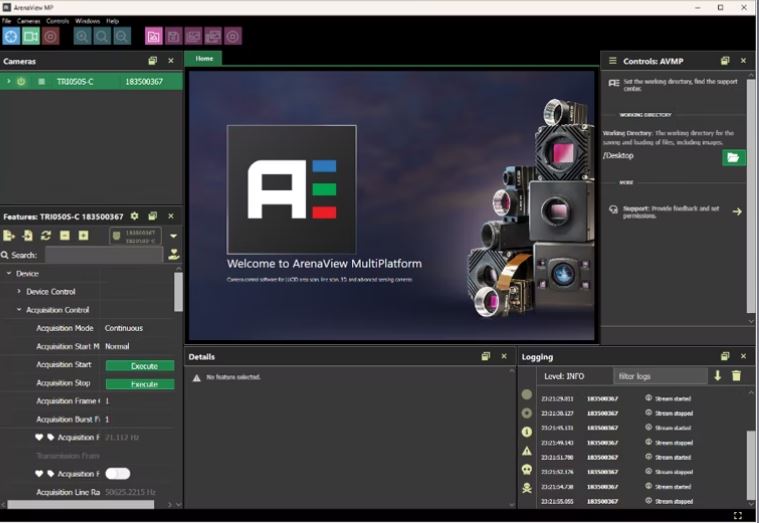

Für die Synchronisation empfiehlt sich die Verwendung von Triggern, unabhängig vom verwendeten Kameratyp. Die Kamera sollte nicht im Free Running Modus laufen, sondern in der Software muss der TriggerMode aktiviert sein. Sobald die Kamera den Trigger empfängt, beginnt sie mit der Bildaufnahme nach einem einstellbaren TriggerDelay. Mit dieser Verzögerung wird sichergestellt, dass Schwankungen oder Verzögerungen im System (etwa durch Kabel oder Beleuchtungselektronik) berücksichtigt werden. In der Regel muss der Delay durch Versuche bestimmt werden, da er von den verwendeten Komponenten abhängt. Die Verzögerung in der Kamera selbst, ist als Maximalwert im Datenblatt angegeben. Wird mit Triggern gearbeitet, gilt außerdem zu beachten, wann die Kamera für den nächsten Trigger empfänglich ist. Dies hängt vom verwendeten Kamera- und Sensortyp ab. Für den Anwender ist es wichtig festzulegen, welche Bildrate die Applikation benötigt. Damit können weitere Parameter festgelegt, bzw. manche Sensoren und Kameratypen ausgeschlossen werden.