Embedded Vision mit Halcon 11

Bildverarbeitung einfach in Seriengeräte integrieren

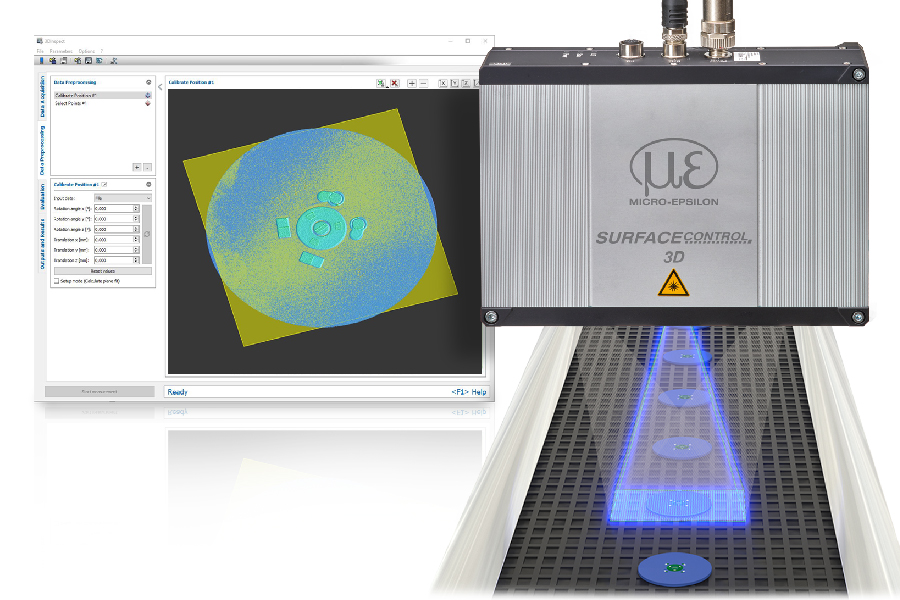

Bildverarbeitung hält massiv Einzug in kompakte Seriengeräte. Dabei stellt sie nicht unbedingt die hauptsächliche Funktion dar, sondern wird zur Unterstützung der eigentlichen Steuerung oder gar als Zusatznutzen zur Steigerung von Bedienqualität oder Prozesssicherheit eingesetzt. Im Gegensatz zu klassischen Systemen oder intelligenten Kameras spielt die Bildverarbeitung dort zwar eher die zweite Geige, muss sich aber dennoch perfekt in ein Gesamtsystem einpassen.

Wie lassen sich nun Bildverarbeitungsfunktionen möglichst einfach und kostengünstig in ein Gerät integrieren? Randbedingungen sind sicherlich, die zusätzlich benötigte Hardware auf ein Minimum zu reduzieren und ein hoher Grad der Anpassung an die Applikation. Hierbei sind die Auswahl des passenden Bildsensors, der Rechenleistung und Interfaces sowie die optimale mechanische Integration der Komponenten wichtig. Eine weitere Fragestellung bei der Planung ist die Ausgestaltung der Software. Wie also kann das Bildverarbeitungssystem einfach und flexibel aufgebaut und verifiziert werden? Wie kann eine einfache Integration der Bildverarbeitung in die Software des Gesamtsystems erfolgen? Phytec und MVTec haben für diese Aufgabe gemeinsam eine Lösung erarbeitet. Die Grundlage der Geräteelektronik bilden die einsatzfertigen Mikrocontrollermodule von Phytec. Diese beinhalten Prozessor, Speicher und Peripheriekomponenten. Die leistungsfähigen Rechenkerne, die überwiegend auf ARM-Technologie aufsetzen, können sowohl die Steuerung als auch die Bildverarbeitung des Systems übernehmen. Für letztere besitzen die Module dedizierte Kameraschnittstellen, über die auf einfache Weise Bildsignale von digitalen Kamerasensoren aufgenommen werden. Phytec hat diese Schnittstellen standardisiert und bietet dem Anwender eine Auswahl passender Kameramodule an. Wie aus einem Baukasten kann der Systementwickler das passende Mikrocontrollermodul und die optimale Kameraplatine kombinieren. Er erhält auf diese Weise bereits ohne Entwicklungsaufwand zwei Kernkomponenten, die auf seinen Bedarf abgestimmt sind. Eventuell benötigte weitere Schaltungsteile (z.B. Motortreiber oder spezielle Messwandler) und die Steckverbinder des Systems können auf der Basisplatine platziert werden, auf die das Mikrocontrollermodul aufgesteckt wird. So wird ein maximaler Freiheitsgrad in der Realisierung der elektrischen Funktionen erreicht. Gleichzeitig ist eine optimale Anpassung an die mechanischen Vorgaben möglich.

Integration der BV-Algorithmen mit Halcon Embedded

Wie erfolgt nun die Erstellung der Gerätesoftware und die Integration der Bildverarbeitungsalgorithmen in das System? Betrachten wir dies am Beispiel des phyCORE-OMAP4460-Moduls. Dieses ist mit 41x51mm kaum größer als eine Streichholzschachtel und besitzt mit dem OMAP 4460 einen leistungsfähigen ARM Cortex-A9 Dual Core Prozessor mit 1,5GHz von Texas Instruments. Im zugehörigen Entwicklungskit für Embedded Linux ist bereits das passende Board Support Package (BSP) und die Entwicklungsumgebung zur Erstellung der Anwendungssoftware enthalten. Der Entwickler kann also sofort mit der Programmierung der Applikation beginnen. Über die Video4Linux2 (V4L2)-Schnittstelle hat er Zugriff auf die Bilddaten der Kamera im System. Mit Halcon Embedded in der Version 11 steht zusätzlich ein leistungsfähiges Werkzeug zur Realisierung der Bildverarbeitung zur Verfügung, das eine umfangreiche Bibliothek von über 1.800 Operatoren niedriger, mittlerer und hoher Komplexität zur Verfügung stellt. Besonders interessant für den Softwareentwickler ist die integrierte Entwicklungsumgebung HDevelop, welche die Entwicklung der Bildverarbeitungssoftware stark vereinfacht. Die Entwicklung wird auf dem PC vorgenommen, wodurch die Zusammenstellung und Parametrierung der einzelnen Funktionen sowie der Test des Systems einfach wird. Der dabei entstehende Code kann anschließend in die Programmierumgebung des Systems exportiert und somit in die Anwendung integriert werden. Durch diese Vorgehensweise wird auf Software-Ebene die gleiche Flexibilität wie im Hardwaredesign erreicht und die Entwicklungszeit erheblich verkürzt. Durch die Modularisierung von Hardware und Software wird die Designsicherheit signifikant erhöht. Individuelle Systeme mit integrierter Bildverarbeitung können so schnell zur Marktreife gelangen.