Polarisationshilfe

Erstes SDK für Vision-Polarisationsanwendungen

Das branchenweit erste Software-Development-Kit (SDK) für den IMX250MZR Polarisationssensor von Sony ermöglicht es, die Entwicklungsdauer eines Projektes von mehreren Monaten auf Wochen zu verkürzen.

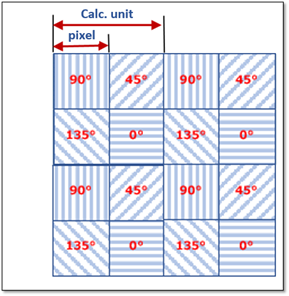

Bild 1 | Auf der Vision wurde ein Echtzeit-Spannungsanalyse-Demo des Polarisartions-SDKs gezeigt. Die Kamera gibt ein gemitteltes (nicht polarisiertes) neben einem Wärmeaus, wobei die Software die Phasenverzögerung – entsprechend der auf den PET-Block einwirkenden Belastung – berechnet. Links: Keine Druckbelastung; rechts: unter Druck (blaue Bereiche) (Bild: Sony Europe Limited)

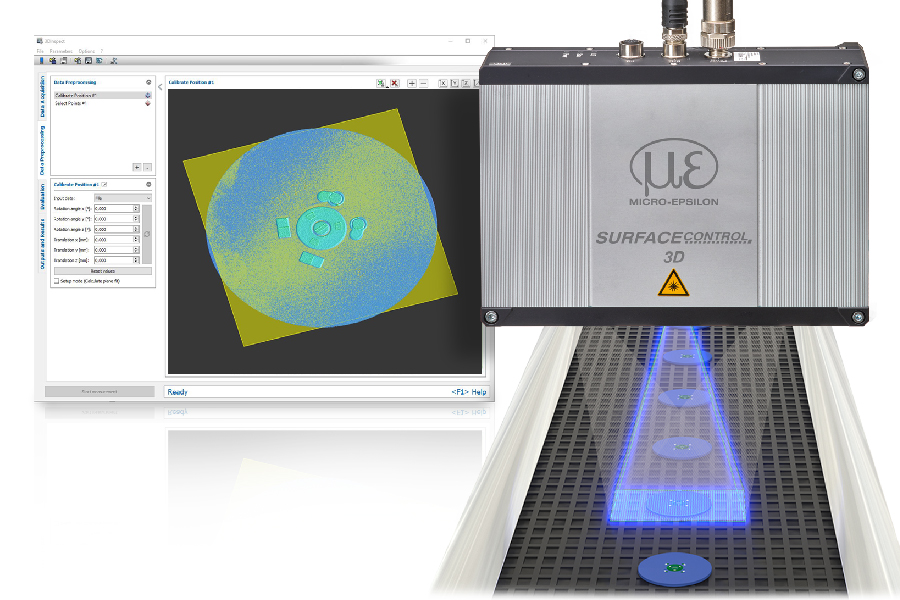

Im September hat Sony den Bildsensor IMX250MZR vorgestellt, den branchenweit ersten CMOS mit integrierter Polarisationsfunktion auf Pixelebene. Der Sensor kann Licht in vier Ebenen filtern (0, 90, 45 und 135°), wobei die Pixel einer Ebene einer 2×2-Berechnungseinheit zugewiesen werden. Bei Vorgesprächen mit ausgewählten Kunden in den entsprechenden Zielmärkten wurde aber deutlich, dass die größte Hürde bei der Einführung der neuen Technologie die Fähigkeit der Entwickler war, problemlos mit den neuen Sensoren zu arbeiten. Sony Image Sensing Solutions hat deshalb zum ersten Mal eine eigene Bildverarbeitungsbibliothek entworfen, um die Entwicklung an Polarisations-Projekten zu beschleunigen: von sechs bis 24 Monaten (je nach Team) auf sechs bis zwölf Wochen. Dieser Ansatz vereint z.B. Faktoren, wie die Belastungsmessung oder Blendungsreduzierung mittels hochoptimierter Algorithmen. Die Funktionen lassen sich auf einem Standard-PC ausführen, wobei die Wahl der CPU-/GPU-Architektur von den Verarbeitungsfunktionen, der Auflösung und Bildrate abhängt.

Bild 2 | Der IMX250MZR CMOS mit integrierter Polarisationsfunktion auf Pixelebene kann Licht in vier Ebenen filtern (0, 90, 45 und 135°), wobei die Pixel einer Ebene einer 2×2-Berechnungseinheit zugewiesen werden. (Bild: Sony Europe Limited)

Virtuelle Polarisationswinkel

Das Polarisations-SDK bietet Support-Funktionen, u.a. Demosaik und Rohextraktion. Mit Cosinus-Anpassungen kann der Entwickler einen virtuellen Polarisationswinkel für das gesamte Bild definieren. Mit der Funktion Durchschnitt wird aus den Rohdaten ein nicht polarisiertes Bild erstellt, das gleichzeitig anzeigt, was eine Standard-Kamera zum Vergleich sehen würde. Vorverarbeitungsfunktionen berechnen verschiedene polarisationsspezifische Informationen, wie z.B. Polarisationsgrad, Stokkes-Vektor und Oberflächen-Normalvektor. Auf höherer Ebene wurden anwendungsorientierte Funktionen implementiert, um Reflexionen zu handhaben und Spannungen zu messen. Die Algorithmen der Funktionen wurden auf Genauigkeit und hohe Rechenleistung optimiert, um sie auch für Prüfungen in Echtzeit nutzen zu können.

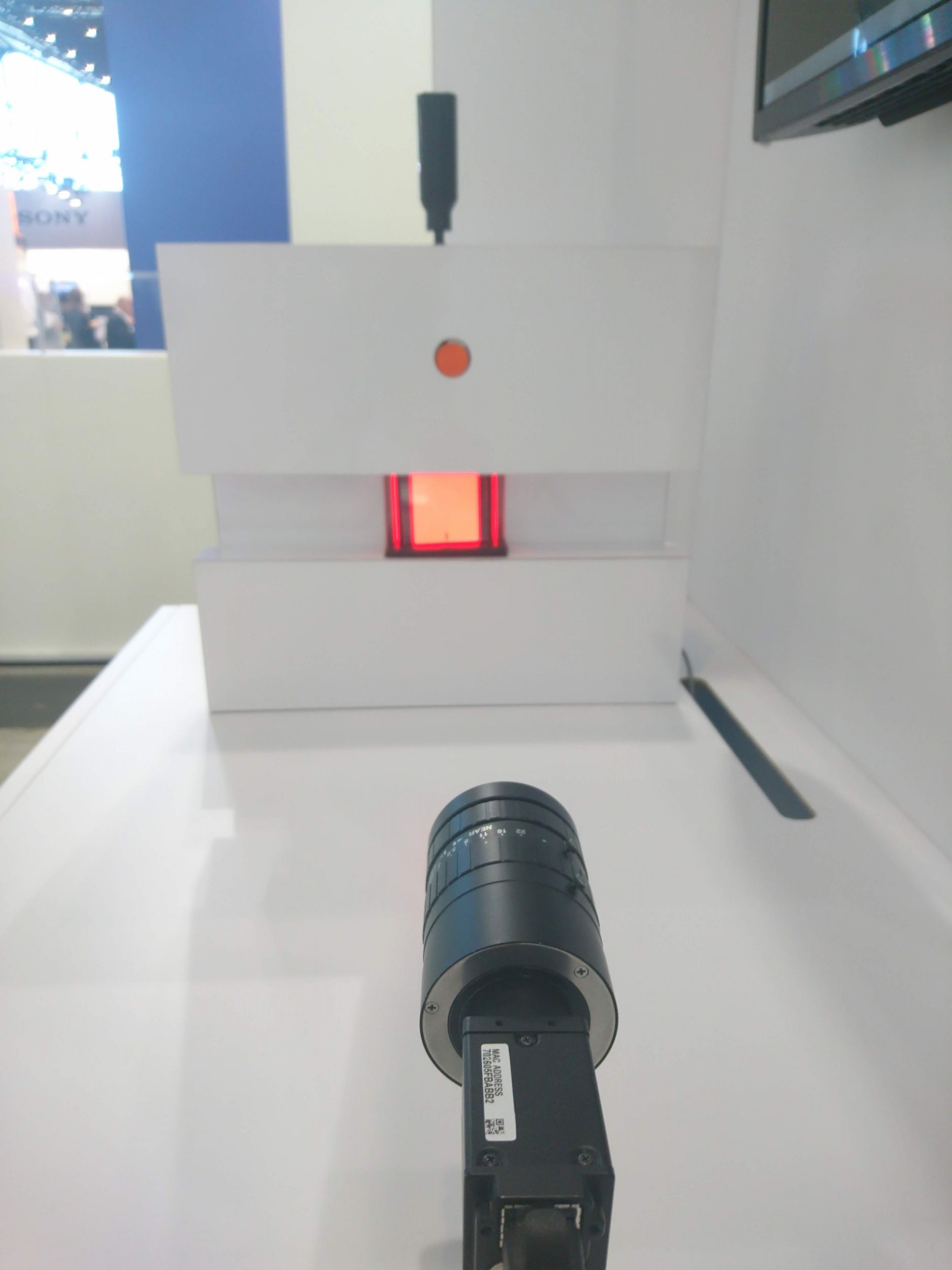

Bild 3 | Bei dem Messeaufbau zur Spannungsanalyse wurde eine XCG-CP510-Kamera vor einem PET-Block montiert, der mit monochromatischen Licht und einem Polarisator hinterleuchtet wurde. (Bild: Sony Europe Limited)

Anwendungen

Der Einsatz polarisierter Kameramodule wird sich in zahlreichen Anwendungen als bahnbrechend erweisen. Das SDK enthält Modelle für den Großteil dieser Anwendungen. Einsatzgebiete sind…

Erkennung von Schwachstellen: Bei der Belastungsüberwachung lässt sich feststellen, wo Spannungen auftreten, indem das Licht gebogen wird, um potenzielle Schwachstellen aufzuzeigen. Dies ist in Branchen entscheidend, die Glas, PET und Telefondisplays verarbeiten.

Fertigung/ITS: Es wurden Modelle entwickelt, um Reflexionen an einem zu prüfenden Objekt zu vermeiden, wenn unkontrolliertes Licht einfällt. Die Reflexions-/Blendungsüberwachung verbessert die Qualitätsprüfung bei der Leiterplatten-, Gehäuse- und Verpackungs-Inspektion (insbesondere in der Pharmaindustrie). Bei der Verkehrsüberwachung ist der Fahrer besser zu erkennen bzw. es kann überprüft werden, ob ein Mobiltelefon verwendet wird, ein (Mit-)Fahrer nicht angeschnallt ist oder ob sich nur ein Fahrer auf einer Fahrspur befindet, die für mehrere Mitfahrer gedacht ist.

Kratzer erkennen: Für eine transparente Wareninspektion ermöglichen die Kamera und das SDK durch die Reflexionsüberwachung eine bessere Oberflächeninspektion und Erkennung von Kratzern.

Belastungstest PET-/Glasfertigung

Auf der Vision wurden bereits zwei Echtzeit-Demos des SDKs gezeigt: eine Reflektionsreduzierung für ITS-Anwendungen und eine Spannungsanalyse. Bei letzterer wurde eine polarisierte XCG-CP510-Kamera knapp 50cm vor einem PET-Block montiert, der mit monochromatischen Licht und einem Polarisator hinterleuchtet wurde. Die Kamera wurde so eingestellt, dass sie ein gemitteltes (nicht polarisiertes) Bild neben einem Wärmebild ausgibt, wobei die Software die Phasenverzögerung – entsprechend der auf den PET-Block einwirkenden Belastung – berechnet. Über dem Block befand sich eine Spannschraube, mit der Messebesucher die Belastung des Blocks ändern konnten. Wie in den Bildern ersichtlich, ist im gemittelten Bild zu erkennen, ob eine Belastung vorliegt oder nicht. Mit den Algorithmen des SDK lassen sich diese Veränderungen sehr schnell erkennen.