In Zeilen denken

Neuer Modus bringt Zeilenkamerafunktionen auf Flächenkameras

Um die Welten der Flächen- und Zeilenkameras miteinander zu vereinen, hat e2v vor Jahren einen Flächensensor mit Zeilenfunktionalität, der eine Zeilenfrequenz von 12,6kHz erreicht. Mit dem BlockScan-Modus bekommen nun auch die Pregius-Flächensensoren von Sony die Fähigkeit, in Zeilen zu denken.

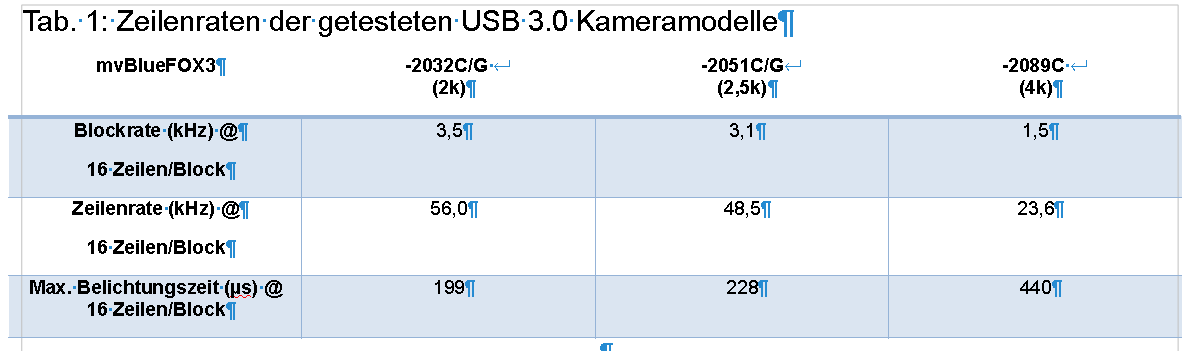

Bild 1a-c | Auf einer rotierenden Trommel mit Inkrementalgeber ist ein Maßband angebracht, das nahtlos erfasst werden soll. Gesamtbild mit korrektem (l.), zu niedrigem (m.) und zu hohem LinesPerBlock Wert. In der Mitte sieht man Lücken, rechts Überlappungen. (Bild: Matrix Vision GmbH)

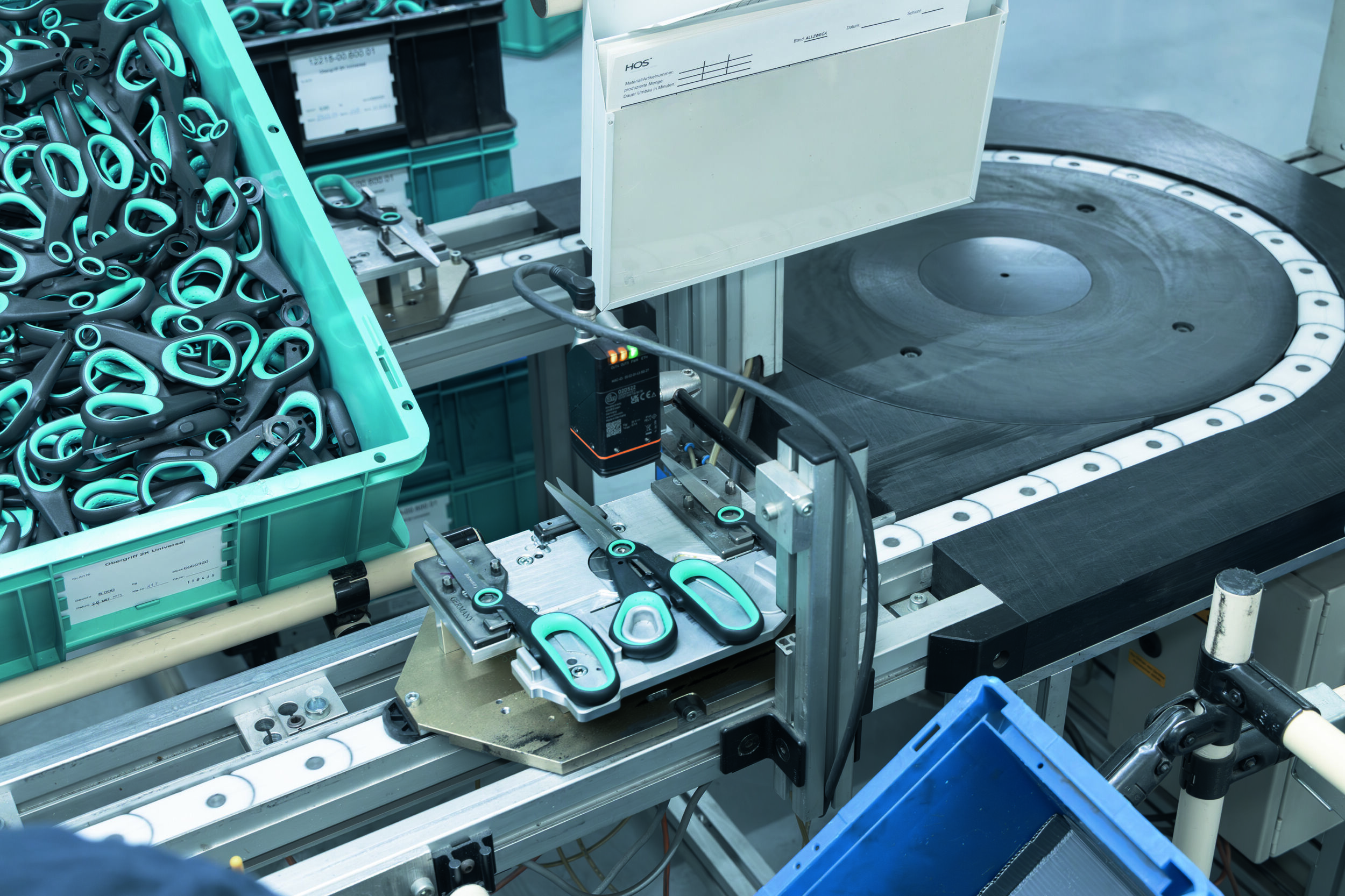

Gerade bei Inspektionen von runden bzw. rotierenden Objekten oder bei langen oder Endlos-Materialien gehört der Einsatz von Zeilenkameras zum Stand der Technik. Beim Einrichten einer Zeilenanwendung gibt es jedoch zwei Mankos: Erstens ist das Fokussieren schwieriger als bei Flächenanwendungen und zweitens macht die Anzahl der benötigten Komponenten eine Zeilenkameraanwendungen komplex und dadurch teurer. Als Interfaces kommen dort vorwiegend CameraLink (CL) und CoaXPress (CXP) zum Einsatz. Diese bieten zwar eine enorme Bandbreite (800MB/s bei CL bzw. 1,56GB/s bei CXP), erfordern jedoch einen Framegrabber am Host-PC. Dieser muss zudem die Features der eingesetzten Zeilenkamera (bspw. CL-Konfiguration, Sensor-Taps, Bit-Tiefe, etc.) unterstützen. Ferner ist die enorme Bandbreite auch nur für bestimmte Kabellängen (CL bis 10m; CXP bis 35m) garantiert. Kein Wunder, wenn sich die Anwender eine Vereinfachung und die Verwendbarkeit von Standardschnittstellen wünschen. Hier schafft der neue BlockScan-Modus für die Global Shutter Pregius-Flächensensoren von Sony abhilfe.

Funktionsweise BlockScan-Modus

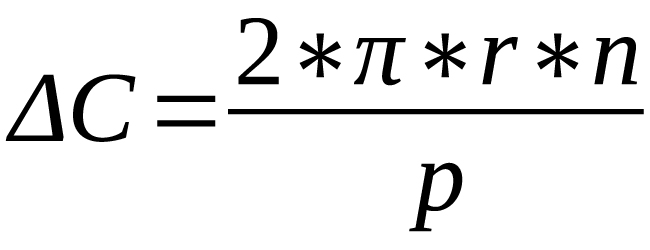

Anstatt eine Zeile zu triggern, nimmt der BlockScan-Modus einen Area of Interest (AOI) Block, bestehend aus mehreren Zeilen auf. Danach wird nicht jeder AOI-Block separat, sondern eine einstellbare Zahl an AOI-Blöcken zusammen als Gesamtbild übertragen. Dadurch wird der Overhead minimiert, den es anderenfalls bei der Übertagung der AOI-Blöcke als Einzelbilder durch das Transferprotokoll von USB3 bzw. GigE Vision geben würde. Um das Prinzip und die Handhabung des BlockScan-Modus besser nachvollziehen zu können, hat Matrix Vision einen Versuchsaufbau als White Paper veröffentlich, der im Folgenden kurz zusammengefasst ist: Auf einer rotierenden Trommel mit Inkrementalgeber ist ein Maßband angebracht, das nahtlos erfasst werden soll. Der Inkrementalgeber ist über die digitalen Eingänge einer mvBlueFOX3-2 USB3 Vision Kamera direkt mit ihr verbunden und triggert die Aufnahmen. Gleichzeitig wird über einen digitalen Ausgang der Kamera eine Beleuchtung angesteuert. Damit es zu keinen Lücken bzw. Überlappungen kommt, muss ermittelt werden, aus wie vielen Zeilen ein AOI-Block zusammengesetzt sein muss. Sobald der Inkrementalgeber ein Trigger-Signal sendet, hat sich die Trommel um einem bestimmten Winkel α weitergedreht, welcher den Kreisumfang ∆C abdeckt. r ist der Radius der Trommel und n ist die Anzahl der Pulse des Inkrementalgebers, bei denen dieser ein Trigger-Signal sendet. p ist die Anzahl der Pulse pro Umdrehung. Daraus ergibt sich für ∆C folgende Formel.

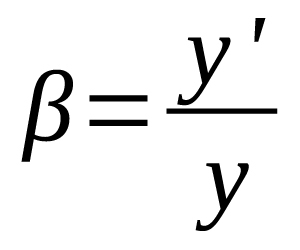

Damit die AOI-Blöcke (y1′, y2′, etc.) nahtlos im Gesamtbild aneinandergereiht werden, muss die Höhe des Sichtfelds eines jeden AOI-Blocks mit ∆C übereinstimmen:

Durch das Maßband kann die Objekthöhe y (mm) sowie die Bildhöhe y‘ (Pixel) abgelesen und damit der Abbildungsmaßstab β (Pixel/mm) des Objektivs ermittelt werden.