In die Tiefe

Neuer Sony ToF-Sensor für On-Board-Processing-Kamera

Der neue DepthSense-Sensor von Sony bietet in Kombination mit dem On-Board Prozessing der Time-of-Flight-Kamera Helios neue 3D-Möglichkeiten und ist sehr robust gegenüber ungünstigen Lichtverhältnissen.

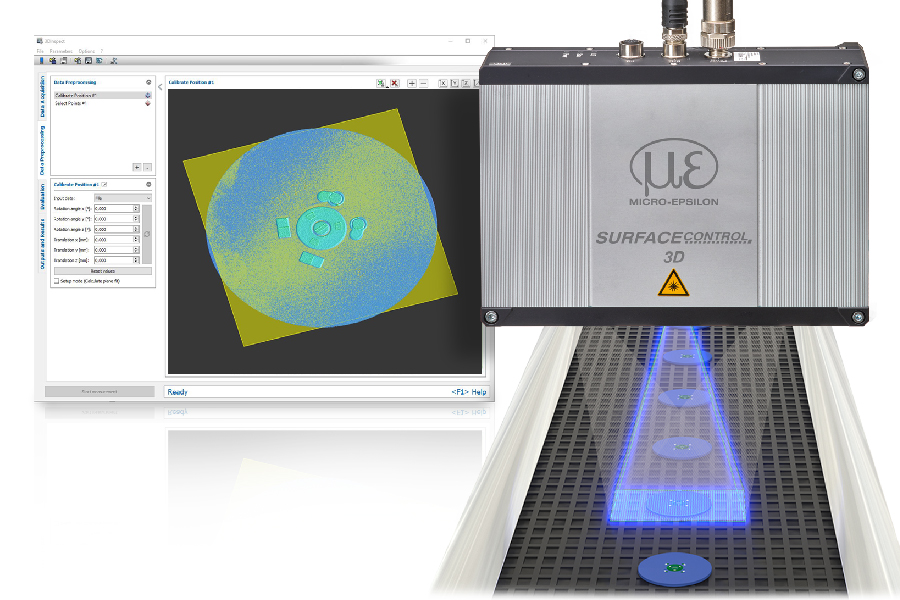

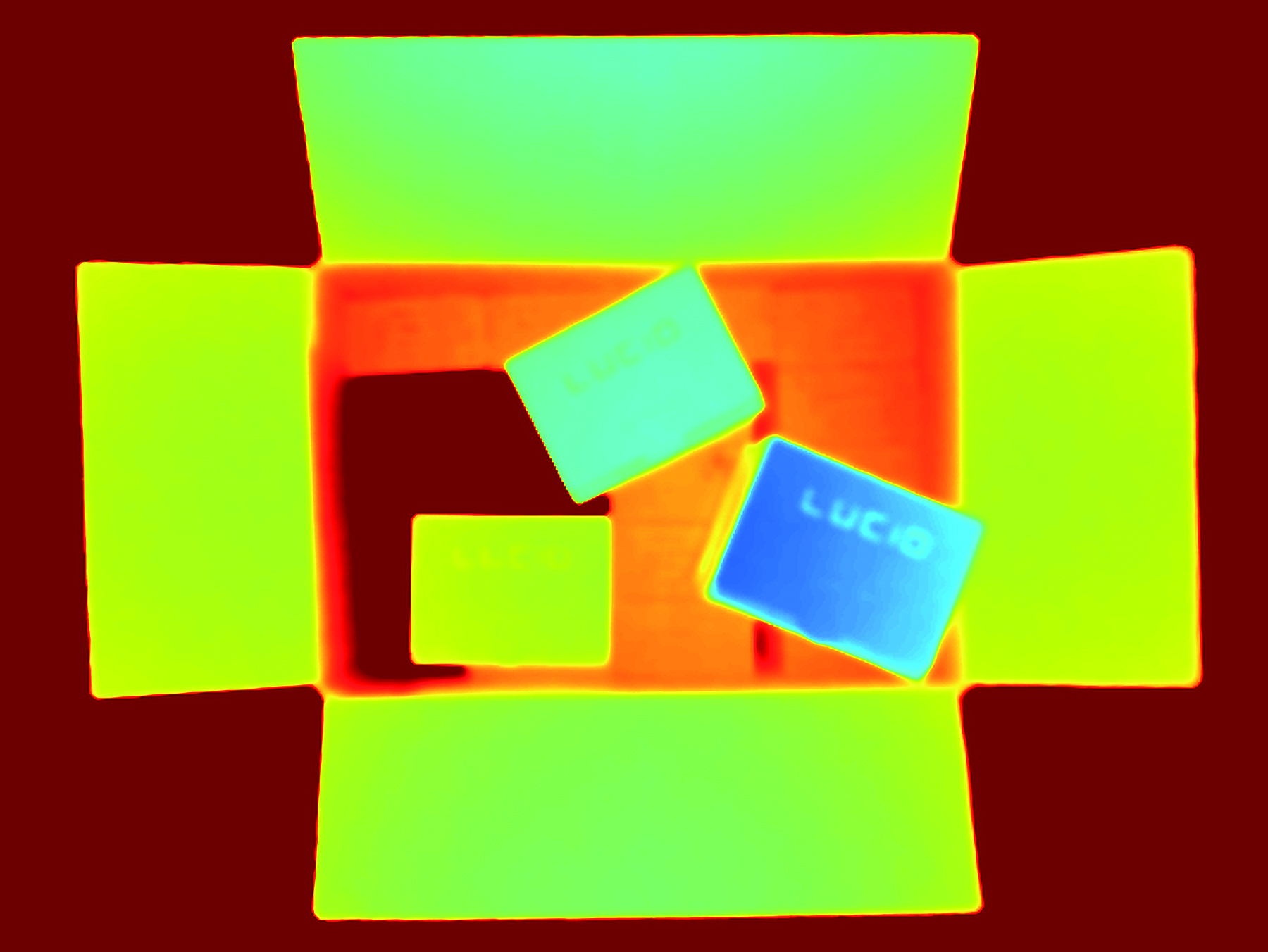

Bild 1 | Der neue DepthSense-Sensor IMX556PLR von Sony Bild 1 | Der neue DepthSense-Sensor IMX556PLR von Sony bietet eine Auflösung von 640×480 Pixeln. Live werden bis zu 60fps erfasst. Der Sensor ist in der Helios ToF-3D-Kamera von Lucid integriert, die in drei Arbeitsabständen betrieben werden kann. (Bild: Lucid Vision Labs, Inc.)

3D-Bildgebungssysteme können generell in aktive und passive Systeme unterteilt werden. In den passiven Systemen wird zur Beleuchtung des Objekts entweder das Umgebungslicht oder eine feste Beleuchtungsquelle verwendet. Die sogenannten aktiven Systeme nutzen dagegen verschiedene Verfahren mittels räumlicher oder zeitlicher Modulation von Licht, z.B. Laserlinienabtastung, Projektion von Punkt- oder Streifenmustern sowie Lichtpulsen. Ein Time-of-Flight (ToF) System vermisst die Laufzeit, die ein von der Kamera ausgestrahlter Lichtpuls benötigt, um auf dem Objekt zu reflektieren und zum Sensor zurückzukehren. Die zurückgegebene Information enthält sowohl die Reflektionseigenschaften des Objekts als auch die Zeitverzögerungsinformationen, die zur Berechnung der Tiefe verwendet werden. Mit herkömmlichen Laserscannern wird bei kurzen Arbeitsabständen eine Oberflächenauflösung von kleiner 10m erreicht. Viele Anwendungen wie Navigation, Personenüberwachung, Hindernisvermeidung oder mobile Roboter erfordern aber eine Reichweite von mehreren Metern. Dort ist es notwendig zu sehen, ob ein Objekt vorhanden ist, um dann dessen Lage und Abmessung auf wenige Zentimeter genau zu bestimmen. Andere Anwendungen wie automatisierte Handhabungssysteme (Robotik) arbeiten in mittleren Abständen von 1 bis 3m und benötigen eine Messgenauigkeit von etwa 1 bis 5mm. Für diese Anwendungen kann das ToF-Prinzip eine konkurrenzfähige Lösung sein. Bei allen 3D-Systemen wird das reflektierte Licht von dem beleuchteten Objekt mit einer CMOS-Kamera erfasst. Die Bilddaten werden dann rechnerisch in eine Tiefeninformation und falls erforderlich, in ein 3D-Modell des Objekts umgerechnet. ToF-Kameras verwenden grundsätzlich nur eine von zwei möglichen Techniken. Die Impulsmodulation (direktes ToF) oder Dauermodulation. Direktes ToF beinhaltet das Aussenden eines kurzen Lichtpulses und das Ausmessen der Zeit, die erforderlich ist, um über die Reflektion zur Kamera zurückzukehren. Bei der Dauermodulation wird ein Signal ausgesendet und die Phasendifferenz zwischen den emittierten und zurückkommenden Lichtwellen berechnet. Diese Verschiebung ist proportional zur Entfernung des Objektes.

ToF-Pixel-Sensor von Sony

Phasenbasierte Chips sind unter anderem von Texas Instruments und Panasonic erhältlich. Ein neuer Sensor wurde jetzt von Sony Semiconductor Solutions vorgestellt. Dieser wurde ursprünglich von SoftKinetics (jetzt Sony) entwickelt und verfügt über eine CAPD-Pixelstruktur (Current Assissted Photonics Demodulation), die eine extrem schnelle Abtastung mit hoher Effizienz ermöglicht. Diese ToF-Pixel-Technologie wurde mit der hochempfindlichen BSI-Produktionstechnik (Backside Illuminated) von Sony kombiniert, um daraus den ToF-Sensor der DepthSense Produktfamilie zu entwickeln. Die BSI-Technologie bietet eine wesentlich bessere Effizienz bei hohen NIR-Wellenlängen, denn die ausgesendeten Lichtpulse dürfen für das menschliche Auge nicht sichtbar oder schädigend sein. Der Sony IMX556PLR Sensor ist im optischen 1/2-Zoll Format und bietet eine Auflösung von 640×480 Pixeln bei 10m Pixelgröße. Live werden bis zu 60fps erfasst.