KI und Time-of-Flight für Fahrerlose Transportsysteme (FTS)

Mit künstlicher Intelligenz (KI) können autonome Maschinen heute komplexe Szenarien zuverlässig in Echtzeit einschätzen. Die KI-basierte Bildverarbeitungssoftware von Data Spree und die Time-of-Flight (ToF) Kameratechnologie von Becom zeigen im Zusammenspiel die Möglichkeiten für fahrerlose Transportsysteme (FTS).

Insbesondere in der Logistik ist Effizienz entlang der gesamten Prozesskette ein entscheidender Faktor im Wettbewerb. Eine zuverlässige und vor allem sichere Automatisierung des Warentransports ist hierbei entscheidend für eine moderne und leistungsfähige Logistik. Mitarbeiter und autonome Systeme müssen dabei in Lagern und Fertigungsstätten sicher zusammenarbeiten können, die Vermeidung von Unfällen hat höchste Priorität. Mit KI von Data Spree und 3D-Kameratechnik von Becom können autonome Fahrzeuge Personen und Hindernisse schnell und zuverlässig erkennen und entsprechend reagieren.

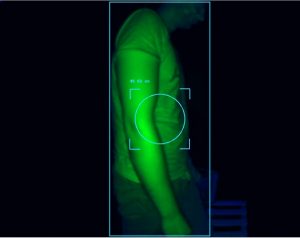

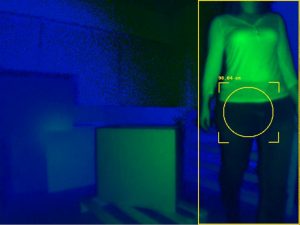

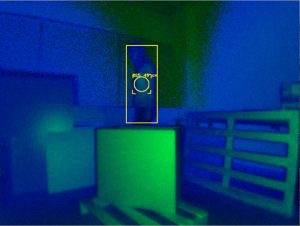

Zentimetergenaue Positionserfassung

Die 3D ToF-Kamera generiert ein Tiefen- und Graustufenbild, mit denen es möglich ist Objekte und Abstände zu Objekten im 3D-Raum zu lokalisieren. Die ToF-Technologie bietet dabei Vorteile gegenüber anderen Methoden der 3D-Bildgebung, beispielsweise eine weitgehende Unabhängigkeit von Lichtverhältnissen und hohe Robustheit gegenüber visuellen Variationen der Objekte. Die KI erkennt anhand der 3D-Informationen zuverlässig die Präsenz, Position und die Größe der eintrainierten Hindernisse, wie in diesem Fall Personen. Anschließend wird anhand der Tiefeninformationen die 3D-Position des Hindernisses Zentimeter-genau erfasst. Darüber hinaus kann der KI auch andere Hindernisse, wie FTS, Paletten, Pakete etc., zusätzlich antrainiert werden. Das Training und Erstellen der KI ist mithilfe der Data Spree Tools und Services, wie Deep Learning DS, sehr schnell und ohne Programmieraufwand umsetzbar. Mithilfe dieses KI-basierten 3D-Kamera Ansatzes kann eine robuste und sichere Orientierungslogik für FTS umgesetzt werden. Die dafür notwendige Echtzeit-Ausführung der KI findet auf dem Becom Multi-Cam HUB statt und bietet ein voll integriertes Zusammenspiel aus Bildgebung, KI-Logik und Kommunikation. Die kompakten ToF-Sensoren sind für mobile Anwendungen hervorragend geeignet und können, durch eine Kombination von mehreren Sensoren, eine vollständige 360°-Rundumsicht der Umgebung liefern. Die KI kann hierbei mit verschiedensten Szenarien und Situationen umgehen, da die Logik auf real existierenden Daten beruht und nicht frei von Hand programmiert ist. Mit den Data Spree Tool ist die KI jederzeit flexibel erweiterbar und kann auf neue definierbare Objekte oder Klassen antrainiert werden. Somit lassen sich komplexe Orientierungsmuster für FTS umsetzen, die mit konventionellen Methoden bisher nicht denkbar waren.

KI für die Logistik

Klassische Bildverarbeitung muss bisher aufwändig programmiert werden. Hierbei werden Algorithmen von Experten individuell entwickelt, was viel Know-How und Zeit erfordert. Dabei funktionieren die klassischen Algorithmen nach handgefertigten Regeln und Entscheidungskriterien. Wenn es zu Abweichungen von diesen Regeln im Betrieb kommt, entstehen Risiken. Diese Abweichungen können beispielsweise wechselnde Lichtverhältnisse, Umgebungsparameter, Veränderungen in den Wegen, Abläufen oder Prozessen sein. Mit KI-basierter Bildverarbeitung können, z.B. autonome Fahrzeuge komplexe Arbeitssituationen und -prozesse besser interpretieren und die Mensch-Maschine-Interkation sicherer machen. Je nach Training können KI-Netze auf verschiedene Hindernisse und Objekte angelernt werden, z.B. Packstücke, Paletten, Hochregale, Behälter etc. Dies eröffnet neue Möglichkeiten für autonome Fahrzeuge, aber auch für kollaborative Roboter oder Automatisierung im Allgemeinen.