Ist KI nicht möglicherweise zu komplex für den klassischen Automatisierungsanwender mit nur begrenzter Vision-Erfahrung?

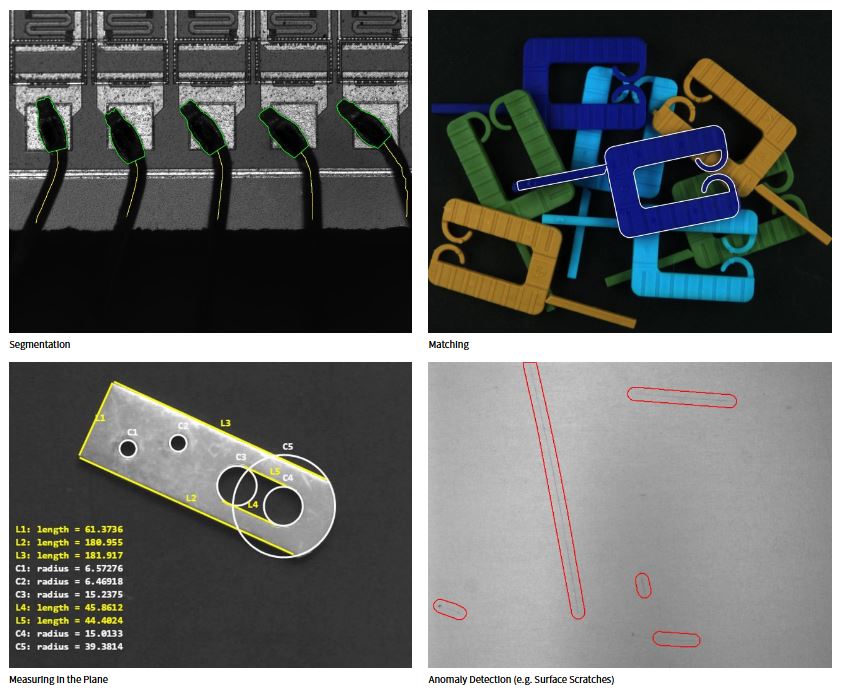

Anomaly Detection unterscheidet sich in der Anwendung kaum von herkömmlicher Bildverarbeitung, wenn es richtig eingesetzt und im Kontext der Automatisierung in eine integrierte Bildverarbeitung eingebunden wird. Die Komplexität fängt dann an, wenn Netzwerke nachtrainiert werden müssen, sei es, weil es für eine eindeutige Unterscheidung zusätzliches Bildmaterial benötigt wird oder sich Gut-/Schlecht-Ergebnisse zu sehr überschneiden. Ein Problem ist auch, dass regelbasierte Algorithmen und Deep Learning häufig ein Entweder/Oder und kein Sowohl-als-auch sind oder im besten Fall nur nebeneinander existieren. B&R geht hier einen Schritt weiter und ermöglicht dem Anwender die volle Freiheit, diese zwei Ansätze zu kombinieren – sowohl im Pre- als im Post-Processing.

Was verstehen sie darunter?

Nehmen wir als Beispiel das Global Context – Anomaly-Detection-Netzwerk. Dieses generiert als Ergebnis einen Anomalie-Score und eine Heatmap, also quasi die Landkarte, auf der die Anomalien zu sehen sind. Typischerweise wird bei der Evaluierung eines trainierten Netzwerks versucht, durch Gut- und Schlechtbilder einen passenden Schwellwert zu definieren, der eine eindeutige Unterscheidung ermöglicht. Häufig gibt es hier aber die bereits erwähnte Überlappung, was die Angelegenheit kompliziert macht. Durch Analyse der false positive und false negative Ergebnisse und einem neuerlichen Review der Trainingsdaten sowie einem abschließenden neuen Training wird dann üblicherweise versucht, einen robusten Schwellwert zu erhalten, was nicht immer möglich ist.

Und was macht B&R hier anders?

B&R stellt zwar auch diese AI-generierten Scores zur Verfügung, ermöglicht jedoch parallel, die Heatmap mit regelbasierten Algorithmen zu bewerten. So kann mit sehr einfachen und verständlichen Parametern eine Unterscheidung zwischen sehr großen oder sehr stark ausgeprägten Abweichungen erfolgen. Das Kriterium einer Bewertung kann aber auch einfach die Anzahl vieler kleiner Abweichungen oder deren Mittelwert in sensiblen Bereichen sein. Damit reduziere ich nicht nur die Komplexität beim Training des Deep-Learning-Netzwerks. Diese Vorgehensweise ermöglicht auch eine nachvollziehbare Skalierung der Fehlerschwelle und erhöht damit deutlich die Effizienz einer Maschine. Das ist etwa der Fall, wenn bei einem bestimmten Produkt beispielsweise Abweichung A kein Problem ist oder fertigungstechnisch gar nicht ausgeschlossen werden kann, während Abweichung B entscheidend die Qualität beeinflusst. Eine ausschließlich auf den Anomalie-Score beschränkte Bewertung würde dagegen unnötigen Ausschuss produzieren. Eine zusätzliche Bewertung mit regelbasierten Algorithmen ist nicht nur leichter nachvollziehbar und zur Laufzeit einfach adaptierbar, sondern ermöglicht auch eine regelbasierte Klassifizierung von Ergebnissen in verschiedenen Qualitätsklassen.