Die Aufgabe ist eigentlich einfach: Während der Fertigung sollen Objekte im Zentimeterbereich und darunter in 3D erfasst werden. Die Streifenprojektion unter Verwendung einer Kamera und eines aktiven Projektors ist hier ein etabliertes Messverfahren. Für die Qualitätssicherung muss die Auflösung im unteren Mikrometerbereich sein, der Aufwand gering und die Geschwindigkeit möglichst groß. Bei einem Messfeld von 150x100mm², einem mittleren Objektabstand von 330mm und einer gewünschten Auflösung von 0,05mm (zehn Linienpaare pro mm), wird schnell klar, dass eineMesstiefe größer 20mm nicht mit einem konventionellen Objektiv zu erreichen ist. Das Problem ist die Schärfentiefe. Rein physikalisch ist die nötige Auflösung nur wenige Millimeter vor und hinter der Fokusebene der Optik zu erreichen.

Eine gängige Lösung aus der Fotografie ist Fokus-Stacking. Mit 80ms Schaltzeit sind Autofokusobjektive aber recht langsam für Inline-Anwendungen, eine Flüssiglinse dagegen meist zu ungenau. Eine Arbeitsgruppe des Fraunhofer IOF und Docter Optics hat in einem BMBF-Projekt für diese Anwendungen eine Alternative entwickelt. Der Grundgedanke dabei ist, dass jede Wellenlänge hinter einer Linse eine eigene Fokuslage hat. Ein großer Teil der technischen Optik beschäftigt sich mit der Frage, wie diese chromatischen Aberrationen minimiert werden können. Man kann das Problem aber auch als Chance sehen und die Fokuslage verändern, indem man die Wellenlänge wechselt. Mit einem geeigneten Optikdesign lassen sich damit zwei Fokuslagen, also zwei scharfe Bereiche, aus zwei Beleuchtungsfarben erzeugen.

Chromatisches Fokus-Stacking

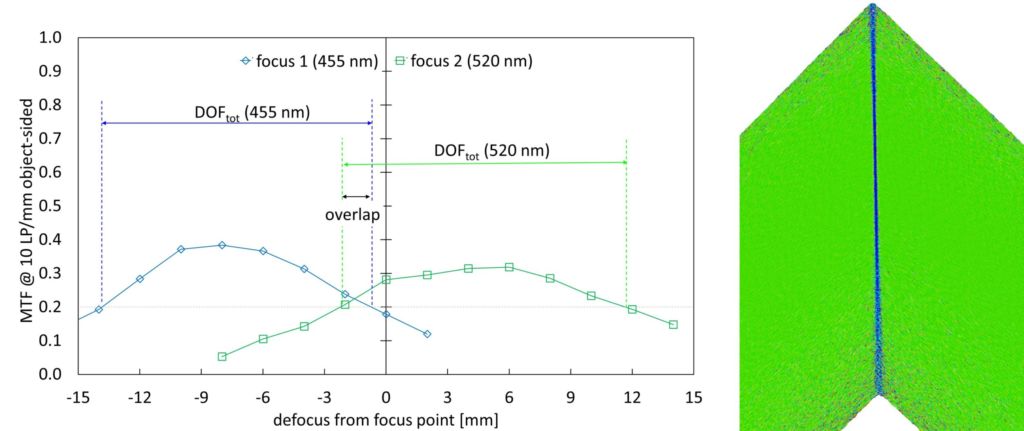

Bild 2 zeigt den Verlauf der Schärfentiefe für zwei verschiedene Wellenlängen: blau (455nm) und grün (520nm). Beide Bereiche ergänzen sich, d.h. insgesamt wächst der Bereich mit der nötigen Schärfe von 13mm auf etwa 25mm. Dabei ist das Emissionsspektrum der Farblichtquellen relevant und muss zum Optikdesign passen. Für die konkrete Messung wurde eine Ximea Kamera mit 5.120×3.980 Pixeln verwendet. Um 3D-Daten mit einer 2D-Kamera zu erhalten, werden pro Farbe jeweils vier verschiedene Muster auf die Werkstückoberfläche projiziert. Mit dieser strukturierten Beleuchtung können in einem kalibrierten Aufbau jedem Bildpunkt eineindeutig 3D-Koordinaten zugeordnet werden. Die farbigen Muster werden mit einem digitalen RGB-Projektor von Texas Instruments erzeugt.

Neues Verfahren 5x schneller

Nachdem die nötige Schärfentiefe gegeben ist, bleibt die Frage der maximalen Geschwindigkeit. Die Kamera benötigt 5,5ms (180Hz) für eine Aufnahme. Bei vier Mustern pro Farbe müssen acht Bilder für einen 3D-Datensatz aufgenommen werden. Bei Vernachlässigung der Schaltzeiten der LEDs ergibt sich eine Aufnahmezeit von 8×5,5ms = 44ms für eine 3D-Messung. Zum Vergleich wurde derselbe Versuch mit einem Objektiv mit motorisiertem Fokus durchgeführt, wo 2x80ms für die Verschiebung der Fokuslage um 10mm zu addieren wären. Das neue Verfahren ist also fünf Mal so schnell wie der konventionelle Ansatz. Das chromatische Fokus-Stacking ermöglicht in diesem Fall eine 3D-Aufnahmerate von 20 Hertz mit je über 20 Millionen 3D-Messpunkten. Die Detailschärfe bei der Aufnahme wurde mit einem Keil geprüft (Bild 2 rechts), dessen Spitze eine nahezu scharfe Kante bildet. Hiermit wurde die 3D-Schärfentiefe von größer 20mm verifiziert.

Das Verfahren lässt sich vielseitig anwenden. Bild 1 zeigt die 3D-Aufnahme einer Elektronikplatine. Dort ist die Höhe und Position der Teile ein Qualitätskriterium. Ganz ähnlich lässt sich das Verfahren auch bei biometrischen Vermessungen oder in der Mensch-Maschine-Kommunikation einsetzen. Die Adaption auf mehr und andere Wellenlängen ist denkbar. Das neue Verfahren erreicht eine Abbildungsqualität, die mit der eines Objektivs mit motorisiertem Fokus vergleichbar ist, in einer deutlich kürzeren Zeit und ohne bewegliche Linsen. Die hier diskutierten Ergebnisse der technischen Grundlagenuntersuchung wurden inzwischen in einen Prototyp für einen Kunden umgesetzt.