Anomaly Detection

Anomalien einfach und zielsicher mit wenigen Bildern erkennen

Deep-Learning-Verfahren werden sowohl für die Identifikation von Objekten als auch für die Detektion von Fehlern eingesetzt. Mit der Anomaly Detection in Halcon 19.11 lassen sich nun auch Anomalien lokalisieren, deren Aussehen und Erscheinungsform im Vorfeld nicht bekannt sind. Dabei werden defektfreie Bilder für das Training genutzt, was den Aufwand deutlich reduziert.

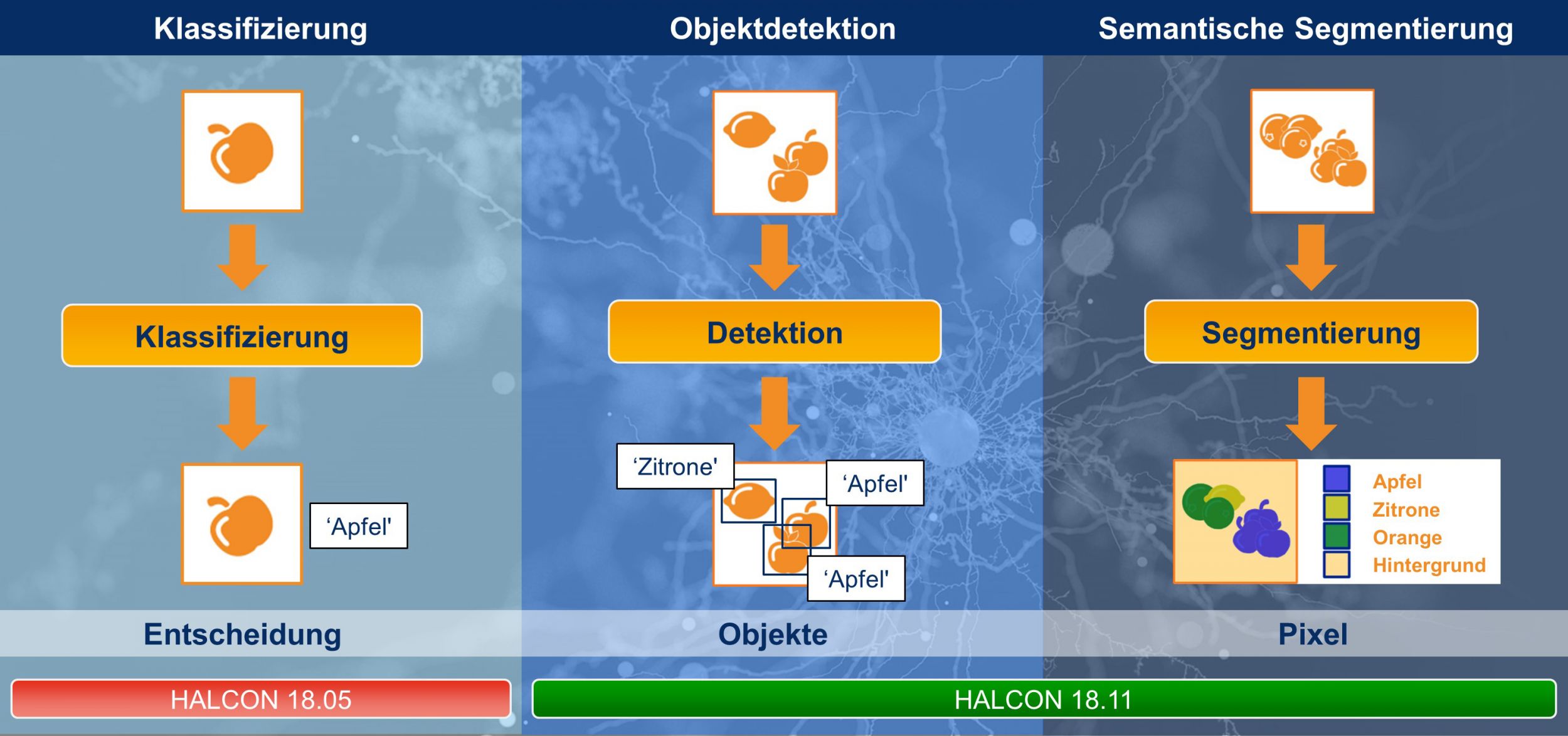

Bild 1 | Klassifikation, Objektdetektion und semantische Segmentierung sind Deep-Learning-basierte Erkennungsmethoden. (Bild: MVTec Software GmbH)

Die industrielle Bildverarbeitung spielt eine wichtige Rolle bei der Fehlerinspektion im Rahmen der Qualitätssicherung von Produkten. Hierbei kommen regelbasierte Systeme ebenso zur Anwendung wie moderne Technologien auf Basis von künstlicher Intelligenz (KI). In erster Linie zählt dazu Deep Learning, das auf Convolutional Neural Networks (CNNs) beruht. Regelbasierte Lösungen müssen sehr viele verschiedene Erscheinungsformen von Anomalien abdecken und erfordern daher einen entsprechend hohen Programmieraufwand. Demgegenüber besteht der entscheidende Vorteil von KI-Systemen darin, dass sie durch Training eigenständig dazulernen. Dabei läuft das Aufspüren von Defekten in mehreren Schritten ab: Zunächst muss eine genügend große Anzahl von Trainingsbildern von allen zu erkennenden Defekten gesammelt werden. Diese werden dann gelabelt, also mit einem Etikett versehen, und anschließend wird das zugrundeliegende CNN mit diesen Bildern trainiert.

Einteilung in Klassen durch Labeling-Prozess

In diesem Kontext kommen Deep-Learning-Algorithmen in verschiedenen Erkennungsverfahren zur Anwendung: Bei der Klassifikation werden Objekte oder Fehler rein anhand von Bilddaten in bestimmte Klassen eingeteilt. Bei der Objektdetektion erfolgt der Labeling-Prozess durch das Einzeichnen von Rechtecken. Diese rahmen in jedem einzelnen Bild die zu erkennenden Gegenstände ein und geben dann entsprechend der jeweiligen Applikation die Objektklasse an. So lernt der Deep-Learning-Algorithmus, welche Merkmale zu welcher Klasse passen. Im Ergebnis lassen sich dann Objekte oder Fehler automatisch lokalisieren und einer speziellen Klasse zuordnen. Bei der semantischen Segmentierung schließlich wird jeder einzelne Pixel eines Bildes einer bestimmten Klasse zugewiesen. Das Ergebnis sind Regionen, die einer Klasse zugeordnet werden können. Die Herausforderung bei allen Deep-Learning-basierten Erkennungsmethoden ist allerdings, dass sie oft eine relativ hohe Anzahl von Trainingsbildern erfordern, die alle gelabelt werden müssen, um sie einer Klasse zuzuordnen. Zudem werden für den Trainingsprozess Bilder benötigt, auf denen Objekte mit den zu erkennenden Defekten zu sehen sind. So müssen je nach Anwendung 300 Bilder und mehr aufgenommen werden, die den entsprechenden Gegenstand mit einem bestimmten Fehler wie einem Kratzer oder einer Verformung in verschiedenen Ausprägungen zeigen. Dies zieht einen hohen Aufwand nach sich, den viele Unternehmen scheuen. Überdies gibt es Applikationen, bei denen solche Schlecht-Bilder nicht in ausreichender Anzahl zur Verfügung stehen.