Herausforderungen bei 3D-Multi-Sensor-Netzwerke

Intelligentes Netzwerken

Erfolgreiches Arbeiten mit 3D-Multi-Sensor-Netzwerken

Überschreitet ein Objekt die maximale Scangröße eines einzelner 3DSensors, oder sind mehrere Sensoren zur Erkennung von Schlüsselmerkmalen nötig, ist der Einsatz von Multi-Sensor-Netzwerken erforderlich. Die vier Herausforderungen hierbei sind (a) die Verkabelung der Sensoren, (b) Erkennung, Zuweisung und Mapping der Sensoren, (c) Ausrichtung der Sensoren zu einem gemeinsamen Koordinatensystem sowie (d) zentralisierte oder verteilte Netzwerkverarbeitung.

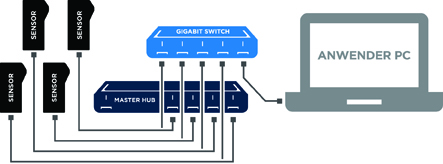

Einrichtung eines Multi-Sensor-Netzwerkes mit intelligenten Gocator 3D-Sensoren. (Bild: LMI Technologies Inc.)

Sensorverkabelung

Die Konfiguration eines Sensornetzwerkes bedarf einer Sterntopologie. Im Gegensatz zu Bustopologien, wie bei USB oder Firewire, bleiben Netzwerke mit einer sternförmigen Verkabelung (z.B. Ethernet) betriebsbereit, selbst wenn ein Teilnehmer ausfällt. Bei Sterntopologien führt die Verkabelung, welche die Sensoren mit dem zentralen Knoten verbindet, Spannungsversorgung, Daten und Signale zur Synchronisierung. Vereinfacht wird diese Verkabelung mit einem Masterhub mit bis zu 24 Anschlüssen. Der Masterhub ist eine spezifische Lösung zur Stromversorgung und Microsekundensynchronisierung der vernetzten Sensoren. Die Synchronisationssignale werden an alle Sensoren übertragen und sind mit einem Zeit- und Encoderstempel, sowie dem Status digitaler Eingänge (z.B. für Photozellen) versehen, die mit dem Hub verkabelt sind. Die Sensordaten werden über einen Gigabit Ethernet Switch zur Verarbeitung an einen zentralen PC übertragen.

Erkennung, Zuordnung und Anordnung

Nach der Verkabelung des Sensornetzwerkes, werden über die integrierte Sensorsoftware die Sensoren im Netzwerk identifiziert und ihnen eine physikalische Position zugewiesen. Das Anordnen ist für ein späteres Zusammenfügen der Daten zu einem Datensatz wichtig. Folgende Sensoranordnungen sind die Gängigsten:

- Breite Anordnung: Zur Messung großer Objekte, die das Sichtfeld eines einzelnen Sensors überschreiten.

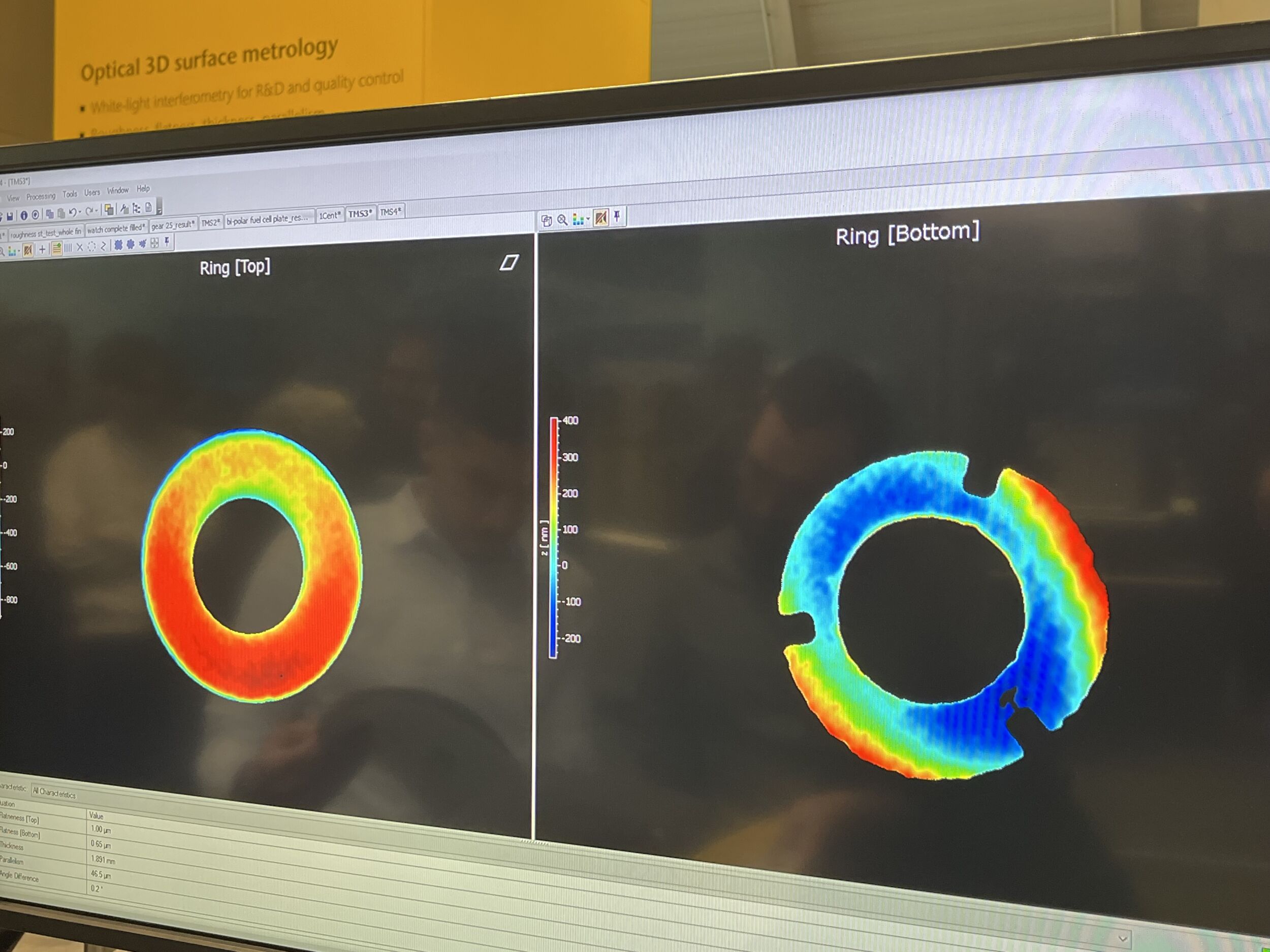

- Gegenüberliegende Anordnung: Zwei Sensoren führen von oben und unten Differenzialmessungen durch, um eine Dicke zu berechnen.

- Ringförmige Anordnung: Es werden mehrere Sensoren in bestimmten Winkeln oder ringförmig zur Beseitigung von Abschattungen und zur Messung des Umfangs eines Objektes angeordnet, z.B. beim Scannen von Baumstämmen.

Alle Sensoren eines Netzwerkes müssen zu einander ausgerichtet sein, um Messungen einer absoluten Position auf dem Objeken entstehen, in ein gemeinsames Koordinatensystem gewandelt (Weltkoordinatensystem). Der Ausrichtungsvorgang kann unterschiedlich umgesetzt werden. Entweder wird ein bekannter Gegenstand mit einer bestimmten Größe und Form von allen Sensoren gescanned. Die Scans nutzen einen oder mehrere Merkmale des Gegenstandes, um die Position des Sensors in Weltkoordinaten zu ermitteln. Eine andere Methode besteht in der Nutzung eines Laser-Trackers und Reflektoren welche an den Gehäusen der Sensoren angebracht sind, um die Ausrichtung und Position der Sensoren in einem Weltkoordinatensystem zu erfassen.

Zentralisierte und verteilte Netzwerke

In einem zentralisierten Netzwerk werden Daten verschiedener Sensoren in eine einzige 3D-Punktwolke zusammengeführt. So werden bei einer Vorrichtung zur Holzoptimierung Daten aus den sich überlappenden oberen und unteren Sensoren zusammengeführt, um ein einziges 3D-Modell der Bretter mit zwei Oberflächen (oben/unten) zu erstellen. Diese werden zur maximalen Volumennutzung analysiert. Ein anderes Beispiel ist die Portionierung von Lebensmitteln (z.B. Fleisch), bei dem die Daten zu einem einzigen 3D-Modell zusammengeführt werden, um so eine Minimierung des Abfalls zu erreichen. Im Gegensatz zu dem zentralisierten Netzwerk überlappen sich die Sensoren in einem verteilten Netzwerk nicht und es treten Datenlücken auf, weshalb in der Regel nicht eine 3D-Punktwolke erstellt wird. Ein Beispiel ist die Inspektion von Karosserien, bei der Sensoren strategisch um den Metallkörper angebracht sind, um Hauptmerkmale zu messen. In dieser Anwendung erfassen die Sensoren nicht die gesamte Oberfläche, sondern lediglich die Bereiche, bei denen eine Überprüfung der Merkmale erforderlich ist. In beiden Netzwerken, erzeugen die Sensoren die Daten in Weltkoordinaten, sodass eine Zuordnung der Positionen möglich ist.

Multi Sensor-Netzwerke

Die einfachsten Netzwerke bestehen aus zwei Sensoren (Main/Buddy). Diese werden gewöhnlich zur Berechnung von Dicken oder zur Erkennung von zwei Kanten in einer breiten Materialbahn eingesetzt. Die gesamte Konfiguration eines Buddy-Systems erfolgt über die integrierte Weboberfläche des Gocators. Der Main-Sensor erkennt den Buddy-Sensor automatisch, wenn beide an das gleiche Netzwerk angeschlossen sind. Nach der Kopplung beider, sendet der Buddy-Sensor seine Daten an den Main-Sensor. Beide Datensätze werden in einem gemeinsamen Koordinatensystem zusammengeführt. Zur leichteren Bedienung nutzt das duale Sensorsystem eine einzige Benutzeroberfläche. In vielen Fällen ist allerdings mehr als ein Buddy-Sensor erforderlich, z.B. wenn wie in der Holzindustrie 20 Sensoren (zehn oben und unten) ein Brett scannen, um eine 3DPunktwolke zur Volumenmessung und Qualitätsprüfung zu erstellen. Da in diesen Fällen große Datenmengen anfallen, erlaubt die Gocator Accelerator (GoX) Technologie die Verarbeitung der gesamten Sensordaten auf einem leistungsfähigen PC.