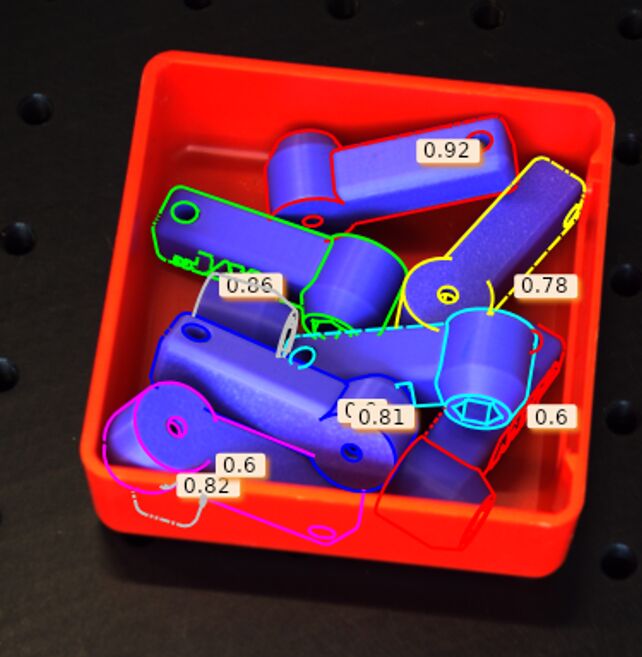

Bin-Picking-Aufgaben gelten als Königsdisziplin und sind, je nach Anzahl der ungeordnet liegenden Objekte und den Rahmenbedingungen, kaum oder sogar gar nicht automatisierbar. Eine neue 3D-Matching-Technologie sorgt mithilfe von Deep-Learning-Algorithmen für robuste Erkennungsraten, auch unter schwierigsten Bedingungen. Damit wird der ‚Griff in die Kiste‘ auch bei vielen, willkürlich liegenden Objekten immer einfacher, sicherer und – da das Verfahren nur 2D-Bilddaten benötigt – auch kostengünstiger.

3D-Positionen aus 2D-Bildern

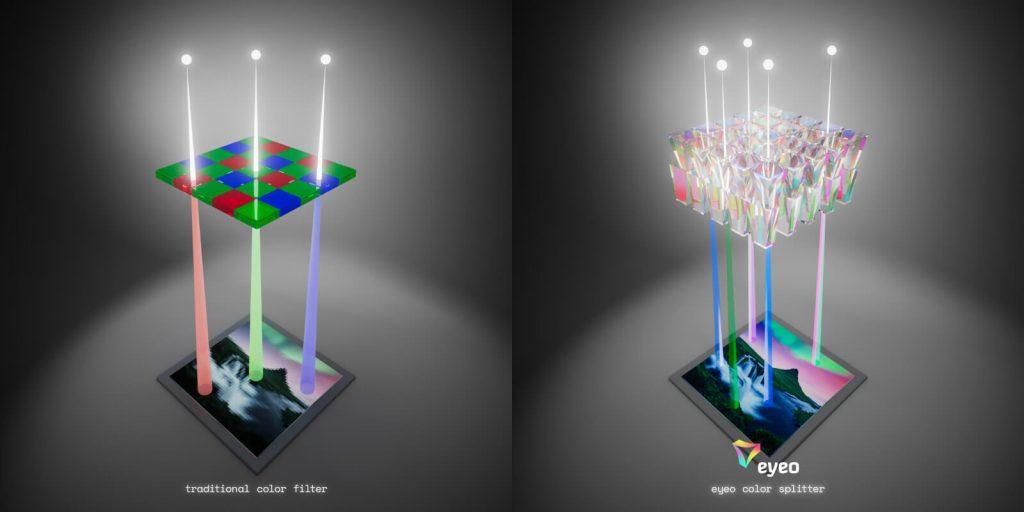

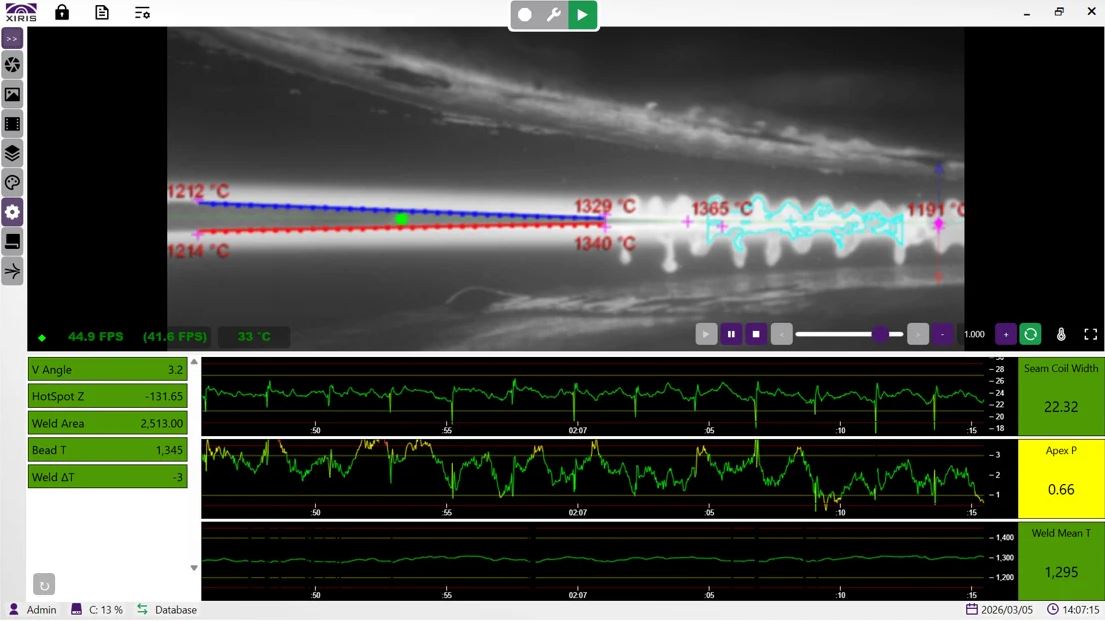

Bei Bin-Picking und Pick&Place-Applikationen kommen im industriellen Umfeld vermehrt Vision-Systeme mit integrierten Matching-Technologien zum Einsatz. Damit diese brauchbare Erkennungsraten liefern, bedarf es zumeist einer aufwändigen Parametrisierung. Hierbei müssen verschiedenste Parameter innerhalb des Vision-Systems wie etwa die Beleuchtung, die Kameraposition, die Bildauflösung oder spezielle Analyse-Algorithmen präzise angepasst und eingestellt werden. Dies verursacht Aufwand, ist aber unerlässlich, um das System exakt auf die spezifischen Anforderungen der Matching-Aufgabe abzustimmen. Zudem benötigen klassische Matching-Technologien für die genannten Anwendungen im 3D-Raum meist teure 3D-Kameras für die Aufnahme der Bilder, was die Kosten für das Hardware-Setup steigen lässt. Derlei Einschränkungen werden mit der neuen Technologie Deep 3D Matching vermieden. Sie ist integraler Bestandteil der Version 25.05 der Machine-Vision-Standardsoftware Halcon. Als eine der ersten Technologien dieser Art kombiniert Deep 3D Matching ausgefeilte Deep-Learning-Algorithmen mit regelbasierten Verfahren und erreicht dadurch bisher nicht gekannte und robuste Erkennungsraten. Das Besondere: Die Technologie nutzt mehrere 2D-Bilder, um die Position von Objekten im 3D-Raum zielsicher zu bestimmen.

Weniger mehrdeutige bzw. falsch-positive Ergebnisse

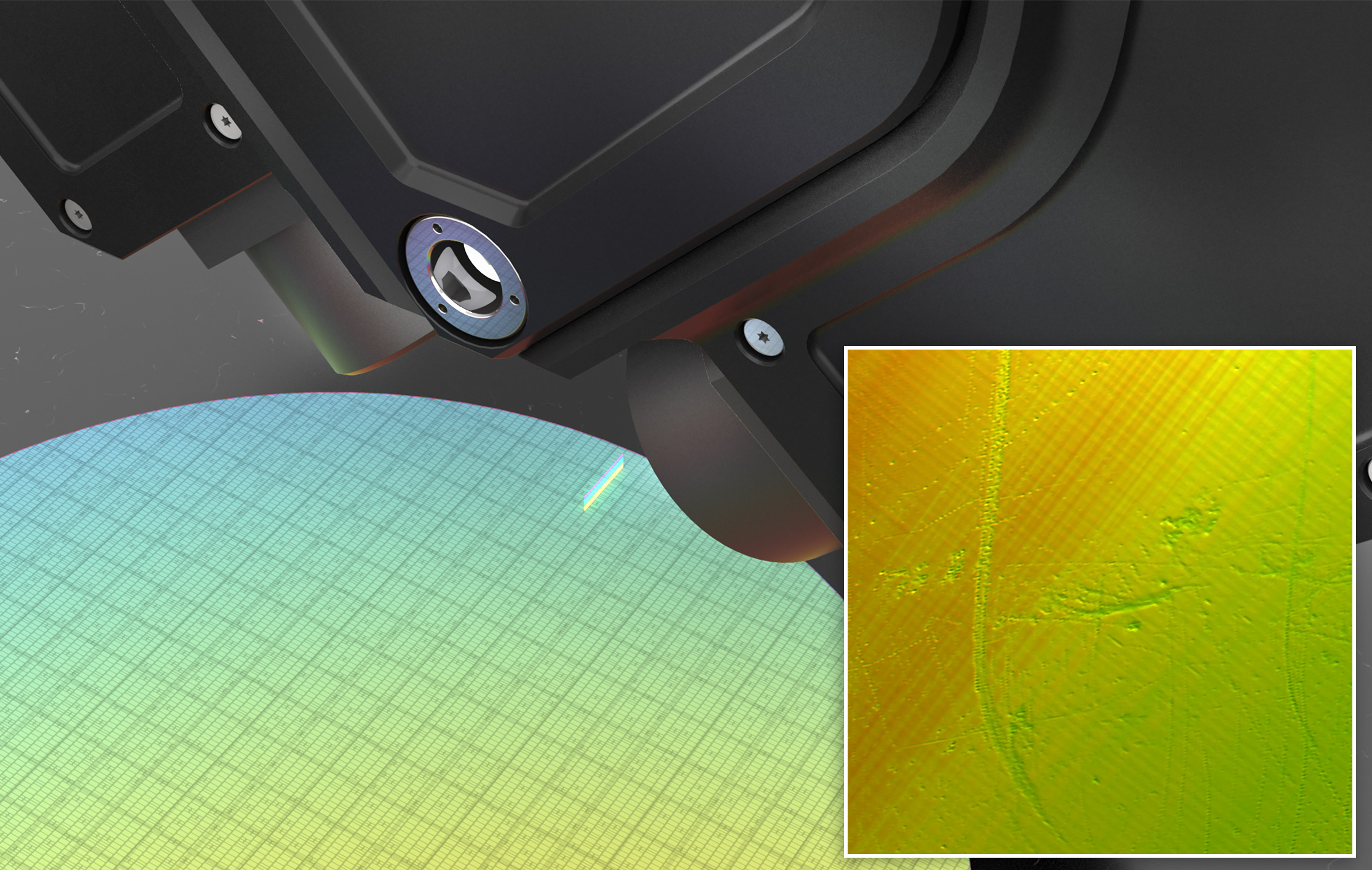

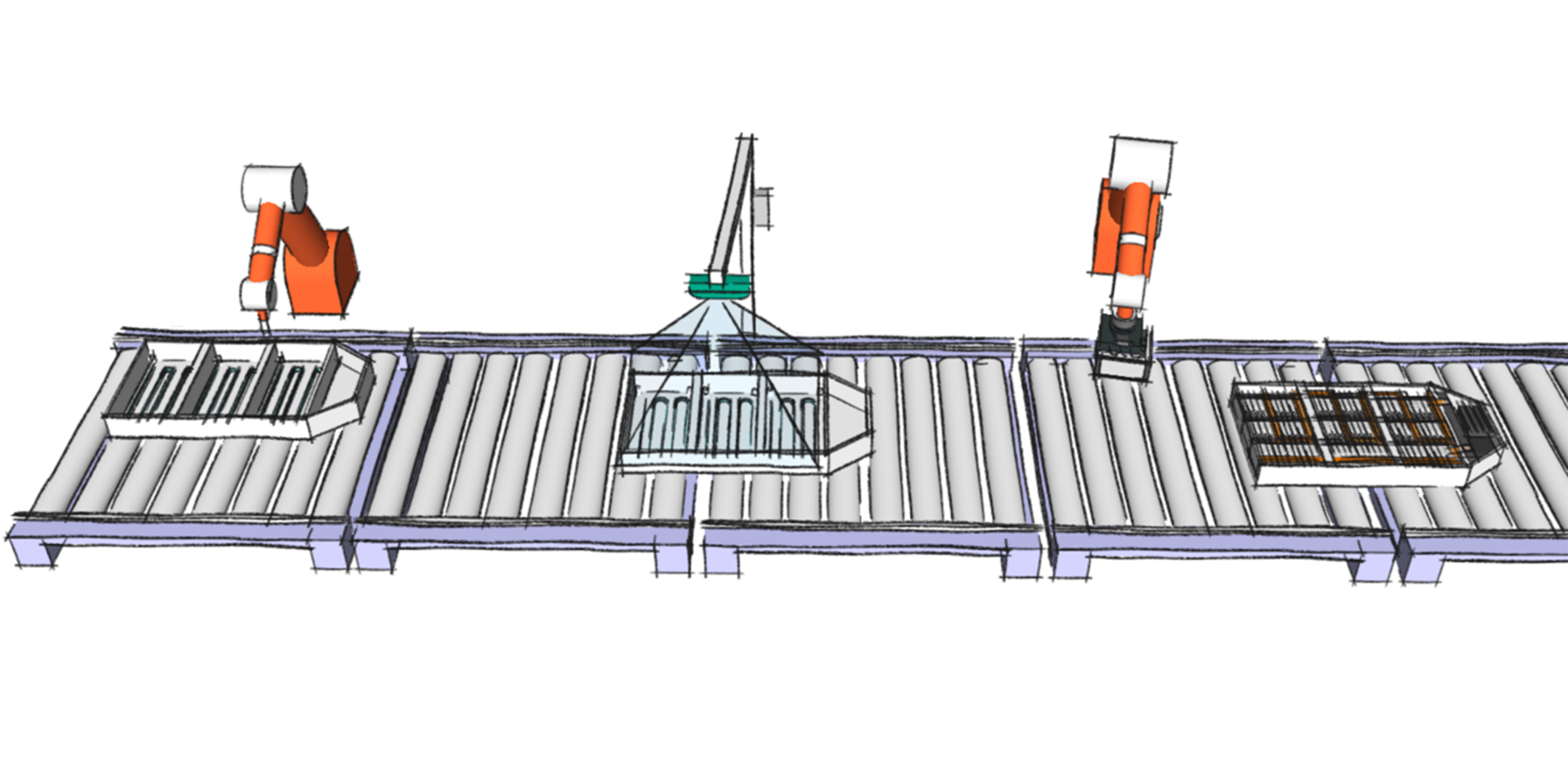

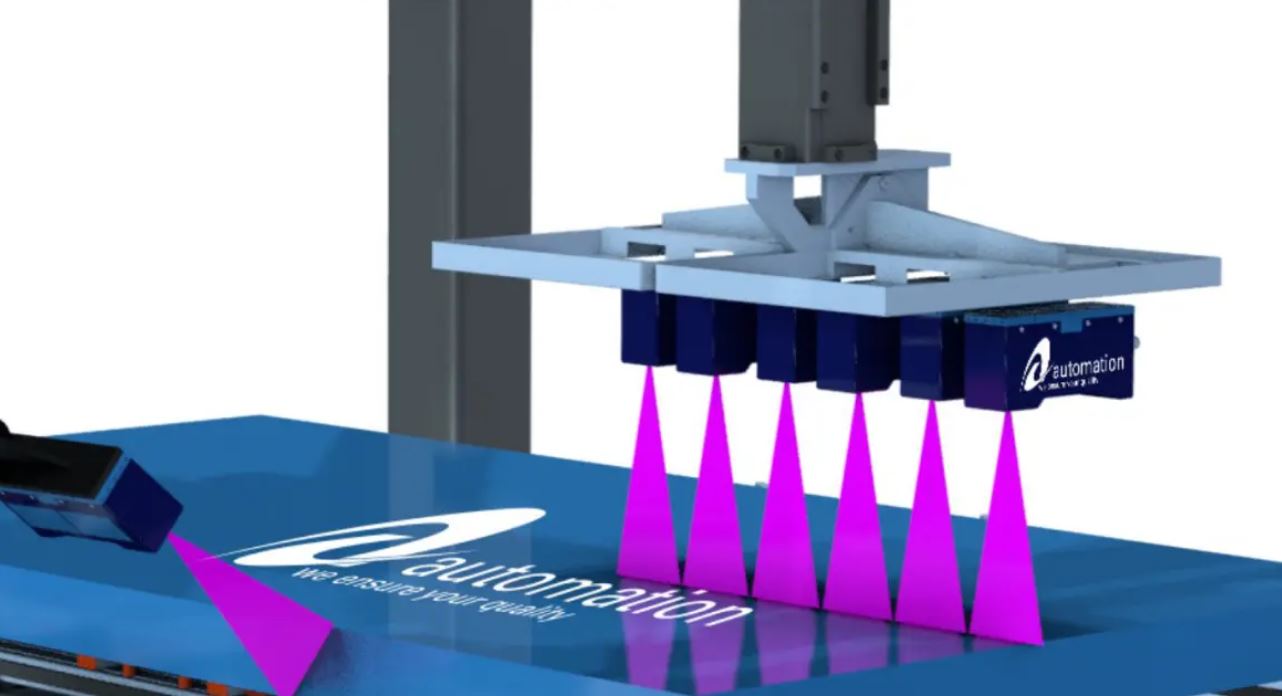

Anwendungen werden am besten mit einem flexiblen Kamera-Aufbau realisiert: Eine variable Anzahl von 2D-Kameras generieren Bilder aus verschiedenen Perspektiven. Dadurch werden mehrdeutige und falsch-positive Ergebnisse auf ein Minimum reduziert. Hierbei gilt: Je mehr Kameras installiert werden, desto robuster gestalten sich die Identifikationsraten. Die ideale Anzahl an Kameras ist dabei abhängig von der konkreten Anwendung. Mithilfe von Deep 3D Matching lassen sich flexibel mehrere Kameras hinzufügen. Dabei fallen lediglich Kalibrierungsarbeiten von wenigen Minuten an, was den Aufwand deutlich reduziert. Außerdem lassen sich durch den Einsatz von preisgünstigen 2D-Kameras Kosten einsparen. Zudem ist es möglich, eine oder mehrere Kameras auf bewegte Objekte zu richten, z.B. auf einem Fließband. Eine weitere Möglichkeit besteht darin, die Kamera(s) auf einem beweglichen Roboterarm zu montieren und dadurch die Genauigkeit zu erhöhen sowie das Sichtfeld zu erweitern.

Synthetische Bilddaten

Darüber hinaus punktet Deep 3D Matching mit weiteren Vorteilen: So reichen für das Training ausschließlich synthetisch erzeugte Bilddaten aus. Diese lassen sich, beispielsweise anhand der CAD-Daten der zu erkennenden Objekte komplett automatisiert generieren, was enorm Zeit und Kosten spart. Zudem entfällt der gesamte Aufwand für das Labeln der Bilder. Überdies profitieren Anwender von einem zusätzlichen entscheidenden Vorteil: Es ist nur ein geringes Maß an Parametrisierung erforderlich, um dennoch robuste Erkennungsraten zu realisieren. Dabei ist die Technologie sehr resilient gegenüber Veränderungen in den Hintergründen, in der geometrischen Anordnung der Objekte sowie hinsichtlich verschiedener Farben oder Materialien der Teile. Auch Fremdkörper im Bild wirken sich nicht negativ auf die Ergebnisse aus.

www.mvtec.com