Bewegte Objekte in Echtzeit

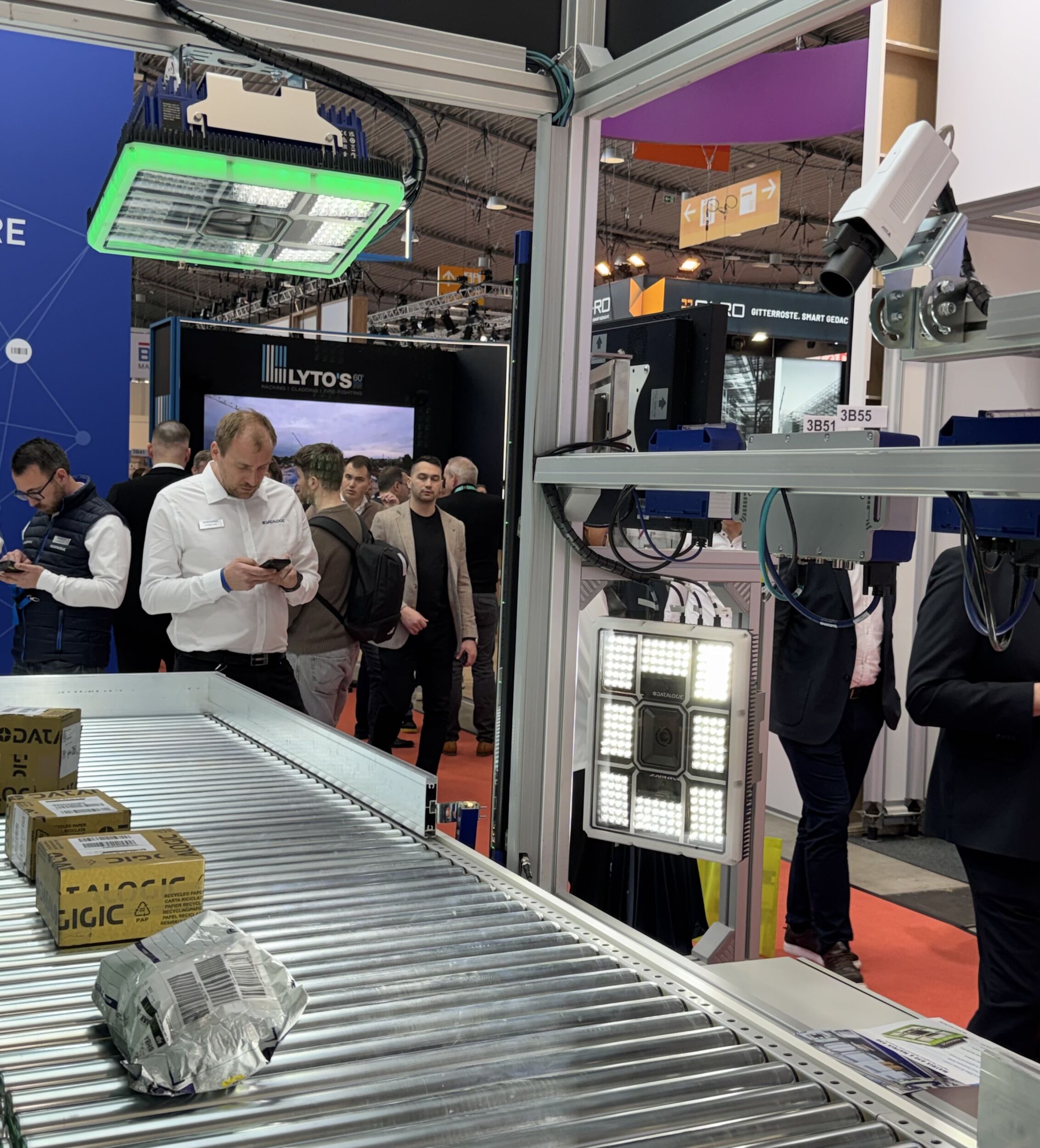

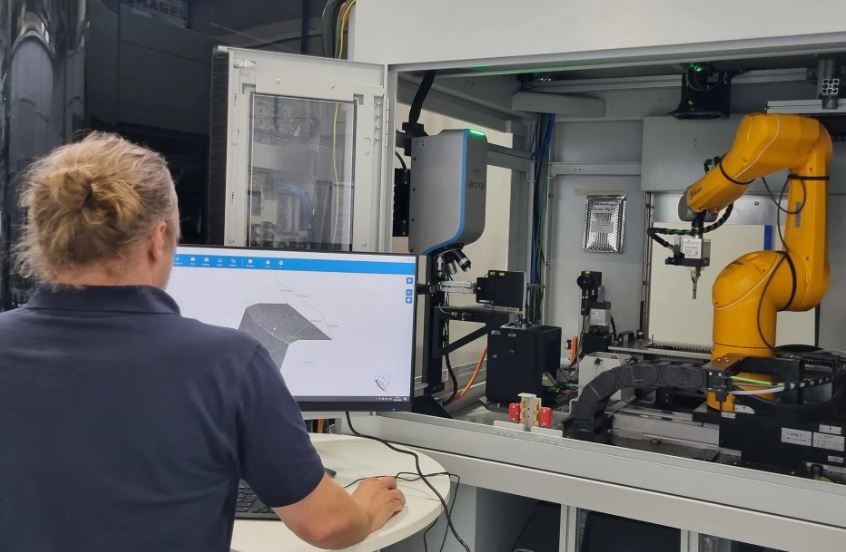

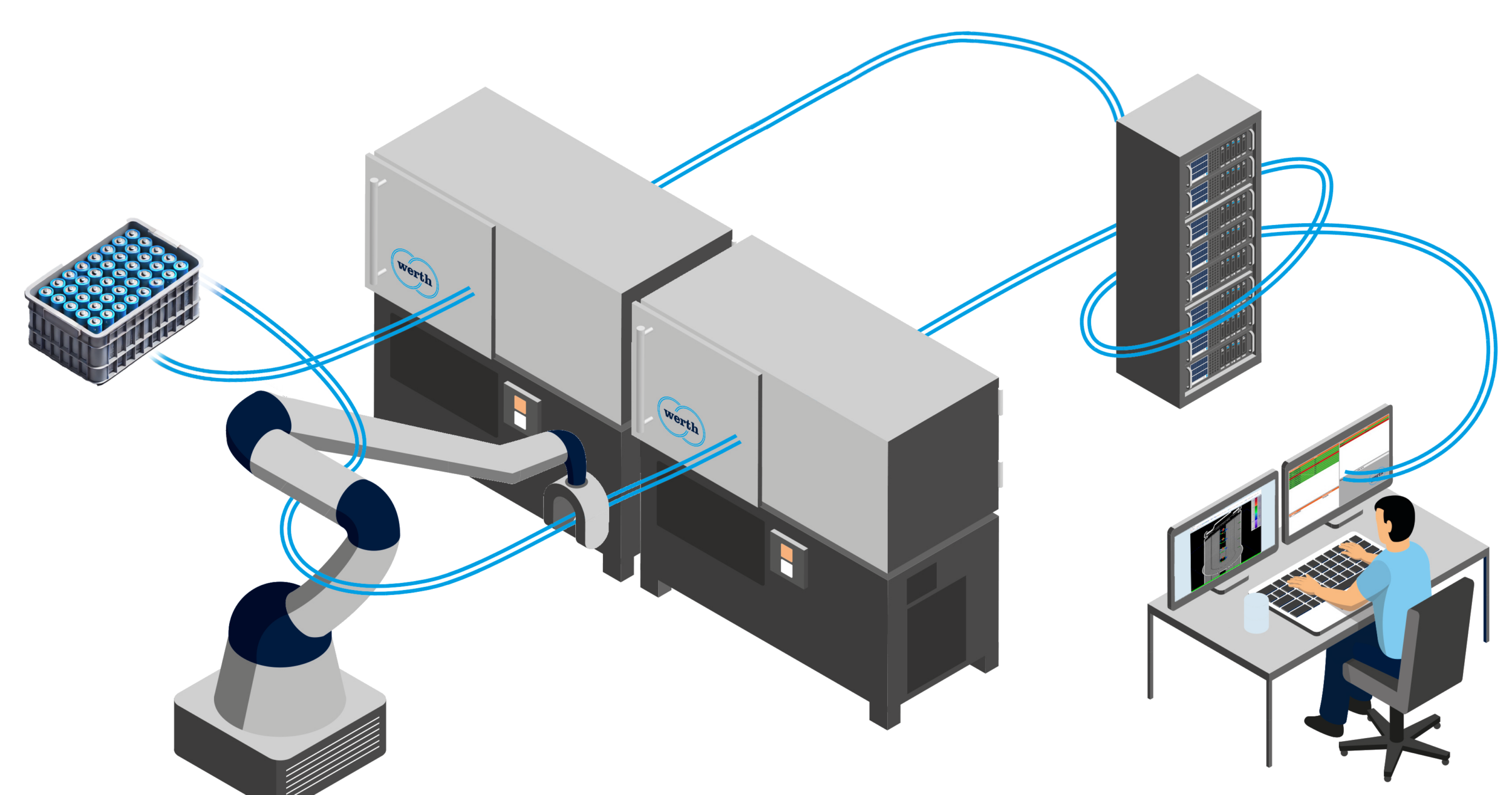

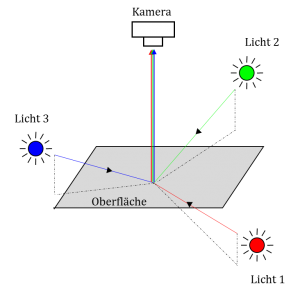

Um bewegte Objekte, z.B. solche die mittels Förderband bewegt werden, in Echtzeit zu prüfen, stellt diese sequentielle Beleuchtungsmethode eine Einschränkung dar. Abhängig von Objektgeschwindigkeit und Beleuchtungstakt resultiert Bewegungsunschärfe, die den Einsatz des Verfahrens stark limitiert. Möchte man das Objekt mit einer einzigen Bildaufnahme prüfen, so kann man dies mittels spektraler Trennung der Beleuchtung erreichen. Das Prinzip des Ansatzes bleibt dabei gleich: das bewegte Objekt wird aus drei unterschiedlichen Richtungen beleuchtet. Statt farblich gleiche LED-Module und eine Grauwertkamera zu verwenden, werden rote, grüne und blaue LED-Module und eine Farbkamera eingesetzt. Die in der Farbkamera integrierten Farbfilter sorgen dabei für die spektrale Trennung der Bilder. Jedes der dabei resultierenden R-, G- und B-Komponentenbilder trägt eine unterschiedliche Richtungsinformation, die anschließend für die Rekonstruktion der Oberflächennormalen verwendet wird. Dieses Verfahren wird ebenfalls auf Basis der beschriebenen Komponenten im 3D.LAB eingesetzt. Wesentliche Einschränkung des Verfahrens ist die unter Umständen unterschiedliche Wechselwirkung der drei Wellenlängen mit der Objektoberfläche und die reduzierte Bildauflösung.

Literatur

[1] C.-H. Lee, A. Rosenfeld. An approximation technique for photometric stereo. Pattern Recognition Letters, 2:339-343, 1984

[2] Zhang R, Tsai PS, Cryer JE, Shah M: Analysis of shape from shading techniques. IEEE CVPR June, 1994; 377-384