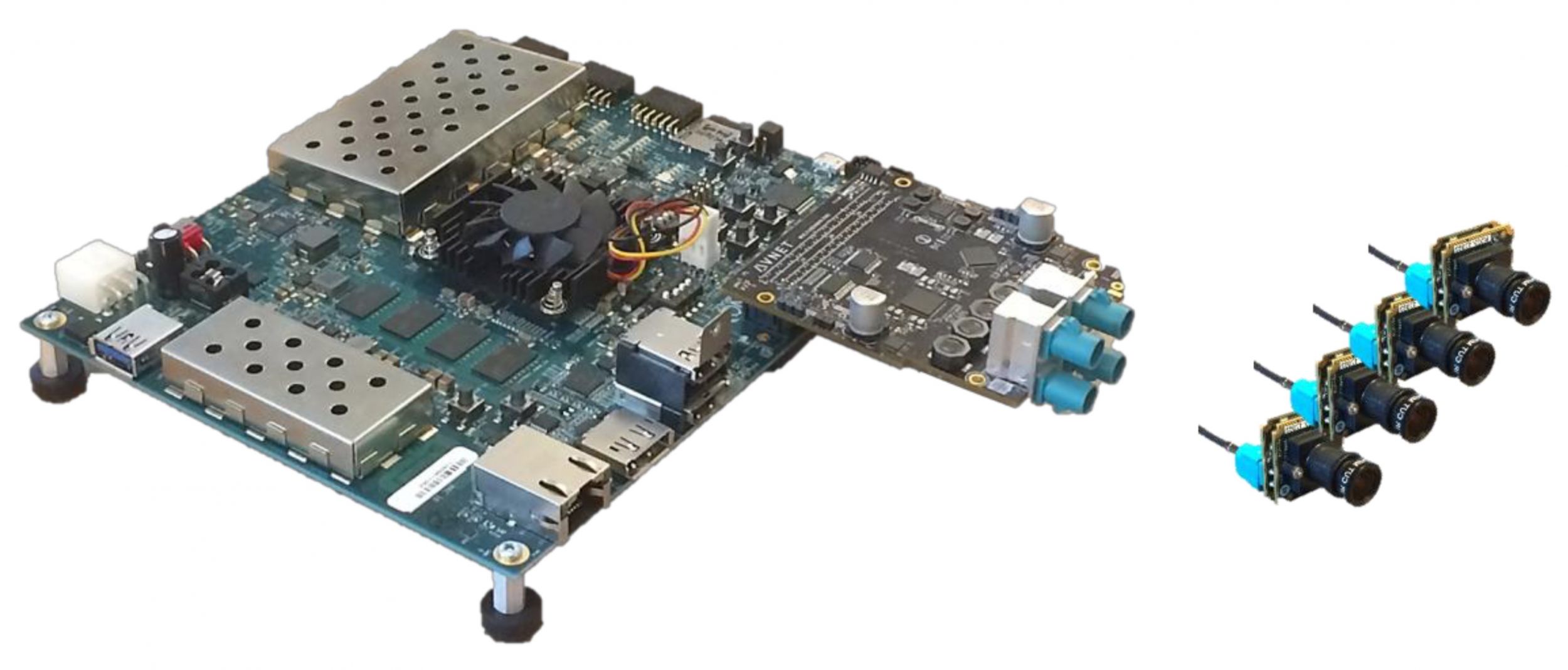

Bild 2 | Entwicklungslösung mit ZCU102-Trägerkarte und dem FMC-Modul mit vier 2MP-Kamera-Modulen. (Bild: Avnet EMEA)

Eine Entwicklungslösung

Die Entwicklung eines Bildverarbeitungssystems für autonome Fahrzeuge erfordert viel Experimentieren mit realen Daten und eine Systemoptimierung zwischen Hardware, Software, Computer Vision und Machine Learning Aspekten des Designs. Entwickler benötigen daher Tools, die sie dabei unterstützen, Kompromisse zu finden, um die Entwicklungsdauer und das Entwicklungsrisiko zu minimieren. Die neue Entwicklungslösung beinhaltet ein Embedded Vision System mit mehreren Kameras und umfasst eine Entwurfsmethodik, die Hardwareplattform, Softwareumgebung, Treiber, sowie den Zugriff auf Beispiel-Algorithmen und Implementierungen für Computer Vision, Machine Learning und Implementierungen. Die Hardware unterstützt bis zu sechs Kameras, das aktuelle Design hat vier 2MP-Kameras und wird zukünftig um zwei weitere 8MP-Kameras erweitert. Es basiert auf einem Xilinx Zynq UltraScale+ MPSoC, der einen Quad-Core ARM Cortex-A53 64-Bit-Prozessor sowie eine FPGA Logikstruktur enthält. Die Kameras werden über Koaxialkabel mit bis zu 15m mit einem Deserialisierer für mehrere Kameras auf einer FPGA-Mezzanine-Karte (FMC) verbunden. Das Modul wird auf eine Platine aufgesteckt, auf der sich der MPSoC befindet. Die SoCs sind mit verschiedenen CPUs und optional mit einer GPU und zusätzlichen Hardware-Videocodecs erhältlich. Sie bieten außerdem eine programmierbare FPGA Logikstruktur, die sich als Hardwarebeschleuniger für rechenintensive Algorithmen oder für weitere Funktionen verwenden lässt, z.B. über die Verwendung von IP-Blöcken von Xilinx oder Drittanbietern.