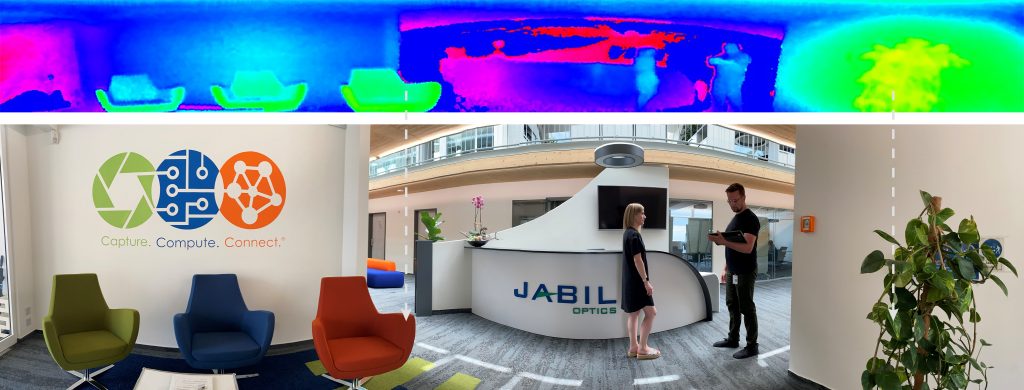

Der kostengünstige und omnidirektionale 360° Time-of-Flight (ToF) Sensor von Jabil Optics bietet mit seinem weiten Sichtfeld einen Vorteil gegenüber bereits auf dem Markt existierenden Lösungen.

Auf dem Markt befindliche ToF-Systeme müssen bisher immer einen Kompromiss aus Reichweite, großem, aber planarem Sichtfeld oder Rundumblick mit einer sehr eingeschränkter, vertikaler Auflösung eingehen. Jabil Optics hat dieses Problem erkannt und einen neuen kostengünstigen Sensor entwickelt, der zugleich ein großes horizontales als auch vertikales Sichtfeld besitzt. Aus der Kombination neu entwickelter optischer Komponenten und einem innovativen aktiven Beleuchtungsansatz ist so ein völlig neuer 3D ToF Sensor entstanden. Im Gegensatz zu herkömmlichen ToF-Kameras ermöglicht das Sichtfeld des omnidirektionalen Sensors eine nahtlose Erkennung, Klassifizierung und Verfolgung von Objekten im Fahrweg eines Roboters. Die 360° ToF-Optik eliminiert nahezu sämtliches Streulicht. Die Nutzung von Szeneninformationen zur dynamischen Beleuchtung vermindern zudem Sensorrauschen sowie Interferenzen und verbessern gleichzeitig sowohl Datenqualität als auch Energiemanagement. Besonders herausfordernd bei der Entwicklung, waren die komplexen Kalibrierungsalgorithmen, um eine konstant hohe Genauigkeit im gesamten Sichtfeld des Sensors zu erreichen.

ToF-Grenzen der Bildgebung erweitern

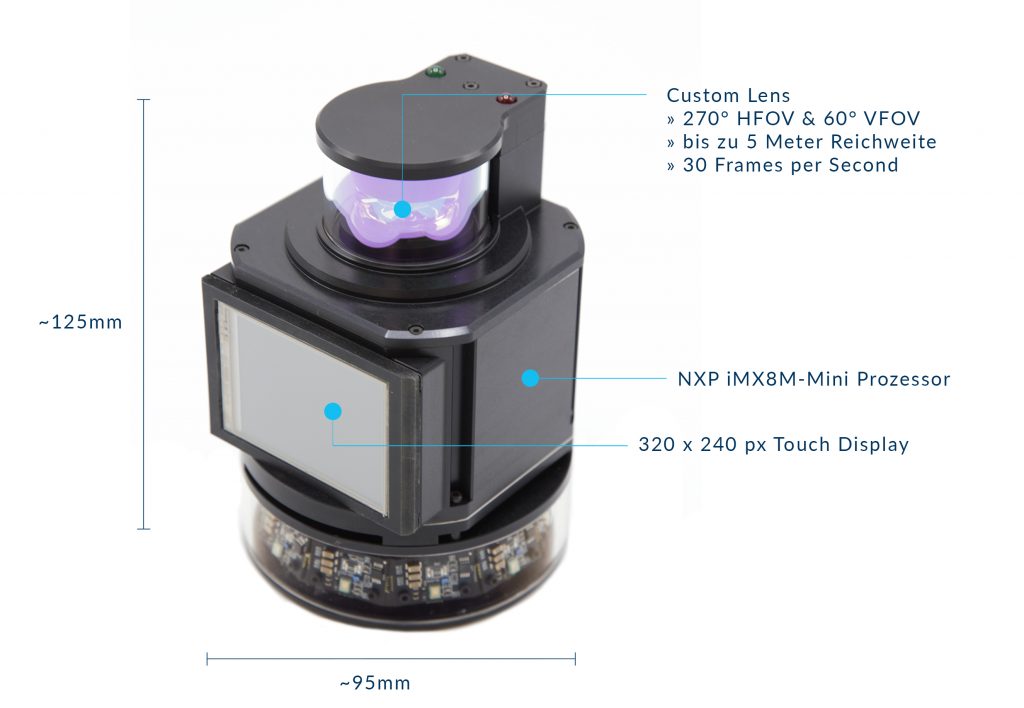

Der Sensor liefert in der aktuellen Ausbaustufe in einem horizontalen Sichtfeld von 270° Intensitäts- und 3D-Informationen. Eine Erweiterung des Sichtfelds auf 360° ist möglich und wurde in einem Prototyp bereits getestet. Anstatt wie bisher üblich drei bis vier ToF-Sensoren zu verbauen und deren Bilder zusammenzusetzen, reicht nun ein einzelner Sensor für einen Rundumblick. Die 360° Optik wurde für die Sensorauflösung von 640×480 Pixel entsprechend optimiert. In der vertikalen Richtung sind 60° darstellbar, so dass auch Überhänge, Durchfahrten und die Navigation unter Regalen möglich sind. Dank der hohen Reichweite von mehr als 5m und 30fps werden relevante Hindernisse frühzeitig in die Betrachtungen des Roboters mit einbezogen, was auch bei hohen Geschwindigkeiten eine sichere Navigation ermöglicht.

Als weiteres Alleinstellungsmerkmal wird eine API angeboten, mit dem Anwender ihre eigene Software, Programme und Algorithmen direkt im Sensor ausführen und damit die Daten-Vorverarbeitung erheblich beschleunigen können. Ein entsprechend performanter i.MX8M Quad ARM Cortex-A53 inklusive GPU ist dafür vorhanden. Für die externe Kommunikation stehen 1G Ethernet, USB, WiFi und Bluetooth zur Verfügung. Zur einfachen Sensorintegration wird eine entsprechende ROS-Schnittstelle angeboten, so dass u.a. Rohbilddaten, vorverarbeitete 3D-Tiefeninformationen, Point-Cloud-, oder SLAM-Daten einfach übertragen und ausgewertet werden können. Zum Ausrichten und Testen des Sensors reicht ein Smartphone, Tablet oder Laptop mit WiFi-Schnittstelle aus, um die 3D-Bilddaten binnen Sekunden ohne weitere Software darzustellen.

Die omnidirektionale Sensor-Architektur wurde unter Berücksichtigung der zugrunde liegenden Technologien modular aufgebaut, so dass eine einfache Adaptierung von Innovationen der bildgebenden Sensoren (iToF, dTOF und SPAD) und der Beleuchtung (LED, VCSEL und kantenemittierender Laser) möglich ist. Darüber hinaus ist die Verwendung der Plattform für NIR und SWIR möglich. Der omnidirektionale Sensor in seiner aktuellen Ausbaustufe stellt somit lediglich eine von vielen Möglichkeiten bei der Implementierung dieser neuartigen Technologien dar.

Stetige Optimierung durch Kunden-Feedback

Um den Robotik-Anforderungen gerecht zu werden, entwickelt Jabil Optics den Sensor stetig weiter. „Unser Entwicklungsziel ist es, den Kunden eine optimale Sensorleistung in einer möglichst kleinen, kostengünstigen und stromsparenden Lösung zu bieten“, erklärt Ian Blasch, Senior Director of Business Development bei Jabil Optics. „Anforderungen an Datenformate, On-Sensor-Verarbeitung und Konnektivität ändern sich ständig in der Robotikbranche. Unser Beta-Testprogramm für den omnidirektionalen Sensor wird es uns ermöglichen, gezieltes Feedback von Kunden und Partnern im Robotik-Ökosystem zu sammeln.“ Das Entwicklungskit als modulares System kann jederzeit an kundenspezifische Anforderungen (u.a. mechanische Abmessungen, Sichtfeld, Reichweite, Wellenlänge, Energieverbrauch) angepasst und optimiert werden. Das Beta-Entwicklungskit kann über den QR-Code angefordert werden.