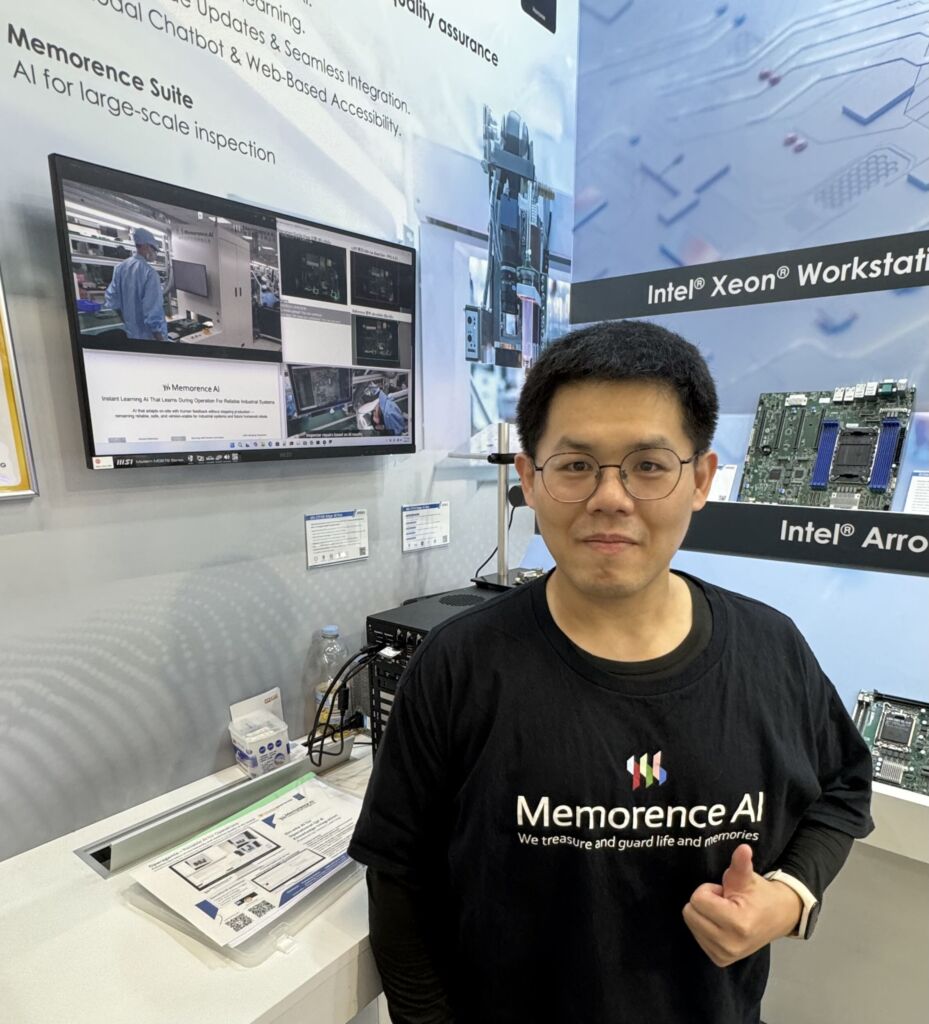

Sieger des Embedded Awards 2026 in der Rubrik Embedded Vision ist Memorence AI für die On-Site-KI zur operativen Qualitätssicherung und Wissensintegration durch Instant Learning.

IDS Imaging Development Systems und Prophesee haben zudem vor Ort eine erweiterte Zusammenarbeit angekündigt. Beide Unternehmen wollen Industriekameras entwickeln, die Prophesees Event-based Metavision Technologie integrieren.

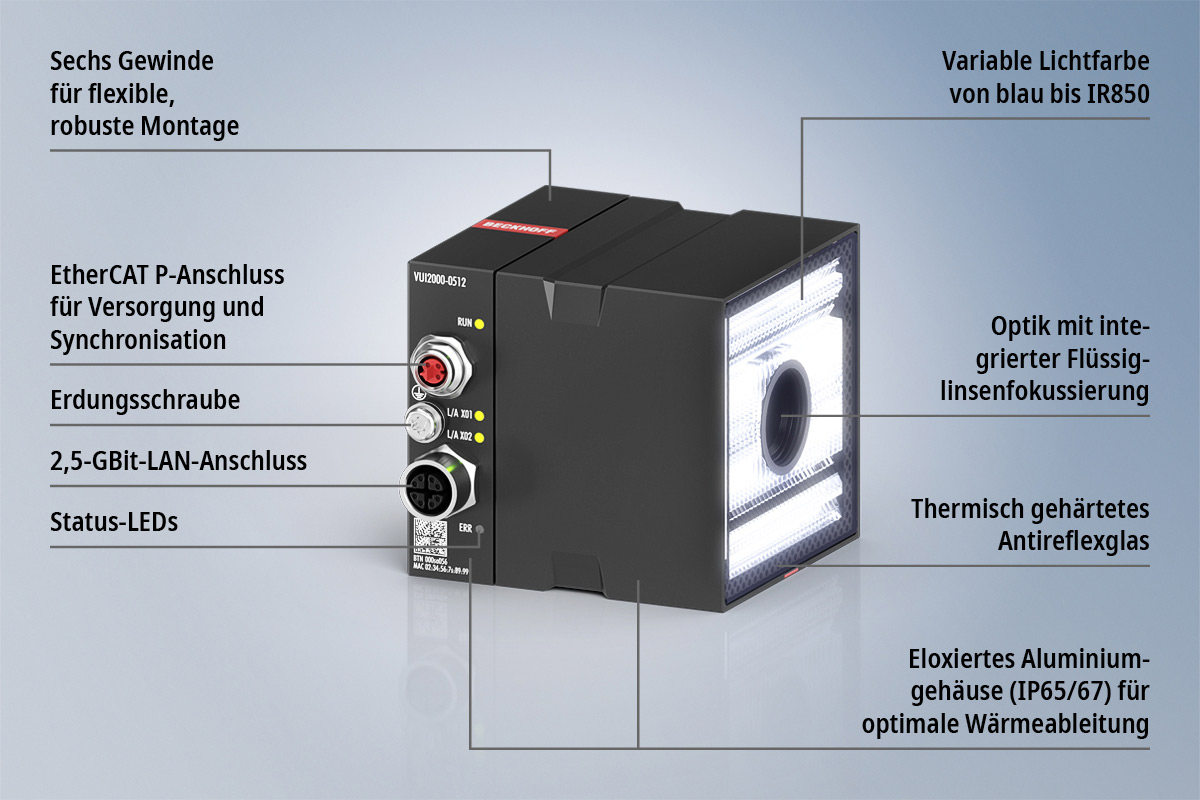

(Smarte) Kameras & 3D-Systeme

STMicroelectronics kündigte neue CMOS-Sensoren mit einem Dual Global- und (!) Rolling-Shutter-Modus an. Durch die Kombination von simultaner Pixelbelichtung (Global Shutter) und sequenzieller Belichtung (Rolling Shutter) optimieren die Sensoren die Bildaufnahme unter verschiedensten Licht- und Bewegungsbedingungen. Der Global-Shutter-Modus eliminiert Bewegungsartefakte für verzerrungsfreie Bilder, während der Rolling Shutter den Dynamikumfang und die Lichtempfindlichkeit verbessert. Der Dual-Modus ermöglicht eine flexible Anpassung an spezifische Anwendungen. Die Sensoren sind in Monochrom- und RGB-IR-Varianten erhältlich. Die Monochrom-Modelle (VD5943, VB5943) liefern Rohgraustufenbilder, während die RGB-IR-Modelle (VD1943, VB1943) über eine integrierte RGB-IR-Trennung und intelligentes Upscaling verfügen. Dieses optimiert den IR-Kanal und liefert neben dem 5MP-RGB-Bilder auch 5MP-IR-Bilder.

Onsemi kündigte neue Global-Shutter-Sensoren mit 2,74µm Pixel, BSI und Auflösungen von 100 bis 300MP an, die bis zum Ende des Jahres erscheinen sollen.

Restar Framos präsentierte ein neues FSM:Go-Kameramodul, das auf dem 8K IMX06A Global Shutter BSI CMOS-Sensor von Sony basiert. Dieser hat 50,3MP und ermöglicht Bildraten bis zu 30fps.

Valens und imavix haben eine MIPI-A-PHY-basierte Kamera-Plattform zur Implementierung des A-PHY-Standards für Machine Vision vorgestellt. Die Plattform nutzt A-PHY-Chipsätze von Valens und IP von Imavix, unterstützt durch Halcon, und ist auf einem FPGA von Efinix implementiert. Die Lösung mit einem 22x22x22mm-Kameramodul, verarbeitet A-PHY-Daten und gibt 10GBit/s GigE Vision (v3.0 basierend auf RDMA) aus.

Die GMSL2-Kameras von The Imaging Source bieten Datenraten von bis zu 6Gbps, Auflösungen von 2,3 bis 20MP, Koaxialkabel mit bis zu 15m, ein IP67-Gehäuse sowie Fakra-Stecker und wurde entwickelt für zuverlässige Bildverarbeitung in anspruchsvollen Umgebungen.

Die TEVS MIPI CSI-2-Kameras von TechNexion unterstützen die RZ/V2N EVK von Renesas und verfügen über einen Dual-Kamera-Eingang für Stereosicht oder Mehrwinkelaufnahmen. Die Kamerasensoren bieten Auflösungen von 1 bis 20MP, verschiedene M12-Objektivoptionen und Treiber.

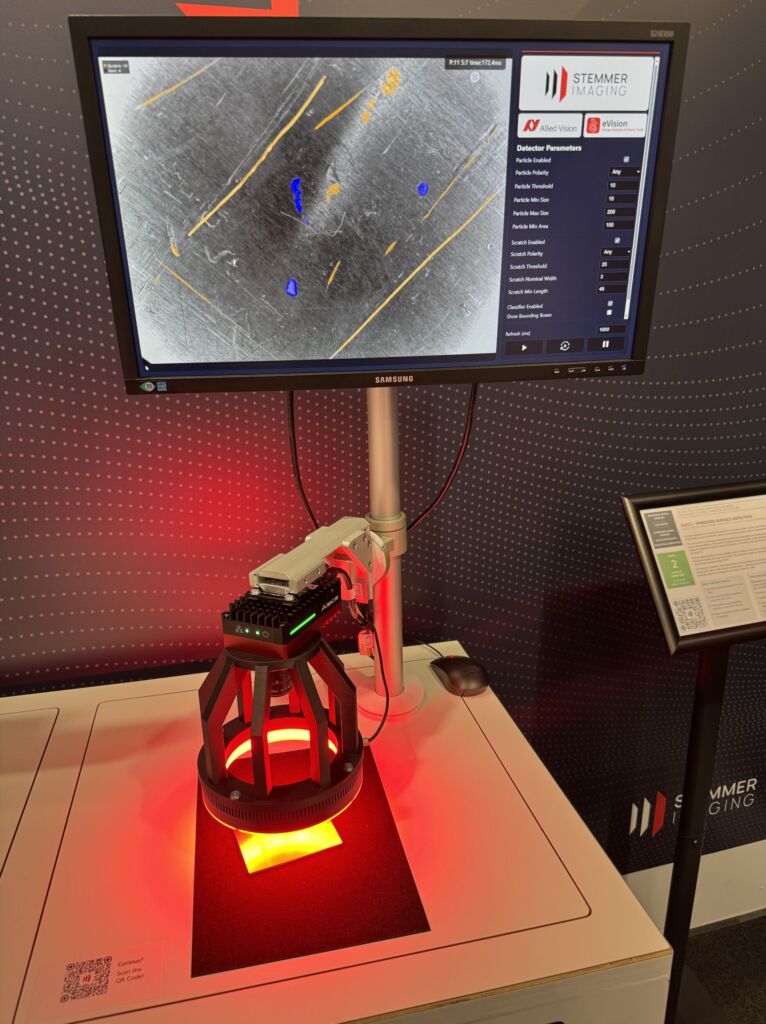

Die Open Smart Camera Alecs von Allied Vision ist jetzt auch mit dem Jetson Orin Nano 8 verfügbar und ermöglicht so leistungsstärkere KI-Anwendungen. Die GPU liefert hohe TOPS-Werte und die offene Kamera-Plattform ist mit den eVision-Bibliotheken von Euresys für benutzerdefinierte Anwendungen kompatibel.

Leopard Imaging stellte Kameramodule vor, die speziell für den Raspberry Pi5 entwickelt wurden. Dieser verfügt über eine Quad-Core Arm Cortex-A76-CPU und verbesserte Dual-4-Lane-MIPI-CSI-Schnittstellen. Die Kamerasuite von Leopard ermöglicht so hochauflösende Bildgebung mit geringer Latenz.

Teledyne e2v präsentierte die Perciva 5D-Kamera, die 2D- und 3D-Daten mit nur einem CMOS-Sensor erzeugt. Die Kamera liefert zeitlich synchronisierte 2D-Bilder und pixelgenaue 3D-Tiefenkarten. Möglich wird dies durch die Angular Sensitive Pixel-Technologie und On-Board-Processing, die eine Echtzeit-Bildfusion von 2D und 3D im kalibrierten Arbeitsbereich ermöglicht.

Das Multikamera-Vision-AI Slam oToSlam von oToBrite Electronics funktioniert drinnen und draußen. Ein Mapping mit gemischten semantischen und 3D-Funktionen ermöglicht eine Positionierungsgenauigkeit von bis zu 1cm. Der Slam nutzt KI-Vision, vier Kamera-basierte Sensorsysteme sowie eine Edge-AI-ECU, um eine Echtzeit-Lokalisierung und -Kartierung zu ermöglichen. Durch diese ist eine Lokalisierung und Kartierung von AGV/AMRs bis zu 15m möglich.

Die Lips Edge S315 Kamera kombiniert Hybrid Depth Technology mit Edge-KI-Architektur und ermöglicht eine hohe Genauigkeit auch in anspruchsvollen Umgebungen mit reflektierenden, transparenten oder dunklen Materialien. Durch die direkte Datenverarbeitung auf der 4,5-TOPS-NPU der Kamera werden Latenzzeiten deutlich reduziert. Eine weitere Neuheit war die Version 7 des 3D-Körperposen SDK. Dieses erfasst 32 Körper- und 40 Handbewegungen präzise für Ganzkörper- und Gestenerkennung und verfolgt gleichzeitig bis zu 43 Personen mit stabiler ID-Erkennung.

Embedded Vision

SoM, Kamera-Anschluss, Bildsensor, Prozessor, Speicher und Software-Treiber: die SBC EvoCam von Vision Components integriert alle Komponenten für Bilderfassung/-verarbeitung auf einer 65x40mm-Platine. Ein MediaTek Genio-510-Prozessor sorgt für die Rechenleistung. Ausgestattet ist die Kamera mit dem 3,2MP IMX900 von Sony. Weitere Neuheiten waren das MIPI-IMX454-Kameramodul für multispektrales Imaging und die Neun-Kamera-Array Multiview Cam.

Die Technologie-Partnerschaft von MVTec und Qualcomm, wird es Halcon-Anwendern demnächst erlauben die NPU der Dragonwing-Prozessoren zu nutzen. Damit können dann z.B. Deep-Learning-Anwendungen auf Embedded-Geräten mit höherer Geschwindigkeit und Effizienz betrieben werden. Aktuell entwickelt MVTec eine Schnittstelle zwischen Halcon und dem Dragonwing RB3 Gen 2, die im Herbst fertig sein soll.

Pleora stellte das Konzept einer Multisensor-Edge-Integration-Platform für Embedded-Systeme vor, die auf Pleoras eBus Edge basiert. Die Platform beschleunigt die Entwicklung von Multisensor-Anwendungen, bei denen Sensordaten synchronisiert und gestreamt werden und verbindet diese mit KI-Modellen.

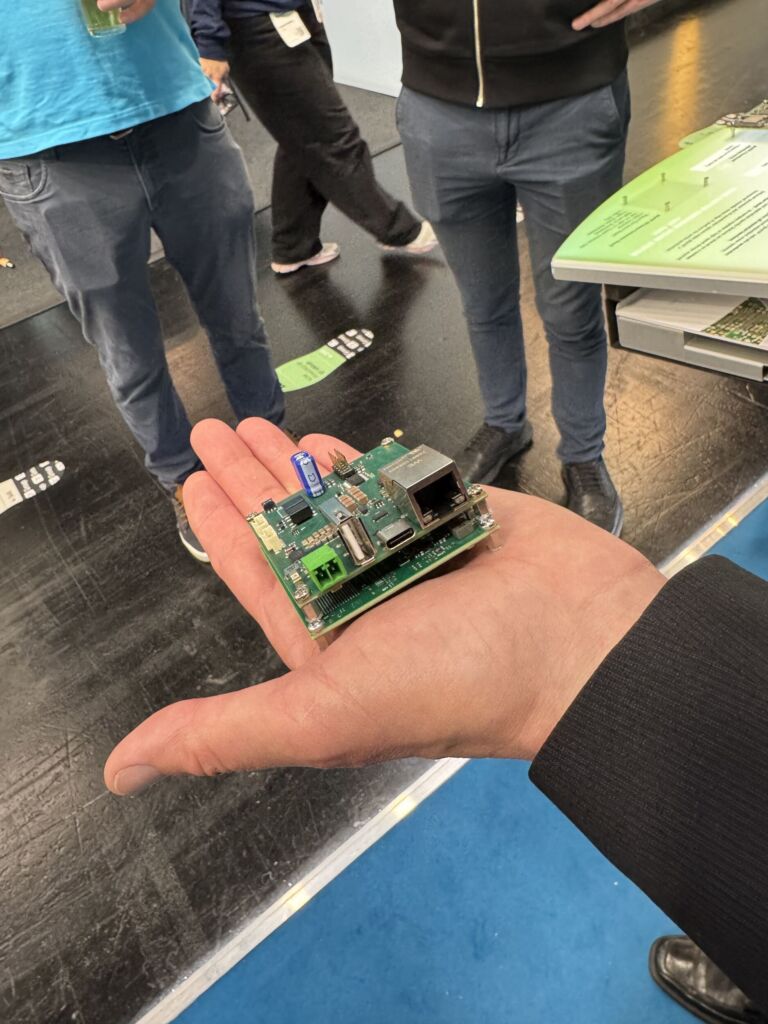

Die Vision Integration Platform phyVIP von Phytec besteht aus zwei Platinen: einem Basisboard und einem Connector-/Expansion-Board. Das fertig entwickelte Basisboard übernimmt alle komplexen und wiederkehrenden Funktionen, inkl. SoM, Kamera-Anschluss, Netzteile, Security und Schnittstellen. Es ist serientauglich in verschiedenen Skalierungsstufen verfügbar und hat die Größe einer Kreditkarte. Die individuelle, projektspezifische Anpassung erfolgt über ein separates Connector-/Expansion-Board.

Die Macnica Partner iEnso und Hellbender präsentierten Demos mit Edge-KI-Funktionen, die auf der N1-Plattform von Ambarella basieren. Die Demos boten Anwendungsfälle von agentenbasierter KI, die an der Edge mit geringem Stromverbrauch und der N1-655 Plattform von Ambarella ausgeführt werden. Weiteres Highlight war die SLVS-EC3.1 IP, welche die Verbindung der neuer Sony-Image-Sensoren an die Avant G/X FPGAs von Lattice ermöglicht. Ebenfalls am Stand vorgestellt wurde der Stabilisator-Chip CXD5254GG von Sony, der einen Bildsensor mit einer 6-Achsen-Inertialmesseinheit zur elektronischen Bildstabilisierung kombiniert. Der Algorithmus zur Lageregelung reduziert durch Kameravibrationen verursachte Unschärfen und ermöglicht sowohl eine Echtzeit-Horizontstabilisierung als auch die Unterdrückung des Jello-Effekts.

Solectrix stellte die erste PXIe-Variante seines Videograbbers Proframe vor. Das Base Board 3.1 PXIe ist ein 3HE-Modul mit PXIExpress-Gen3-x8-Bus für LabView von National Instruments. Es bietet PXIe-basierten Mess- und Automatisierungssystemen austauschbare Proframe-Interface-Adapter und ermöglicht den Anschluss einer Vielzahl von Kameras, Displays und ECUs.

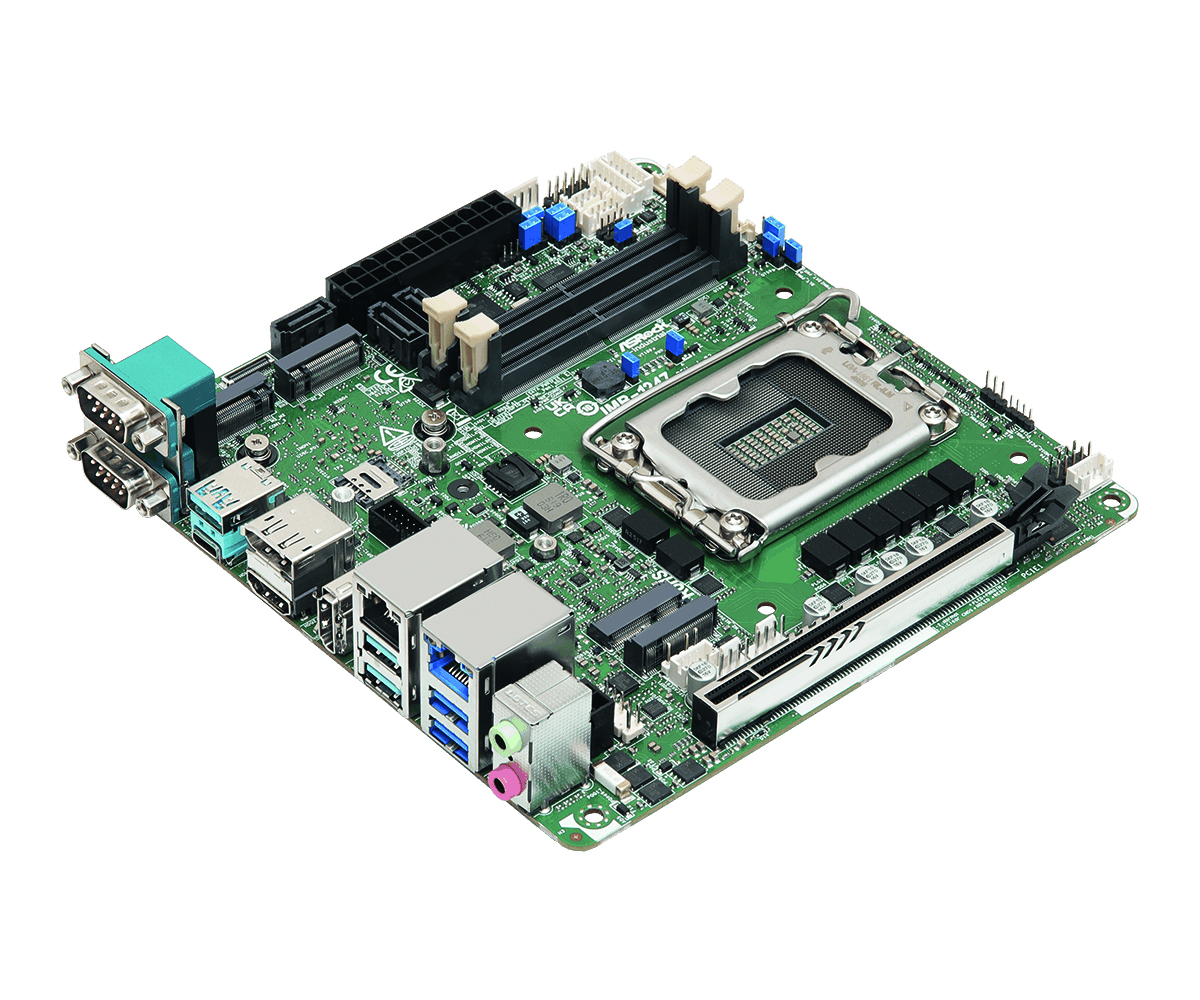

Die für den Embedded Award nominierte CAN-FD-Erweiterungskarte MEC-CAN-2F14i von Cervoz vereinfacht die Steuerung und Synchronisierung in kompakten Embedded-Vision-Systemen, insbesondere in Umgebungen, in denen Störfestigkeit und Zeitgenauigkeit wichtig sind.

E-con Systems präsentierte die Robotics Computing Platform (RCB) auf Basis des KI-Vision-SoC CV72S von Ambarella. Die auf einem ROS2-Stack basierende Plattform integriert Multi-Kamera-Unterstützung, verschiedene Sensoren sowie vor-implementierte Navigations- und Kartierungsfunktionen.

Mit NASE (Neural Architecture Search Engine) stellte das Fraunhofer ITWM ein agentenbasiertes System vor, das KI-Modelle für Edge- und Embedded-Plattformen entwirft. Statt bestehende Modelle an eine Zielplattform anzupassen, entwickelt die neuronale Suche passgenau Architekturen direkt für die jeweilige Hardware, sodass auch die Modellportierung entfällt. Ein Sprachmodell erfragt die Anforderungen und konfiguriert die Suche automatisch. Anwender formulieren lediglich das Ziel, z.B. welche Aufgabe die KI auf der Embedded-Plattform erfüllen soll und welche Leistungskennzahlen erreicht werden müssen.

KI-PCs und Prozessoren

Der KI-Prozessor GPX10 von Ambient Scientific ist für Always-On-KI-Anwendungen in energiebeschränkten Edge-Geräten konzipiert. Er ist ein integrierter SoC mit zehn DigAn-KI-Kernen, einem stromsparenden ADC, kundenspezifischem SRAM und Unterstützung für zahlreiche Peripheriegeräte.Der Prozessor ist vollständig programmierbar und verbraucht <80µW. Bis zu zehn analoge und digitale Sensoren können gleichzeitig angeschlossen werden.

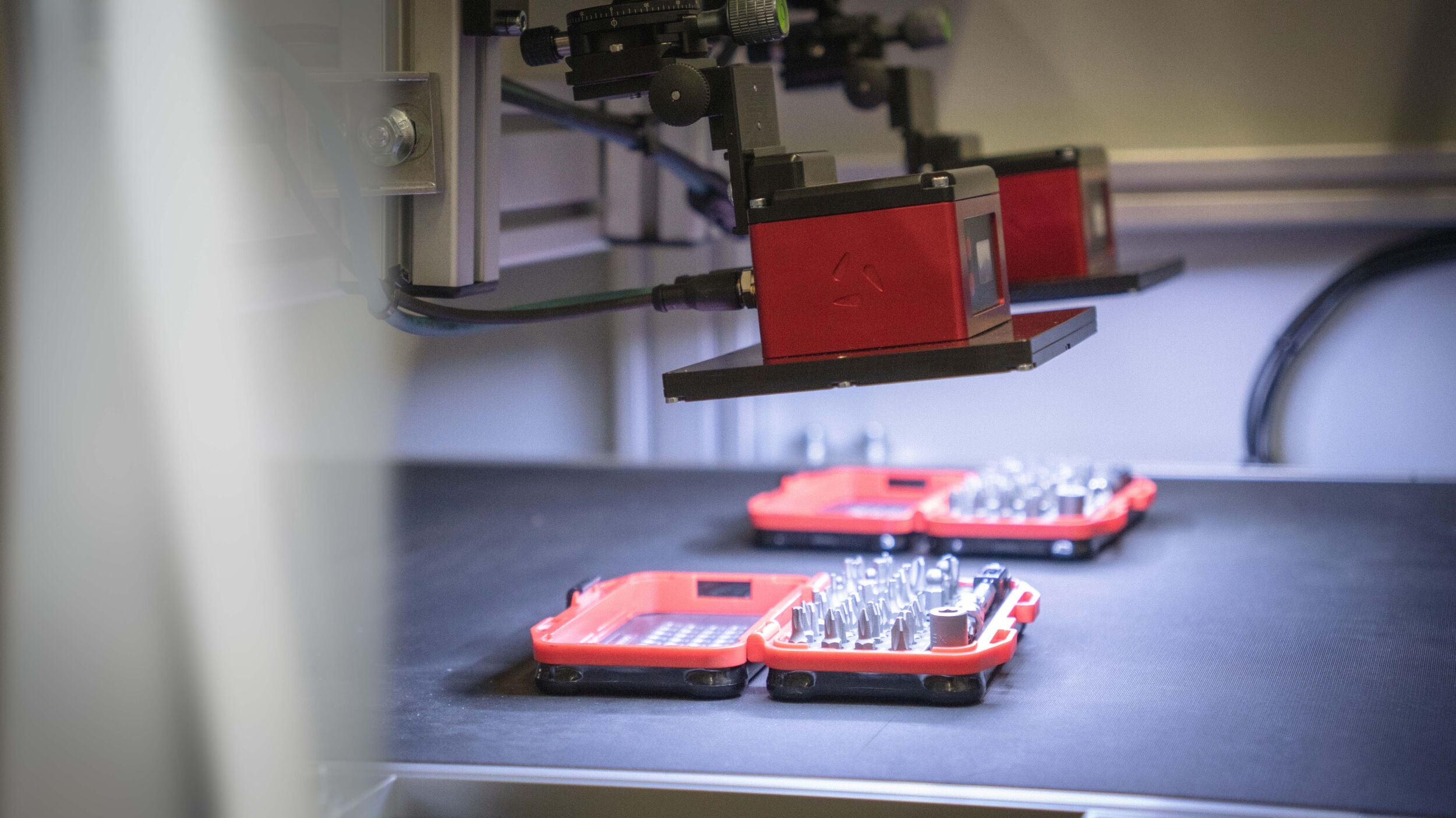

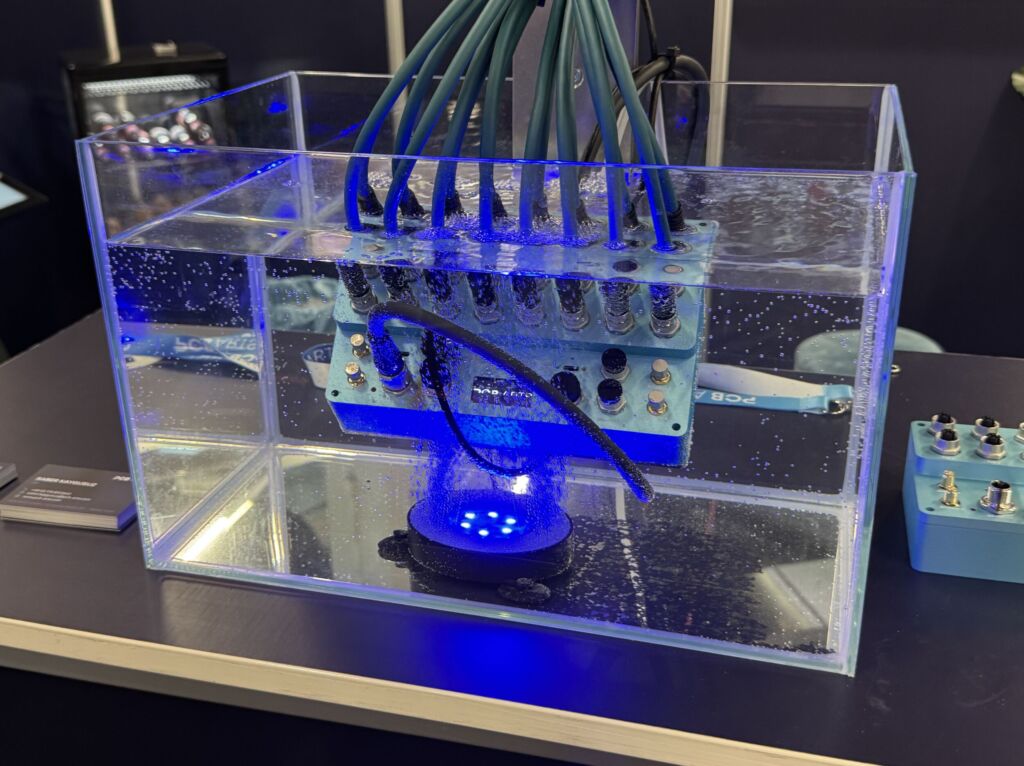

Erstmals wurde die High-End-Plattform Thorium von PCB Arts gezeigt, die auf dem Nvidia Jetson AGX Thor basiert. Sie wurde für Edge-KI-Anwendungen entwickelt, bei denen klassische Embedded-Lösungen nicht ausreichen. Mit 2.070 FP4 TFLOPS mit 64 oder 128GB Ram, 16xGigE (M12 X-coded) oder GMSL2 sowie einem 10GigE Port hat die IP67-Plattform zudem die Treiber der Kamerapartner von PCB Arts.

Vecow präsentierte den ultrakompakten, stapelbaren KI-PC TGS-2000, der die Intel-Core-Ultra-Series-3-Prozessoren (Panther Lake) nutzt. Mit 100 Plattform-TOPS meistert er lokale KI-Inferenz in einem NUC-großen Formfaktor. Der Bausteinansatz ermöglicht die nahtlose Erweiterung durch MXM-GPUs und skaliert das System so vom schlanken Edge-Controller bis zum Highend-System.

SXVPU von Solectrix ist eine KI-getriebene Vision-Plattform, die hochaufgelöste Video-Streams bis zu 4K in Echtzeit verarbeitet. Mit ihrer AMD-basierten Hardware und der Unterstützung für mehrere Kameras kann sie Bilddaten direkt vom Sensor verwenden, um sie dann von neuronalen Netzen oder Algorithmen verarbeiten zu lassen, bevor die Daten mit niedriger Latenz zu weiteren Systemkomponenten übertragen werden.

Advantech startet eine Partnerschaft mit DeepX, die das KI-Chipsatz-Ökosystem von Advantech erweitert und die Edge-KI-Beschleunigungslösung EAI-1961 ermöglicht. Das im m.2-Formfaktor entwickelte Modul liefert bis zu 25 TOPS an KI-Inferenz.

Kontron hat eine strategische Partnerschaft mit SiMa.ai gestartet, bei denen der KI-Chips von SiMa.ai für Anwendungen wie z.B. die KBox A-151 EAI-Plattform genutzt wird. Diese wurde speziell für den SiMa.ai MLSoC Modalix-Beschleuniger entwickelt und liefert über 50 TOPS KI-Leistung.

Das TQMa94xxLA erweitert das Portfolio von TQ um ein LGA-Modul für Edge- und KI-Anwendungen. Der Quad Core Arm Cortex-A55 von NXP, kombiniert mit integrierter NPU, liefert bis zu 0,5 TOPS.

Seco präsentierte das SOM-COMe-CT6-Dragonwing-IQ-X, ein COM-Express-Typ-6-Modul basierend auf der Qualcomm Dragonwing IQ-X-Serie. Ausgestattet mit 12- oder 8-Kern-Qualcomm-Oryon-CPUs mit bis zu 3,4GHz Single-Thread-Leistung ermöoglicht es 45 TOPS On-Device-KI-Beschleunigung bei geringem Stromverbrauch.

Sundance Multiprocessor Technology stellte das SMT135-C vor, ein Evaluierungsboard für den Efinix Titanium Ti135 FPGA, das speziell für Edge Computing, Echtzeitsteuerung und Vision-Anwendungen entwickelt wurde. Das Board basiert auf einem SoM6 Ti135 SoM mit dem FPGA und ist in einem N676-Gehäuse untergebracht.

Der lüfterlose Box-PC MVP-3120 von Adlink ist mit Intel-Core-Prozessoren der 200S-Serie sowie der 14., 13. und 12. Generation ausgestattet. Er harmoniert mit dem PCIe-CPL64V Full Camera Link Framegrabber, der Bilddaten bis 850MB/s ermöglicht. Die MXM Embedded-Grafik und KI-Beschleunigungsmodule basieren auf der Nvidia-Blackwell-Architektur. Das EGX-MXM-BW2000 liefert bis zu 100W Leistung in einem MXM 3.1 Typ A-Formfaktor (82x70mm). Im High-End-Bereich verfügt der EGX-MXM-BW5000 über die Nvidia Multi-Instance GPU-Technologie.

Die GPU-basierte IPC Produktlinie Gold von Cincoze umfasst drei Serien für KI-Anwendungen. Für leichte Anwendungen bietet die GJ-Serie Nvidia Jetson SoMs mit geringem Stromverbrauch. Die GM-Serie unterstützt MXM-GPU-Module. Für anspruchsvolle KI-Anwendungen unterstützt die GP-Serie bis zu zwei 300W-High-End-GPU-Karte.

Der DE Next-RAP8-EZbox von Aaeon ist für den Einsatz in autonomen Systemen oder als zentrale Steuerung in Industrierobotern konzipiert. Er vereint Intel Core-Prozessoren der 13. Generation, bis zu 16 GB LPDDR5x-Arbeitsspeicher und viele I/Os in einem PC mit 95,5×69,5×42,5mm (45,4mm).