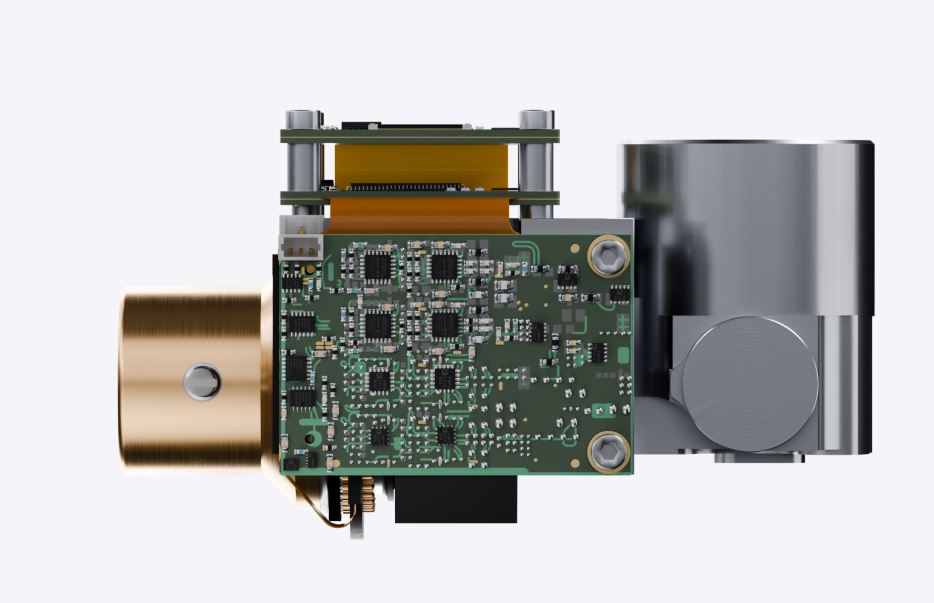

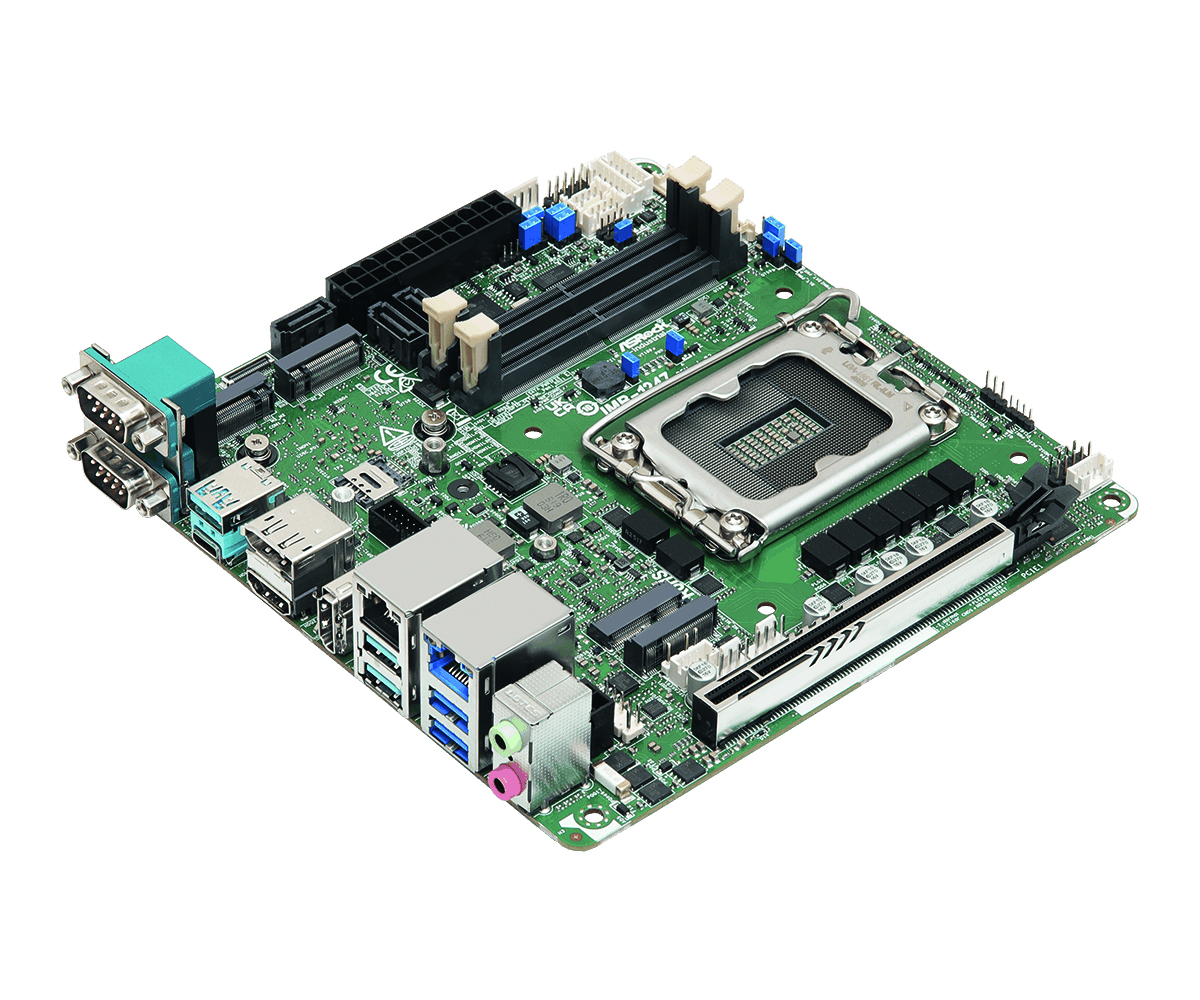

Die Steigerung der Integrationsdichte elektronischer Bauelemente Mitte der 1990er Jahre machte durch Miniaturisierung neuartige Rechnerarchitekturen für die Bildverarbeitung möglich. Den IBV-Rechnern mit Steckkartenprinzip (PC, VME-Bus, …) folgte die Smart Camera und brachte erstmalig Bildverarbeitungsintelligenz dezentral in Maschinen. Sie war ein Zwischenschritt hin zu embedded Vision Systemen, bei denen sich das gesamte Vision System auf einer einzigen Platine befindet. Dort sind die Baugruppen Bildaufnahme, -vorverarbeitung, -verarbeitung, Steuerung externer Komponenten und Kommunikation vereint. Sie arbeiten meist mit spezialisierter Hardware sowie darauf abgestimmten Betriebssystemen. Typischerweise senden embedded Vision Systeme nur Ergebnisse und keine Bilddaten über die Kommunikationsschnittstellen. Geringe Latenzzeiten und Bandbreitenanforderungen sind die Folge, Datendurchsatz und Informationssicherheit sind hoch. Damit können die Funktionalitäten ‚Sehen‘ und ‚Bildverarbeitung‘ leichter in Geräte, Maschinen und Anlagen eingebettet (engl. Embedded) werden, z.B. in Spielekonsolen, Roboterarme, Smartphones, Fahrerassistenzsysteme… So werden u.a. auch Anwendungen im Internet der Dinge (IoT) kostengünstiger möglich. Hinzu kommt, dass sich ergänzende Technologien wie Deep Learning und KI sehr gut auf Embedded Vision Systemen umsetzen lassen. Die Standardisierung wird durch den VDMA unterstützt: Die G3 Embedded Vision Study Group arbeitet aktuell an einem weltweit verbindlichen Standard.