Vibrations- und Schwingungsanalyse mit Event-based Vision

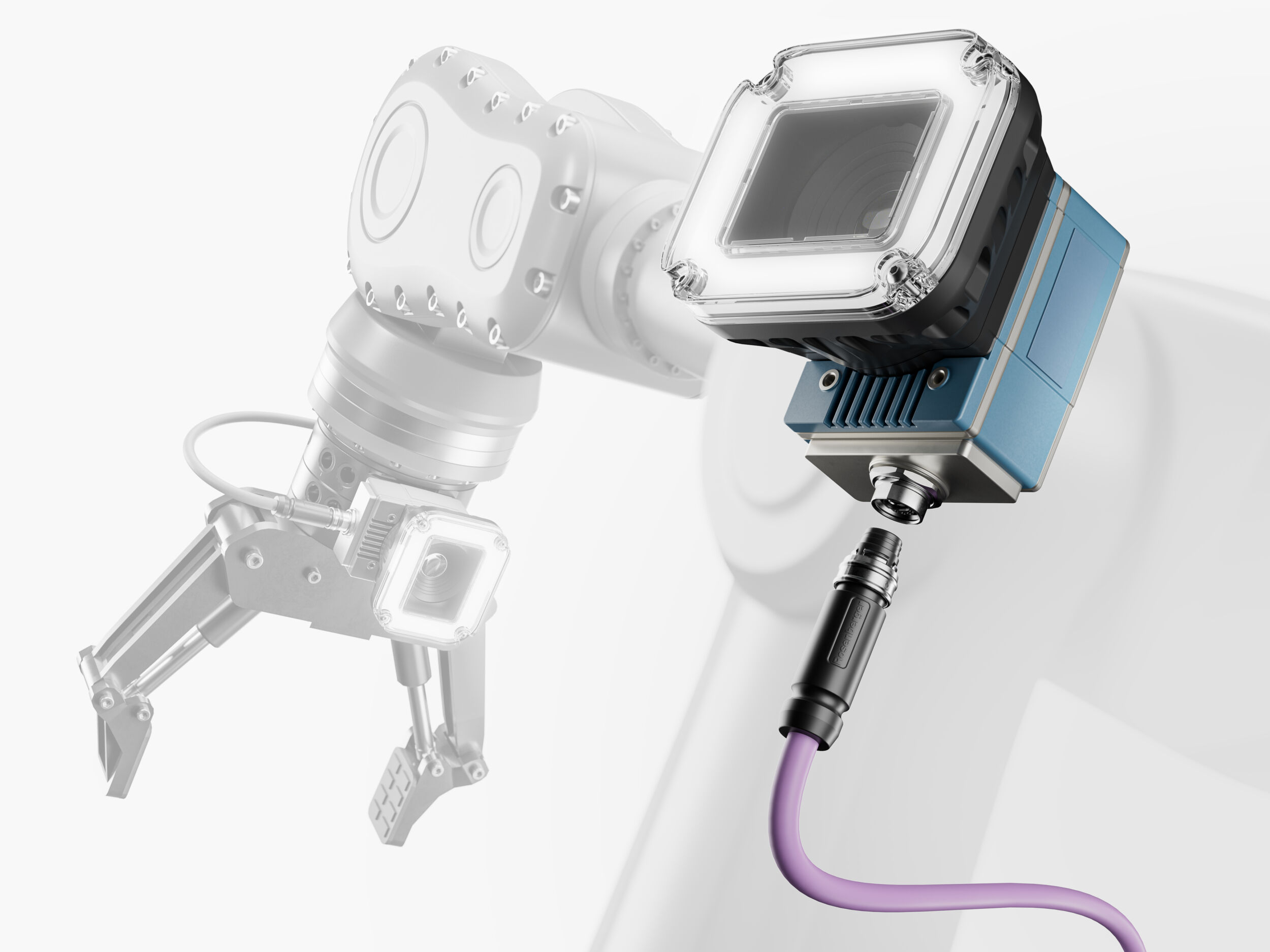

Ob prädiktive Wartung, Erkennung von Fehlverhalten oder Prozessanalyse: Aus Vibrationen und Schwingungen von Maschinenkomponenten lassen sich Informationen ableiten. Ein neuer Lösungsansatz besteht in der Nutzung von Event-based Sensoren, integriert in eine intelligente Multiprozessorkamera.

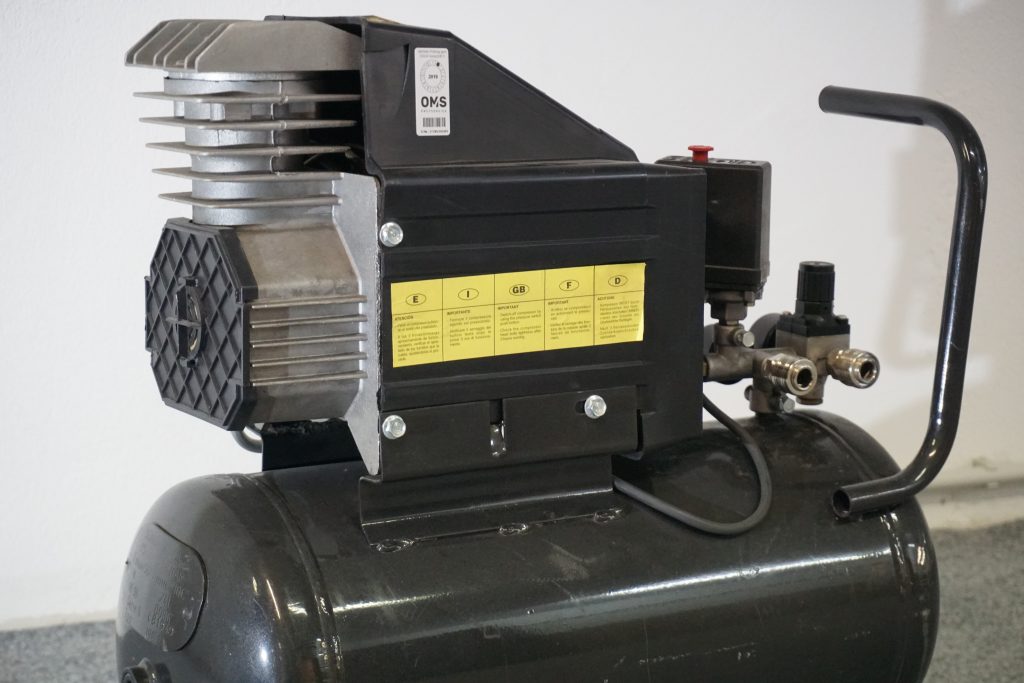

Ob Rohre in einer Prozessanlage, Maschinenbauteile oder ein Elektromotor, stets geht es darum, sehr schnelle Bewegungen zu erfassen. Nimmt man beispielsweise von einem Kompressormotors mehrere Bilder mit 100Hz auf und berechnet die Bilddifferenzen, so wird man daraus nicht die Vibration des Motors bestimmen können. Schnell stellt man fest, dass die Kamera mit einer Bildwiederholrate von mehr als 2.000Hz arbeiten müsste, um dies zu erreichen. Auch wenn die Auflösung klein ist, das heißt bei 2.000Hz und VGA monochrome Auflösung, ergibt sich dabei eine Datenrate von mehr als 600MByte/s. Der Rechner müsste also einiges an Leistung mitbringen. Algorithmisch sucht man dabei zwischen den Bildern Kanten und wertet diese aus. Allerdings erhält man auch bei 2.000Hz lediglich Informationen im zeitlichen Abstand von 0,5ms. Helfen kann hier Event-based Vision.

Was ist Event-based Vision?

Die Event-based Sensoren von Prophesee, demnächst auch in Kooperation mit Sony erhältlich, enthalten intelligente Pixel. Jeder Pixel ´entscheidet´ für sich, ob sich etwas bewegt hat. Ist dies der Fall, so sendet er keine Grauwertinformation, sondern das Event, das heißt war es ein Hell-Dunkel- oder Dunkel-Hell-Wechsel? Ergänzt wird die Information durch die Position des Pixels und ein Zeitstempel in Mikrosekunden. Da jedes Pixel dies autark entscheidet, folgt daraus, dass es keine Bildraten mehr gibt. ´Frames per Second´ gehören somit der Vergangenheit an. Der Sensor liefert stattdessen einen Datenstrom von Events. Man verliert neben den Bilddaten auch eine feste Abtastrate (im beschriebenen Fall von 500µs). Dafür gewinnt man aber Events mit Timestamp und kann auf einer wesentlich höheren Abstraktionsebene die Frequenzen von Vibrationen ausrechnen. Bei der in der VisionCam EB (Event-based) von Imago Technologies integrierten Dual-Core ARM CPU landet der Eventdatenstrom im Speicher des Computers. Auf der CPU läuft ein Linux Betriebssystem, das auch die Nutzung weiterer Schnittstellen erlaubt, z.B. Gigabit-Ethernet, Real-Time gesteuerte I/Os und serielle Schnittstellen.