Ein neues Assistenz-System von ifm kann Arbeitsumgebungen mobiler Arbeitsmaschinen genauer analysieren und zuverlässiger vor Gefahren warnen als herkömmliche Geräte. Die Fusion zweier Messprinzipien in Kombination mit einer speziell auf Arbeitsumgebungen geschulten KI machen es möglich.

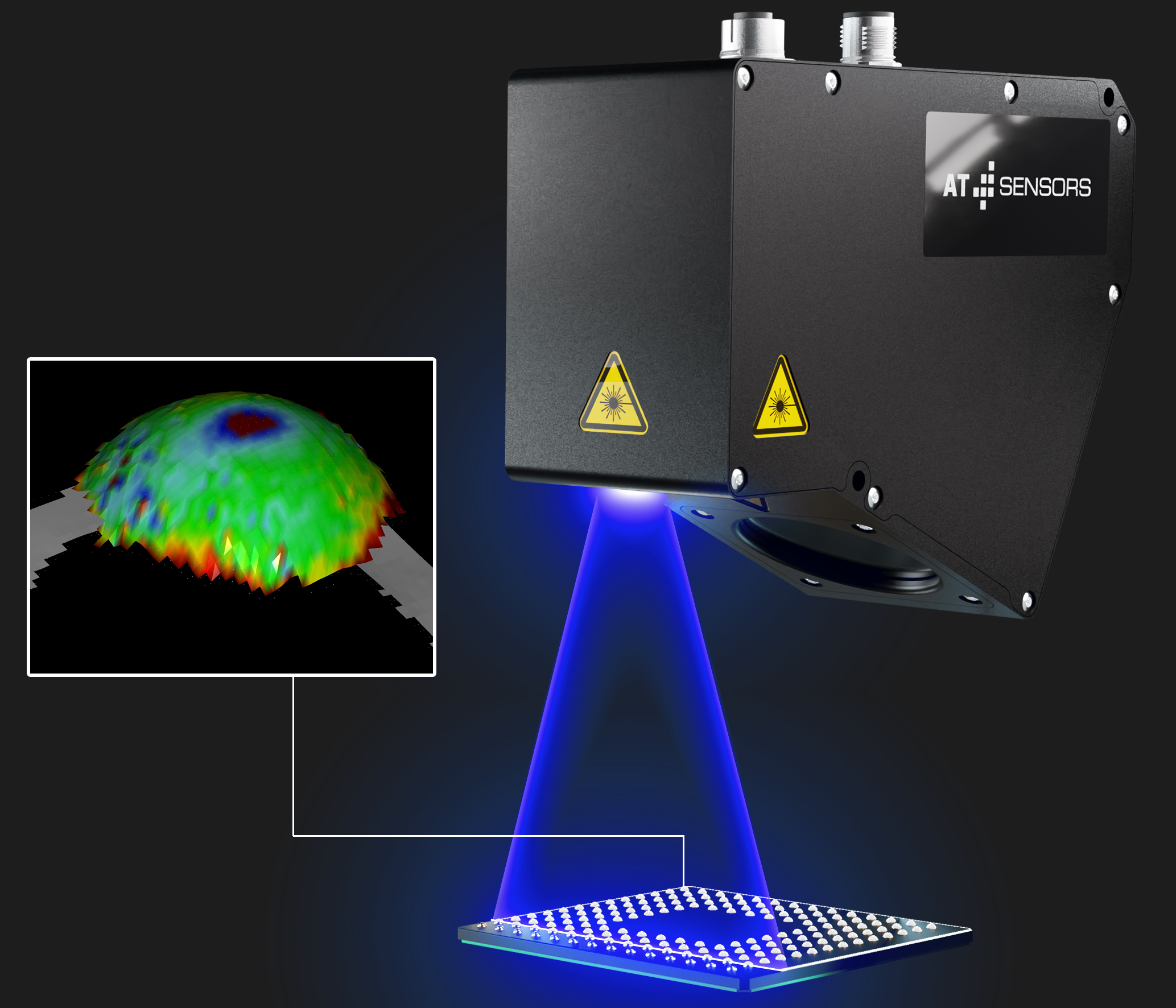

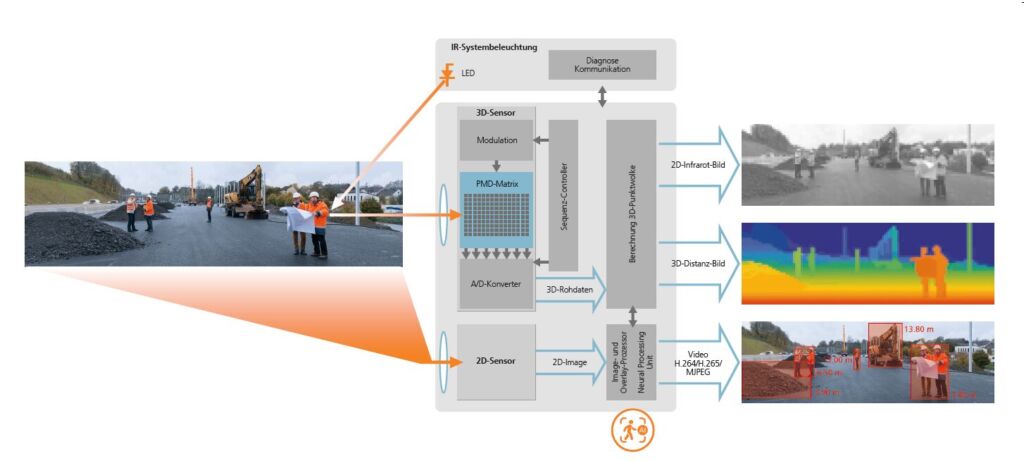

Die O3M AI Lösung ist derzeit das weltweit einzige PMD-Kamerasystem, das zwei Technologien, nämlich Time-of-Flight und 2D-Vision zu einem robusten Kollisionswarnsystem für mobile Arbeitsmaschinen vereint. Durch die Sensorfusion kann das System den exakten Abstand und die Art des Hindernisses klassifizieren und somit bessere Entscheidungen zum Fahrverhalten treffen. Durch die Einbeziehung zweier Informationsquellen ist ein genaueres Bild der Umgebung, inklusive Personen- und Objekterkennung, möglich.

3D-Abstandsmessung und KI-Kamera

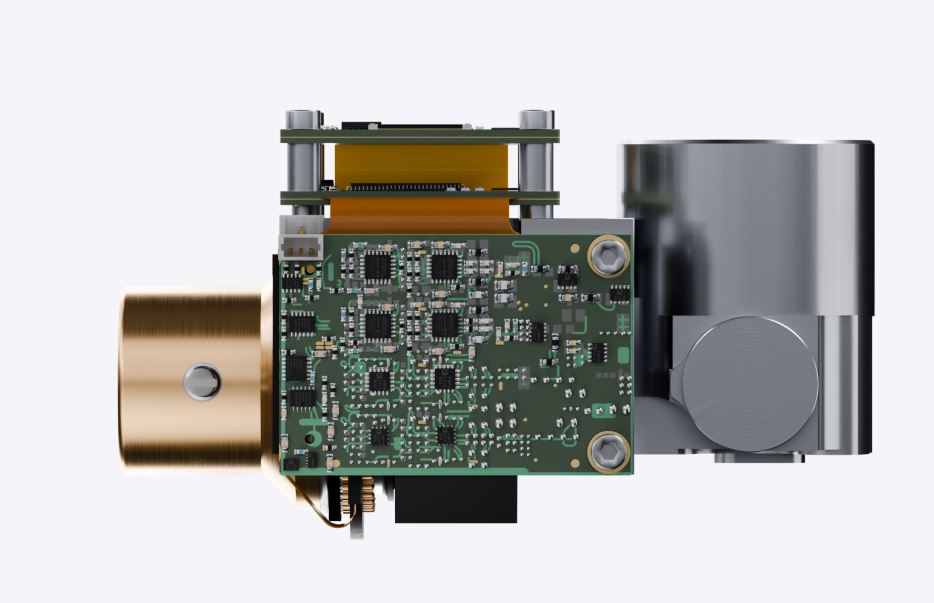

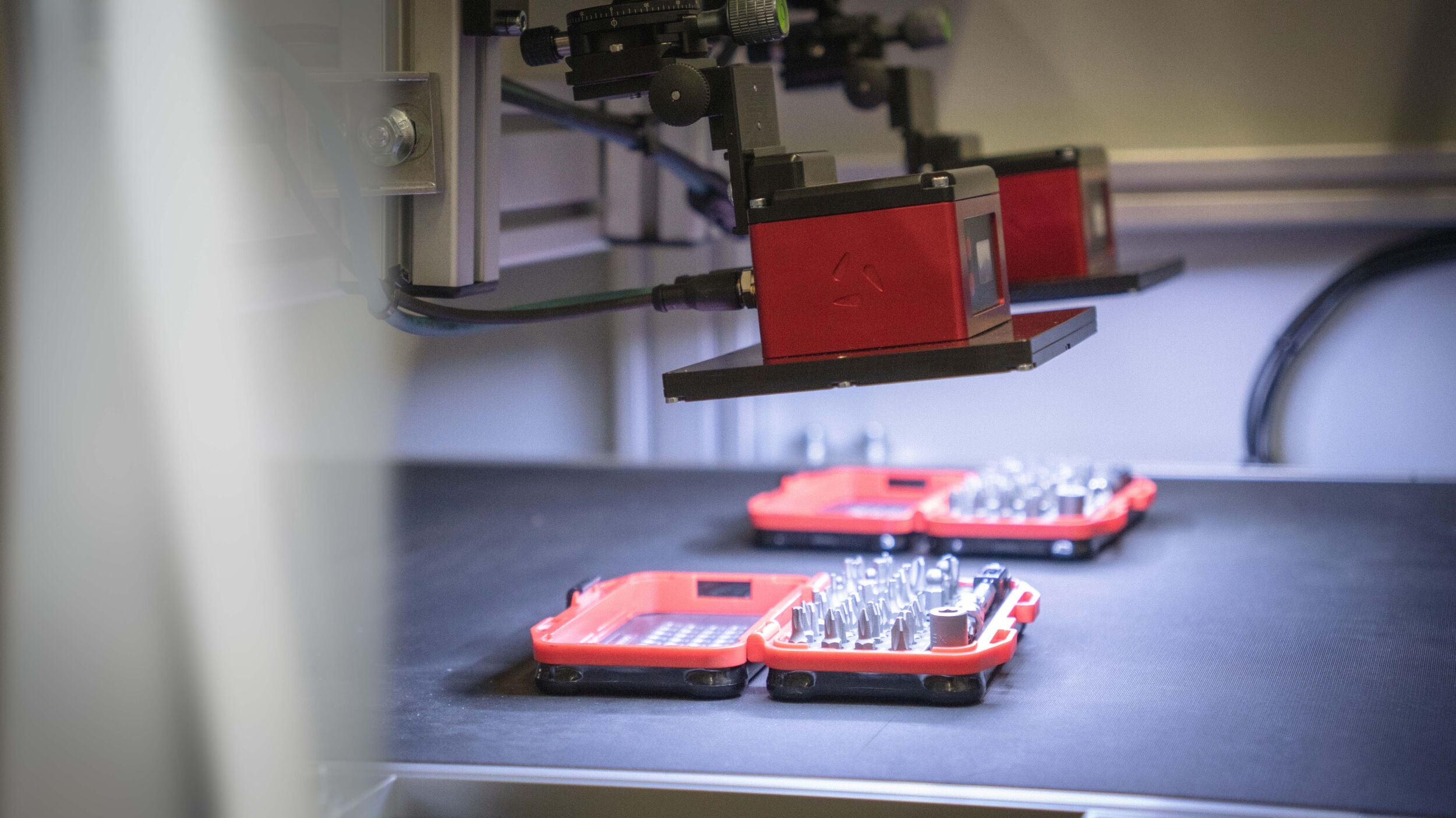

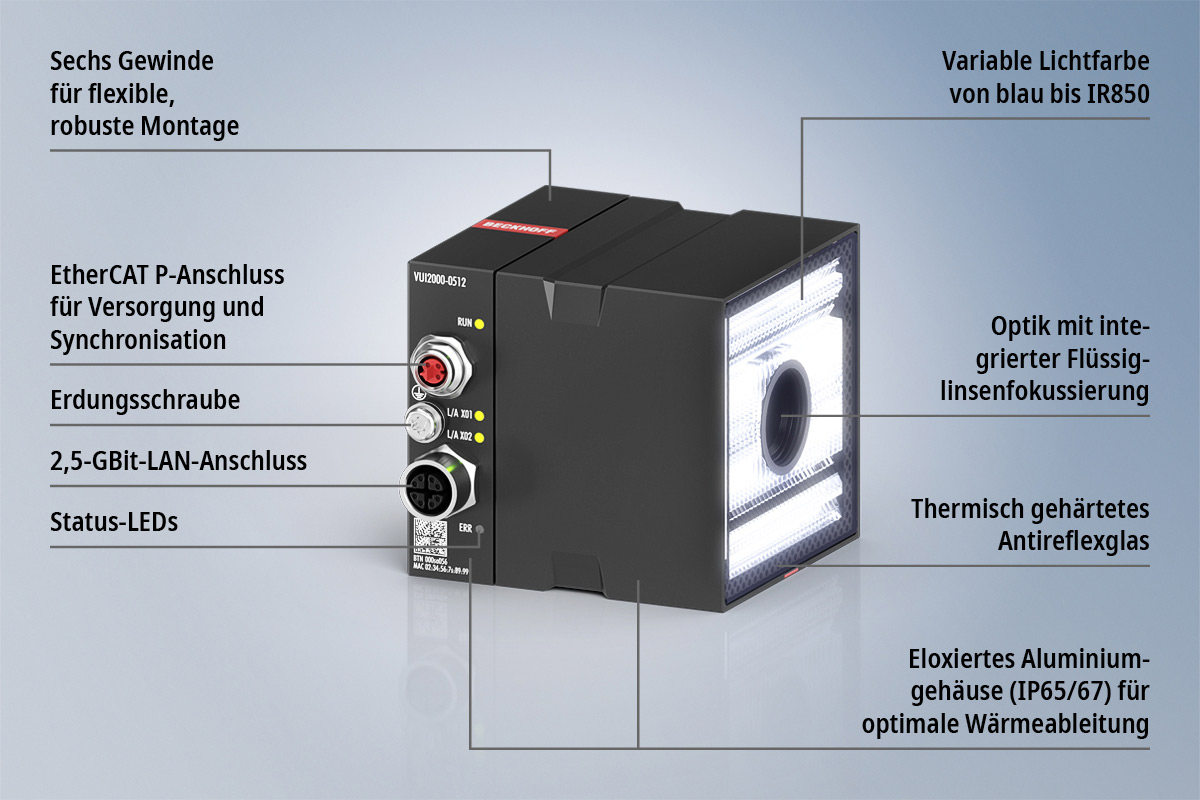

Der 3D-PMD-Sensor für die Abstandsmessung und die 2D-KI-Ethernetkamera für die Personenerkennung sind beide in ein Embedded-System integriert. Ein Hochleistungsprozessor verarbeitet beide Signale und setzt sie in Verbindung zueinander. Das Live-Bild der hochauflösenden 2D-Ethernetkamera wird parallel dazu mithilfe eines neuronalen Netzes analysiert. Die Kamera hat einen leistungsfähigen Prozessor und einen KI-Beschleuniger (NPU) für diese Aufgabe. Somit kann eine schnelle Verarbeitung der KI-Algorithmen für die Personenerkennung direkt im System stattfinden. Die Tiefen-Abbildung des 3D-PMD-Sensors und das Video der Kamera können anwendungsspezifisch miteinander kombiniert oder einzeln verwendet werden. Das System hat eine Fremdlichtunterdrückung, hält extremen Temperaturen stand und ist wasser- und staubgeschützt. Das Funktionsprinzip des 3D-PMD-Sensor beruht auf Time-of-Flight-Verfahren (ToF).

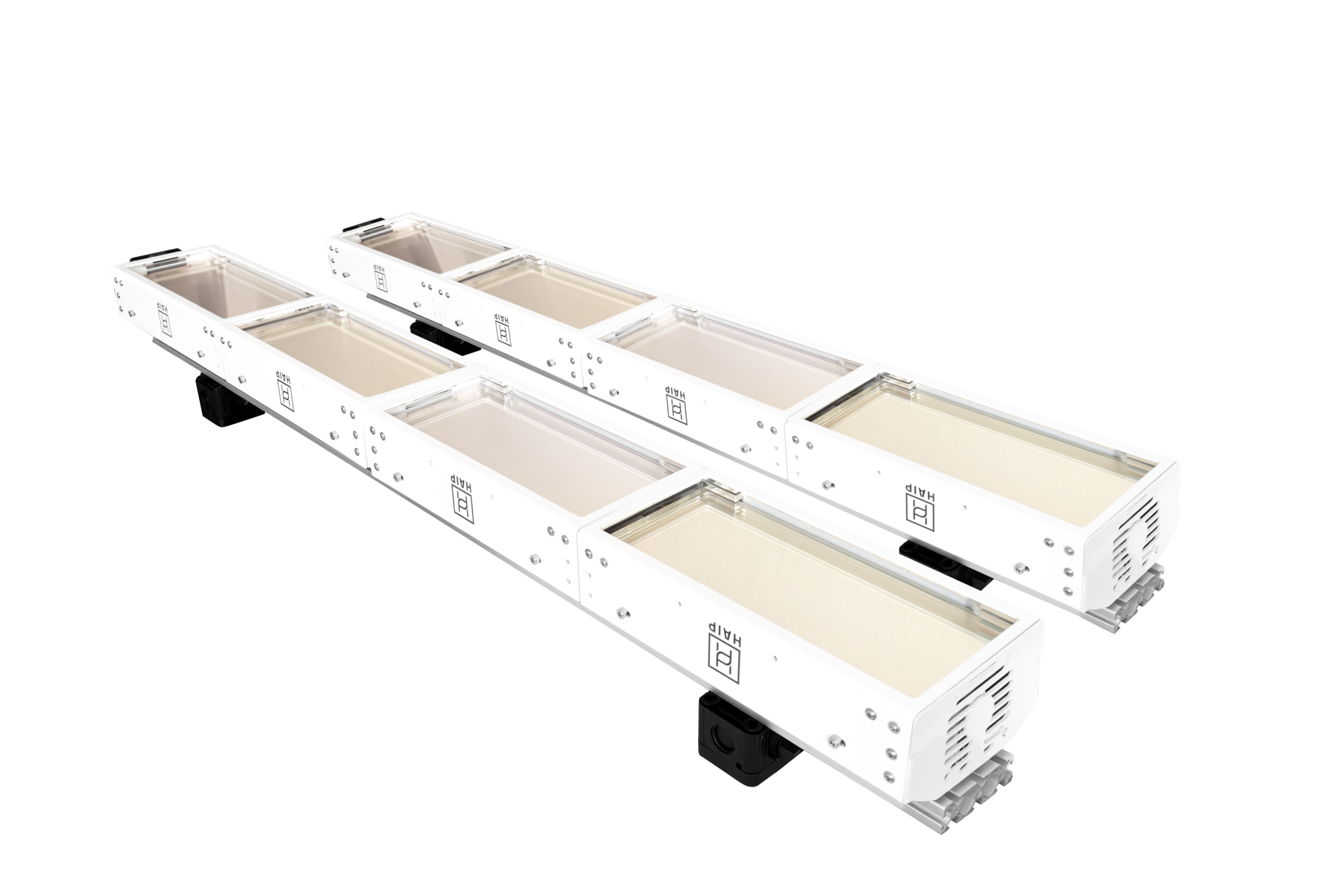

360°-Überblick behalten

Doch für den effizienten Betrieb einer mobilen Arbeitsmaschine in unübersichtlichen Umgebungen müssen Assistenzsysteme zwischen Personen und Objekten differenzierter unterscheiden und intelligenter Schlüsse ziehen können als bisher. Sei es, um beim Rückwärtsfahren die Geschwindigkeit besser anzupassen, oder um in unübersichtlichen Situationen mit dynamischen Geschehen und toten Winkeln jederzeit den 360°-Überblick zu behalten. Daher nutzt ifm die exakte Abstandsinformation des 3D-Sensors, um einen Fahrbetrieb zu ermöglichen, der wesentlich präziser an die jeweilige Arbeitssituation angepasst ist. So lassen sich Bremsweg und Kollisionswahrscheinlichkeit aus über 1.000 Abstandswerten errechnen, die der Sensor liefert. Hinzu kommen Funktionen, wie die Abschaltmöglichkeit der 3D-Objektprüfung. Fährt die Maschine auf übersichtlichem Gelände eine längere Strecke rückwärts, lässt sich somit das Tempo erhöhen. Gabelstapler oder Kommunalfahrzeuge hingegen, die unter engen Gegebenheiten rangieren, können sicher abgebremst werden, allerdings nur dann, wenn wirklich Gefahr droht und das Hindernis ein Mensch und nicht bloß ein Erdhaufen ist. Der O3M AI kann jederzeit differenzieren, ob eine Notbremsung, ein kontrolliertes Anhalten oder eine Verlangsamung in der jeweiligen Situation angemessen wäre.

KI-gestützte Personenerkennung

Zum anderen hat IFM eine eigene KI-gestützte Personenerkennung entwickelt. Die Treffsicherheit der Algorithmen konnte signifikant erhöht werden, da ifm das neuronale Netz mit eigenen Daten und in echten Arbeitsumgebungen trainiert hat, statt auf fertige KI-Lösungen zurückzugreifen. Vorgefertigte KIs haben den Nachteil, dass sie auf Beispielbildern basieren, die wenig oder gar nichts mit den Arbeitssituationen hierzulande zu tun haben. Anbieter sind häufig asiatische Unternehmen, die ihre Systeme für andere Einsatzzwecke trainieren. Dank der eigenen Bilddaten ist das System in der Lage, Personen und Objekte, wie sie in typischen Arbeitssituationen anzutreffen sind, präzise einzuordnen, unabhängig davon, ob es sich um eine Person handelt, die auf dem Boden liegt, dunkle Kleidung trägt oder durch größere Werkzeuge oder eine ungewöhnliche Körperhaltung gekennzeichnet ist. Dies sowohl bei hellem Sonnenlicht als auch in der Dämmerung und bis zu einer Reichweite bis maximal 25m und einer Genauigkeit von 10cm. Das System kann bis zu 20 Objekttypen gleichzeitig beurteilen.

Die Ergebnisse werden via CAN-Bus oder Ethernet an die Maschinensteuerung übergeben und dem Fahrer signalisiert. Die Infos und Warnmeldungen erscheinen auf einem Display im Fahrzeuginneren. Die Überlagerung von Warnsymbolen, Icons, Linienobjekten oder auch Texten erfolgt direkt im Sensorsystem und wird in das Videosignal eingespielt. Der digitale Videoausgang unterstützt die üblichen Codecs wie H.264, H.265 oder MJPEG über Fast Ethernet1. Es können zwei Videostreams unabhängig voneinander parametriert und gleichzeitig genutzt werden. Konfiguriert wird das System mit dem IFM Vision Assistant. Selbst komplexe Systeme mit mehreren 3D-Sensorsystemen können ohne besondere Vorkenntnisse parametriert werden