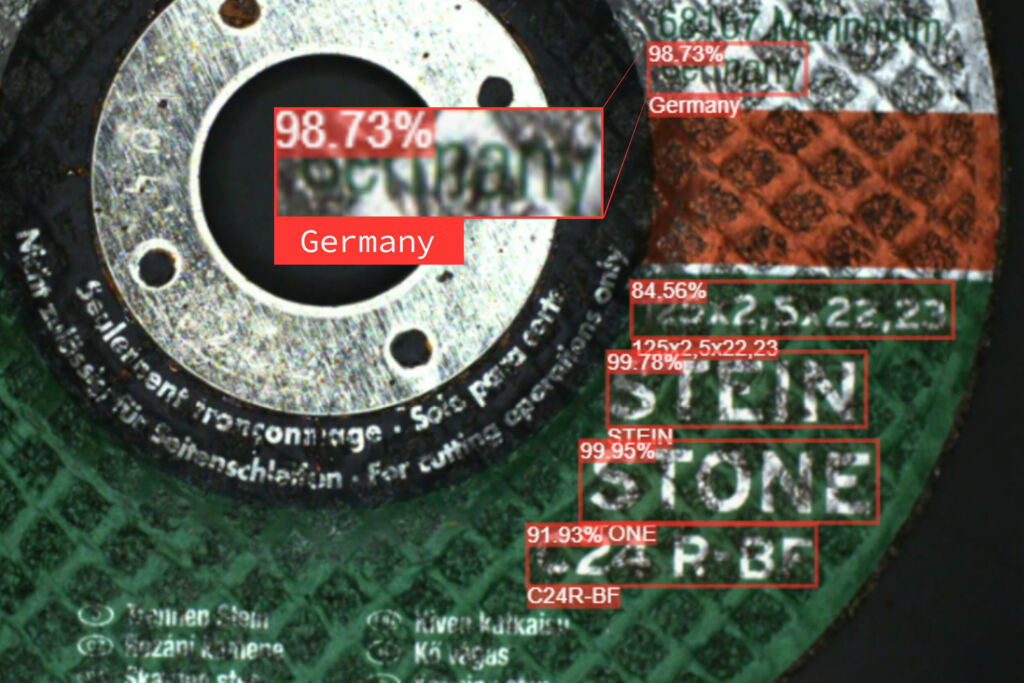

Die Erwartungen an eine OCR (Optical Character Recognition) sind hoch. Heutzutage erwarten Anwender, dass sie alle Zeichen out-of-the-box erkennt und richtig deutet. Darüber hinaus sollte die Genauigkeit konsistent bleiben, unabhängig von Veränderungen in der Lichtsituation oder anderen Umgebungsbedingungen. Regelbasierte Ansätze haben den Nachteil, dass ihnen der Interpretationsspielraum fehlt, der bei Ansätzen mit neuronalen Netzen durch das Training mit vielen verschiedenen Beispielen erworben wird. Alleine der Einsatz modernster Technologie ist jedoch nicht ausreichend für den Projekterfolg – vielmehr geht es auch darum, OCR einfach und performant nutzbar sowie benutzerfreundlich wartbar anzubieten. Allerdings schon die reine Vielfalt an möglichen Schriftzeichen und Verfahren, wie Zeichen auf den verschiedensten Oberflächen angebracht werden, vermittelt eine Vorstellung der Herausforderungen. Die Schwierigkeiten solche komplexe visuelle Daten in strukturierte Texte umzuwandeln, umfassen Schmutz, Reflexionen sowie Formfehler durch Ritzen, Prägungen oder Lasergravuren auf festen Materialien. Zudem können überlagerte oder unvollständige Zeichen, sowie eine niedrige Pixelauflösung der Bilddaten dazu führen, dass sich Zeichen kaum mehr voneinander unterscheiden lassen. So wird z.B. eine 8 schnell zu einer 3. Was sind daher die entscheidenden Faktoren für die Auswahl eines OCR-Systems?

Reproduzierbare Genauigkeit

Eine OCR muss von Anfang an einfach funktionieren und eine hohe Leseleistung bieten, um zu überzeugen. Dazu bedarf es einer gut entwickelten Netzarchitektur, die mit vielen variantenreichen Trainingsbildern vortrainiert wurde. Hier sind Situationen aus realen Anwendung genauso unverzichtbar wie der Einsatz synthetischer Daten. Damit können nicht nur viele Sonderfälle und Variationen gelernt werden, das sorgt auch für eine weitaus robustere Erkennung der relevanten Merkmale. An dieser Stelle setzt Denknet an, die KI Vision-Lösung für individuelle Bildanalysen. Dort steht Anwendern ein performantes und ständig weiterentwickeltes Deep-OCR-Modell zur Verfügung. Alle Entwicklungsschritte sind dabei streng versioniert, sodass Anwendungsentwicklungen auf definierte Versionen zurückgreifen können, aber auch die Möglichkeit haben, auf eine neue verbesserte Version zu aktualisieren. Zur Qualitätssicherung kann die Performance und Reproduzierbarkeit der trainierten Netze in einem Quality Center gegen Beispieldatensätze geprüft und verifiziert werden, bevor eine Produktionsanlage mit der neuen Software aktualisiert wird.

Transformer & Large Language Models

Eine weitere Eigenschaft eines guten OCR Modells liegt in der Fähigkeit, nicht nur einzelne Zeichen, sondern die Zusammenhänge – bei Zeichenfolgen, wie bspw. Seriennummern oder Worten – zu erkennen und dieses Wissen auch zu berücksichtigen. Je besser die OCR auch Folgezeichen vorhersagen und das Leseergebnis damit gewichten kann, desto robuster und präziser können spezielle Anwendungsfälle gelöst werden. Die generativen und kombinatorischen Eigenschaften von Transformer-Netzen oder Large Language Modellen (LLM), wie sie ChatGPT verwendet, könn(t)en solche Vorhersagen und damit auch die Lesequalität positiv beeinflussen. Doch dabei sollte man bedenken, dass diese Architekturen in der Ausführung eher langsam sind und viele Systemressourcen benötigen. Gerade im Automatisierungsbereich sollte sich eine Bildverarbeitung nicht im Sekunden-, sondern eher im niedrigen Millisekunden-Bereich bewegen. Ein trainiertes neuronales Netz sollte deshalb schnell und leichtgewichtig bleiben, um es auch auf ’normaler Hardware‘ ausführen zu können.